6月6日美股,輝達收跌1.18%,報1209.98美元,收盤市值回落至2.9765萬億美元。 該股股價早盤「閃崩」,一度較盤初所創的盤中紀錄高位回落近6%。

值得註意的是,6月6日盤後仍持有輝達股票的投資者,將在6月7日收盤後獲得9股額外股票,股價也將作出調整以反映分拆。6月10日(下周一),輝達開始以調整後的價格交易。

輝達在歷史上曾多次拆股。其中2000年、2001年和2006年都是按2:1的比例拆分股票。2007年,輝達曾以3:2的比例進行拆股。

不過,從歷史數據來看,拆股並非股價上漲的催化劑。美股近年來240次拆股案例顯示,這些股票在拆股後兩周內平均漲幅只有0.44%,不到一半的案例跑贏了標普500指數。六個月內這些股票的平均收益率為6.6%,僅略高於同期標普500指數的5.4%。

但輝達的歷史數據,則要漂亮得多。2021年拆股後,輝達曾在6個月內曾上漲近40%,上次拆分至今,輝達股價已上漲超過500%。

蘋果(AAPL)收跌0.71%,報194.48美元,收盤市值2.9821萬億美元。

微軟(MSFT)收漲0.12%,報424.52美元,收盤市值3.1551萬億美元。

Meta收跌0.26%,谷歌A漲0.78%,特斯拉漲1.65%,亞馬遜漲2.02%連續四個交易日反彈本周已累漲4.82%。

此外,台積電ADR收跌0.52%,也脫離收盤歷史最高位 ,但美股盤初漲至164.70美元繼續創盤中歷史新高;伯克希爾哈撒韋B類股漲0.3%,AMD漲0.36%,禮來制藥漲0.66%時隔一個交易日再創收盤歷史新高。

美國監管機構將對輝達、微軟和OpenAI展開反壟斷調查當地時間6月6日訊息,美國聯邦貿易委員會(FTC)和司法部將對微軟、OpenAI和輝達展開反壟斷調查,審查這些強大公司在人工智能行業的影響力,一位熟悉情況的人士向CNBC確認了這一點。

FTC將主導對微軟和OpenAI的調查,而司法部將專註於輝達,調查將集中在公司的行為上,而不是並購活動,據訊息人士稱。

【紐約時報】首先報道了這項調查。

隨著像OpenAI和Anthropic這樣的初創公司——分別是ChatGPT和Claude聊天機器人背後的公司——在生成式AI市場上獲得動力,谷歌、微軟、亞馬遜和Meta等科技巨頭一直在進行一場AI軍備競賽,競相整合這項技術,以確保他們不會在這個預計在十年內收入將超過1萬億美元的市場中落後。

例如,微軟在2019年首次向OpenAI投資了10億美元。自那以後,其投資規模已膨脹至約130億美元。微軟在其Copilot聊天機器人中大量使用OpenAI的模型,並在其Azure雲上提供開源模型。

巨額投資是必要的,因為AI模型的構建和訓練眾所周知地昂貴,需要數千個專業芯片,到目前為止,這些芯片主要來自輝達。Meta正在開發自己的名為Llama的模型,表示它正在花費數十億美元購買輝達的圖形處理單元,這是幫助這家芯片制造商年收入增長超過250%的眾多公司之一。

即將進行的反壟斷調查的訊息是在一群現任和前任OpenAI員工周二發表公開信幾天後傳來的,他們表達了對AI行業快速發展的擔憂,盡管缺乏監督,也沒有為那些願意發聲的人提供舉報者保護。

「AI公司有強烈的財務動機避免有效的監督,我們不認為客製的公司治理結構足以改變這一點,」員工們寫道,並補充說,公司「目前只有微弱的義務與政府分享這些資訊的一部份,與民間社會沒有任何義務。我們不認為他們都能被信賴自願分享。」

OpenAI沒有回應置評請求。微軟和輝達拒絕置評。

圖片來源:視覺中國

美財長耶倫警告:金融行業廣泛套用AI帶來潛在「重大風險」當地時間6月6日,美國財政部長耶倫出席了金融穩定監督委員會(FSOC)有關人工智能與金融穩定的會議,並在開幕致辭中警告金融機構使用人工智能技術的潛在風險。

有分析稱,這是耶倫迄今為止對人工智能作出的最廣泛評論。據一位美國財政部官員向媒體透露,耶倫本人也嘗試用過人工智能聊天機器人。

耶倫在演講中透露,人工智能與金融穩定是拜登政府高度重視的話題,「在未來幾年只會變得更加重要」。金融公司使用人工智能帶來的「巨大機遇和重大風險」已成為美國財政部和金融穩定監督委員會的首要議題。

耶倫承認,人工智能為金融系統提供了巨大機遇,例如透過AI的預測能力進行投資組合管理,利用AI檢測異常的能力來打擊欺詐和非法融資,客服也開始實作自動化。在最新的發展中,自然語言處理、影像辨識和生成式人工智能有助於金融服務成本更低和更易於獲取:

「我們看到,如果使用得當,人工智能可以提高效率、準確性和金融產品的可及性。」

但她同時警告稱,金融機構使用AI在促進機遇的同時伴隨著「重大風險」(significant risks):

「特定的脆弱性可能源於人工智能模型的復雜性和不透明性,風險管理框架不足以應對人工智能風險,以及由於許多市場參與者依賴相同的數據和模型而出現的相互關聯特征。

開發模型、提供數據和雲服務的供應商集中度過高,也可能會加劇現有的第三方服務提供商風險。數據不足或有缺陷則可能延續現有的偏見或引入新的金融決策偏見。」

有分析指出,耶倫意在警告,如果許多投資者都依賴於產生相同結果的AI工具,這可能導致某些熱門交易的倉位押註擁擠,從而加劇市場上行或下行的走勢。

同時,如果只有少數幾家公司有能力提供AI模型,一旦其中一家公司出現問題,許多金融機構可能受到波及。更別提AI模型有時會產生有偏差或者歧視性的結果,但耶倫沒提AI系統產生錯誤答案的「幻覺」問題。

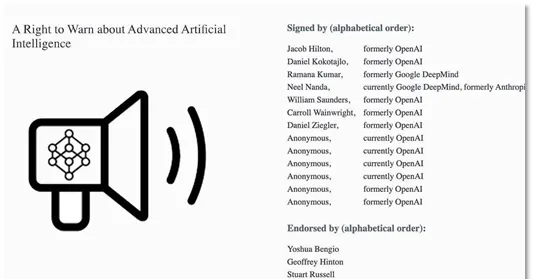

OpenAI、谷歌現任及前任員工聯名警告:AI失控或導致人類滅絕當地時間4日,13位來自OpenAI和Google的現任及前任員工聯合釋出了一封公開信,引發廣泛關註。這些員工在信中表達了對人工智能技術潛在風險的嚴重擔憂,並呼籲相關公司采取更加透明和負責任的措施來應對這些風險。

這封公開信由多位知名人士聯名背書,包括被譽為「人工智能教父」的謝菲辛頓、因開創性AI研究獲得圖靈獎的約書亞本吉奧以及AI安全領域的學者史超活羅素。

圖片來源:Right To Warn AI

信中指出,盡管人工智能技術可能會給人類帶來巨大益處,但其帶來的風險同樣不容忽視。 這些風險包括加劇社會不平等、操縱和虛假資訊傳播,以及自主AI系統失控可能導致的人類滅絕。 信中強調,這些風險不僅得到了人工智能公司本身的確認,也得到了世界各國政府和其他AI專家的認可。

公開信簽署者們表示,他們希望在科學界、政策制定者和公眾的指導下,能夠充分緩解這些風險。然而,他們擔心, 人工智能公司由於強烈的經濟動機,可能會避免接受有效的監督。 他們認為,僅靠現有的公司治理結構不足以解決這一問題。

信中還提到, 人工智能公司掌握著大量關於其系統能力和局限性、保護措施的充分性以及各種風險水平的非公開資訊。 然而,這些公司目前對與政府分享資訊的義務很弱,且完全沒有義務與公眾分享。簽署者們認為,不能完全依賴這些公司自願分享資訊。

信中提到,由於嚴格的保密協定,員工們在表達對AI風險的擔憂時,面臨著種種限制。 而目前對於舉報人的保護措施尚存在不足,一些員工擔心因提出批評而遭受報復。

聯名信呼籲人工智能公司承諾員工對公司提出風險相關的批評時,不對其進行打擊報復,建立匿名舉報機制,支持開放批評的文化,並保護員工公開分享風險相關資訊的權利。

圖片來源:X

OpenAI前員工丹尼爾科泰洛 (Daniel Kokotajlo)是此次聯名信公開署名人員中的一位。他在社交平台上連發15條訊息表示:「我們中一些最近從OpenAI辭職的人聚集在一起,要求實驗室對透明度作出更廣泛的承諾。」

丹尼爾提到,他今年四月辭職,是因為對該公司在構建通用人工智能方面是否會采取負責任的行為失去了信心。他指出, 盡管他希望公司在AI功能越來越強大的同時,能在安全研究方面投入更多資金, 但OpenAI並未做出相應調整,導致多名員工相繼辭職。

他強調,OpenAI等實驗室構建的系統有能力給人類社會帶來巨大的好處,但如果不謹慎處理,長期來看,可能是災難性的。他還提到, 當前AI技術幾乎未收監管,主要是公司在進行自我監管,而這種方式存在巨大的風險。

丹尼爾透露,離職時他被要求簽署一份「封口協定」,其中包含一項不貶損條款,禁止他發表任何批評公司的話,否則將失去已歸屬的股權。然而,他在深思熟慮後,依舊決定放棄簽署協定。

圖片來源:Dwarkesh Podcast

此外,6月4日,OpenAI前超級對齊部門成員利奧波德阿申布倫納(Leopold Aschenbrenner)也在播客節目Dwarkesh Podcast中透露他被開除的真實原因:他給幾位董事會成員分享了一份OpenAI安全備忘錄,結果導致OpenAI管理層不滿。

利奧波德在社交平台表示, 到2027年實作AGI是極其有可能的,需要更嚴格的監管和更透明的機制,確保人工智能的安全發展。

每日經濟新聞綜合公開資料

免責聲明:本文內容與數據僅供參考,不構成投資建議,使用前請核實。據此操作,風險自擔。

每日經濟新聞

如需轉載請與【每日經濟新聞】報社聯系。