自從生成式人工智慧的浪潮席卷全球以來,很多內容創作者一直聲稱他們的作品未經授權就被用於訓練人工智慧模型。但到目前為止,很難判定他們口中所說的作品內容是否真的被用於某些訓練數據集。

如今,研究人員開發出了一種新的方法來證明這一點。近日,來自倫敦帝國理工學院的一個研究團隊開發出「版權陷阱」(Copyright traps),這是一種隱藏文本,可以讓作家和出版商巧妙地標記他們的作品,以便後期檢測這些作品是否已被用於訓練人工智慧模型。這一想法與此前版權所有者使用的策略相似,比如在地圖上添加虛假位置或在字典中添加虛假單詞等。

這些人工智慧版權陷阱引發了人工智慧領域最大的爭論之一。許多出版商和作家正在與科技公司打官司,聲稱他們的智慧財產權在未經授權的情況下被納入人工智慧訓練數據集中。比如,【紐約時報】對 OpenAI 的訴訟可能是其中最典型的案例。

截至目前,生成和檢測陷阱的程式碼已經在 GitHub 上線,接下來,該團隊還打算開發一個工具讓使用者自行生成和註入版權陷阱。

倫敦帝國理工學院的套用數學和電腦科學教授 Yves-Alexandre de Montjoye 領導了這項研究,他在本周在維也納舉行的人工智慧頂級會議國際機器學習會議上表示:「目前關於使用哪些內容來訓練人工智慧模型方面完全缺乏透明度,我們認為這阻礙了人工智慧公司和內容創作者之間找到適當的平衡。」

為了建立陷阱,他和團隊使用單詞生成器建立了數千個合成句子。這些句子很長,基本都是胡言亂語,比如,「當動蕩時期到來時 ...... 什麽在打折,更重要的是,什麽時候是最好的,這個列表告訴你誰在周四開業。晚上有他們的常規銷售時間和鄰居的其他開放時間。你還在。」

Yves-Alexandre de Montjoye 解釋說,「我們生成了 100 個陷阱句子,然後隨機選擇一個句子多次註入到文本中。」與此同時,該陷阱還可以透過多種方式註入到文本中,比如,在白色背景上使用白色文本,或嵌入到文章的原始碼中。這個句子必須在文本中重復 100 到 1000 次。

為了檢測這些陷阱,他們將生成的 100 個合成句子輸入到大型語言模型中,並檢視模型是否將它們標記為新的句子。如果模型在其訓練數據中看到了陷阱句子,則顯示較低的「困惑度分數」;但如果模型對句子感到「驚訝」,則意味著模型第一次遇到它們,因此這些句子不是陷阱。

在過去,研究人員曾建議利用語言模型記憶訓練數據來確定數據中是否出現了某些內容。這項技術被稱為「成員推理攻擊」(Membership inference attacks),在先進的大模型中效果較好,因為這些模型往往會在訓練過程中記住大量數據。

「相比之下,越來越受歡迎、可以在行動裝置端執行的小模型,由於記憶數據量較少,因此不太容易受到成員推理攻擊的影響。這使得確定它們是否針對特定受版權保護的文本進行訓練變得更加困難。」滑鐵盧大學電腦科學助理教授 Gautam Kamath 指出。他沒有參與這項研究。

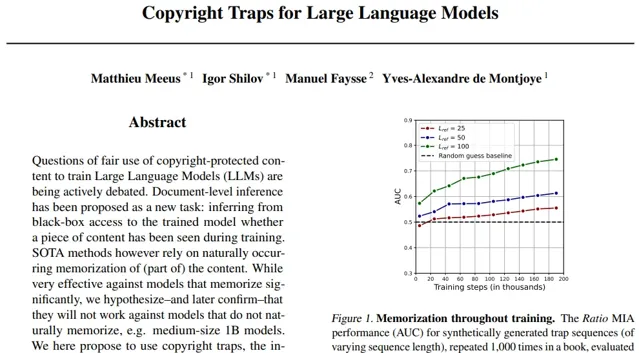

版權陷阱,作為一種進行成員推理攻擊的方法,即便是在較小模型上也是如此。Yves-Alexandre de Montjoye 團隊將他們的陷阱註入到 CroissantLLM 的訓練數據集中。CroissantLLM 是一個新開發的法英雙語語言模型,由倫敦帝國理工學院的研究團隊與工業界和學術界的合作夥伴共同訓練。CroissantLLM 擁有 13 億個參數,僅為最先進的模型(例如,據報道 GPT-4 具有 1.76 萬億個參數)的一小部份。

「研究表明,確實可以將此類陷阱引入文本數據中,從而顯著提高成員推理攻擊的有效性,即使對於較小的模型也是如此。」Gautam Kamath 表示,但他補充說,現階段仍然還有很多工作要做。

「在文本中重復 75 個字元的短語 1000 次對原文本產生很大影響。這可能使訓練人工智慧模型的訓練師發現陷阱並跳過包含它的內容,或者直接刪除它並對剩下的文本進行訓練。這也會讓原始文本難以閱讀。」Gautam Kamath指出。

「這使得版權陷阱在目前看來不切實際。很多公司都會進行去重處理,換句話說,他們會清理數據,這些版權陷阱可能會被刪掉。」加州大學厄文分校電腦科學教授、初創公司 Spiffy AI 聯合創始人 Sameer Singh 表示。他也沒有參與這項研究。

在 Gautam Kamath 看來,改進版權陷阱的另一種方法是,找到其他方法來標記受版權保護的內容,以便成員推理攻擊對它們更好地發揮作用,或者改進成員推理攻擊本身。

Yves-Alexandre de Montjoye 承認這些陷阱並非萬無一失。「一個有動機的攻擊者如果知道陷阱的存在就可以將其移除。」他表示。

「但他們能否將其全部移除還是一個未知數,這可能有點像‘貓捉老鼠’的遊戲。」他說道,「即便如此,設定的陷阱越多,在不投入大量工程資源的情況下,移除所有陷阱就變得越困難。」

「重要的是要記住,版權陷阱可能只是一種權宜之計,或者僅僅是給模型訓練師帶來不便。任何人不可能釋出一條包含陷阱的內容並保證它永遠是一個有效的陷阱。」Gautam Kamath 說道。

原文連結: