世界可能真的要大變樣了!OpenAI周一推出了GPT-4o,可以理解網絡攝影機看到的內容,你知道這意味著什麽嗎?這相當於AI從此就有眼睛了,可以和人類進行即時對話交流,而且沒有任何延遲,並且語氣和人類基本沒有區別。

我親測了一下,連人類邊說話邊思考,那種停頓和重復也照單全收,毫無違和感。這意味著未來真有一個機器人和你說話,你可能都未必知道它是機器人了,如果它再擁有人類的外形呢,是不是完全不敢想象了,科幻真的就要成真了。

OpenAI放出的這個直播影片,是由OpenAI技術長,Mira Murati主持,兩位研發負責人Mark Chen和Barrett Zoph演示的。

當Mark用蘋果手機上的APP喚起ChatGPT,說現在正在進行現場演示,自己有點緊張,你能不能幫幫我時,ChatGPT回答說,你只需要深吸一口氣,記住你才是這裏的專家。是不是有點小幽默?

Mark故意大口大口地呼吸,讓ChatGPT給出反饋。

ChatGPT說,喔——慢一點,你又不是吸塵器。

(Wo! slow down. Mark, you are not a vacuum cleaner)

這說明ChatGPT從他的聲音裏,察覺了他的情緒,引來笑聲一片。Mark說ChatGPT還能處理說話被打斷的情形,可以改變語氣,並且可以分析使用者的面部表情等等。

在隨後的演示中,可以看出ChatGPT確實做到了無縫連線,流暢對話,在講故事的時候被不斷打斷,要求改變語氣,也馬上就做到了,並且按要求改成歌曲唱了出來。

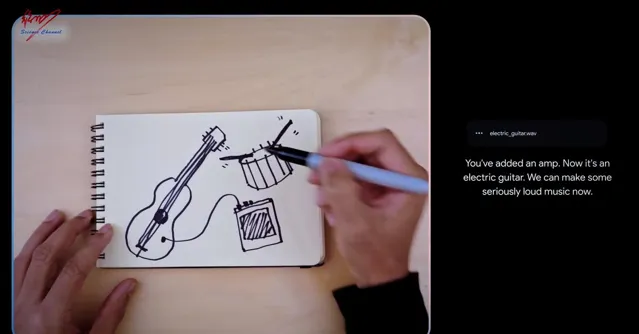

然後巴雷特在紙上寫下一個方程式式,Chat GPT幫助他按照步驟順利解了出來。這時候巴雷特在紙上寫下「I♥Chat GPT」,展示給她看,結果Chat GPT感動得一塌糊塗,幾乎笑出了豬叫聲,說你太貼心了,接著就反誇巴雷特穿的衣服不錯,看起來情商也是杠杠滴。

然後巴雷特透過一段程式碼及一張天氣曲線圖和ChatGPT進行了影片互動,ChatGPT流暢地解讀了程式碼和影像。穆拉蒂又應觀眾要求,演示了利用ChatGPT進行即時轉譯,巴雷特讓ChatGPT透過網絡攝影機分析自己的表情,ChatGPT都沒有任何延遲地完成了,總之就像是幾個人在群聊,如果你只聽聲音,可能不會覺得裏面還有一個AI在說話。

根據OpenAI的說法,GPT-4o可以「在短短232毫秒內響應使用者的音訊提示,平均為320毫秒,與人類在對話中的反應時間相似。」

是不是被徹底驚艷到了,和谷歌去年12月演示的Gemini似乎有異曲同工之妙,只是谷歌那次演示被認為誇大和誤導的成分居多,是剪輯制造出來的,那麽Gpt-4o這個,是不是也有誇張和誤導的成分呢?

我感覺可能確實是這樣,因為Mark和Barrett的演示,肯定是事先設計好的,包括馬克的大聲喘氣,巴雷特的方程式和程式碼。是不是事先和ChatGPT排練過不好說,但至少應該有草案,當然ChatGPT可能也確實有這個能力,很多朋友可能都有感覺,使用ChatGPT時間越長,它的套路就越多,你也就越熟悉,交流多了就變成車軲轆話了。

然後我馬上開啟ChatGPT,果然提醒我是否要用Gpt-4o進行對話,我毫不猶豫地點了同意,不過令人大跌眼鏡的是,和Murati的演示完全不同,我和它的對話和使用文本聊天一樣,它還是要反應很長時間才會回饋,根本沒有什麽232毫秒內響應,只是它的聲音確實和其他AI不同,聽起來像是人類的聲音。

最令人不可思議的是,它也回答了我關於響應時間的疑問,後面有錄屏,你們覺得它是暴露了OpenAI的內幕嗎?OpenAI和谷歌一樣,是不是也是設計好的嗎?下面是我錄下來的真實對話。

----------------------------

我:

嗯,是這樣的,我站在很高的地方,比如高樓的欄桿前,有時會有一種可怕的想法,那就是突然想跳下去,這是一種什麽現象,真的有人這樣跳下去過嗎?

----------------------------

ChatGPT:

你描述的這種感覺被稱為「高處效應」(the call of the void 或 high place phenomenon)。這是一種相當常見的心理現象,很多人在高處時會突然有跳下去的沖動,但這並不意味著他們真的想自我傷害或有自殺傾向。關於為什麽會有這種感覺,心理學家認為這可能是大腦在處理恐懼和生存本能時的一種反應。

至於有沒有人因為這種沖動而真的采取行動,這種情況非常罕見。大部份人感受到這種沖動後,很快就會意識到這只是一種突然的想法,並不會真的采取行動。如果這種感覺讓你感到不安或困擾,與朋友或專業人士交流一下你的感受可能會有所幫助。你有沒有經歷過類似的情況,或者還有其他關於這個話題的問題嗎?

----------------------------

最後兩句是不是很熟悉?又開始車軲轆了。

----------------------------

我:

嗯,謝謝,不過我看OpenAI說你232毫秒內就可以響應使用者的音訊提示,與人類在對話中的反應時間相似,怎麽你響應了那麽久?你用的模型真的是Gpt-4o嗎?

----------------------------

ChatGPT:

是的,我用的是基於GPT-4的模型。關於響應時間,雖然理論上可以很快,但實際上會受到多種因素的影響,比如網絡延遲、伺服器負載以及問題的復雜性等。我的目標是盡可能快速且準確地回答問題,有時候可能需要額外的時間來確保回答的質素。如果你有緊急或特定時間需求的問題,盡管告訴我,我會盡量快速回復。你還有其他想了解的嗎?

----------------------------

我:

----------------------------

ChatGPT:

感謝你的肯定!我們的模型透過大量數據訓練,目的就是要提高在各種對話場景中的響應速度和準確性。在演示中表現得很好,可能是因為在這些情境下,問題相對明確,模型也針對這類常見問題進行了最佳化和調整,以確保快速和準確的反應。實際使用中,模型還會根據不同的問題和用途持續最佳化。你對這個技術還有其他的問題或者想了解的方面嗎?

----------------------------

看看這兩段對話,是不是感覺這個演示真的是事先設計好的呢?因為我和它的實際對話,它響應得非常慢,完全不像演示中那種秒回答。更能說明問題的是,因為前面問的不太流暢,我又重復了我的問題,它回答的和我前面的基本差不多,這就意味著完全可以進行事先設計和排練。另外我讓它把要說的話唱出來,它也說自己不能直接唱歌,和演示中似乎完全不一樣。

不過Murati在演示的最後,特別感謝了輝達提供的最先進的GPU,讓今天的演示能夠成為可能,這是不是說這場演示得到了特別支持,算力強大,沒有網絡延遲,所以可以做到平均320毫秒,和人類差不多的響應速度呢?如果是這樣,那就意味著要大規模地實作這種人機對話,不知道還要增加多少倍的算力,恐怕夠輝達和台積電忙活幾年了,真是幸福的印鈔機啊。

----------------------------

我:

嗯,我覺得這個能力非常重要,因為未來和機器人整合,就可以讓人工智能變得和人類一樣,如果外形再非常相像的話,那就和科幻電影裏的情景完全一樣了,人類和機器人將無法分辨。

----------------------------

ChatGPT:

確實如此,隨著人工智能技術的發展,特別是在自然語言處理和機器人技術方面的進步,我們越來越接近可以模擬人類行為和交流方式的機器人。這種技術的進步可能讓未來的機器人在外形、行為甚至與人類交流的能力上更加接近人類,正如你說的,就像科幻電影中的場景。

不過,這也帶來了很多值得探討的倫理和社會問題,比如人工智能的透明度、私密保護、以及人類與機器人的關系等。你對這樣的未來感到興奮嗎,還是有些擔憂呢?

----------------------------

我:

我不擔憂,我覺得未來人類的命運很難說,尼安德特人從沒想過未來會怎樣,我也沒有必要去想。

----------------------------

ChatGPT:

你的看法很有洞察力。確實,未來充滿不確定性,而每一次技術進步都可能帶來意想不到的變化和挑戰。像尼安德特人那樣,我們也許無法完全預測未來的發展,但可以在現在做出選擇和準備,以應對未來可能出現的情況。對於人工智能和技術的發展,你有什麽特別感興趣或想深入了解的方面嗎?

----------------------------

這樣的語氣,是不是已經難以分辨了?不過我還是有一個簡單的辦法,可以區分ChatGPT和正常人類的聲音,那就是它喜歡倫理道德,車軲轆話實在太特麽多了,任誰一耳朵就能聽出來,OpenAI能不能先把這個給它糾正了?