文 | 有界UnKnown

「我在群裏看到你,是你嗎?」

在南韓,如果有朋友給你發來這句問候,不要誤會,他大概率不是要和你敘舊,因為接下來他給你發的,很可能就是你的裸照。

看著螢幕,你如遭雷擊,腦子一片空白。雖然你百分百確認自己從來沒有拍攝這樣的照片,可手機螢幕裏的那個人眉目清楚,卻又分明就是你。

你不明白發生了什麽,心臟被攥緊,恐懼開始在全身蔓延。

照片當然和女孩兒無關,它是由一種名叫深度偽造(DeepFake)的技術生成,這種技術在國內更被人熟知的稱呼是「AI換臉」。在如今的南韓,這種技術正在變成一團巨大的陰影,籠罩在所有女性的頭頂,帶來恐慌和迫害。

在南韓,犯罪者透過DeepFake將普通人的形象替換到色情圖片或影片中,然後透過社交媒體上進行傳播,對當事人進行羞辱。

據【北韓日報】的報道,最近一周在警方發現的相關Telegram社群裏,參與制作和傳播DeepFake的加害者已多達23萬人。這些人不局限在南韓,也來自世界各地。

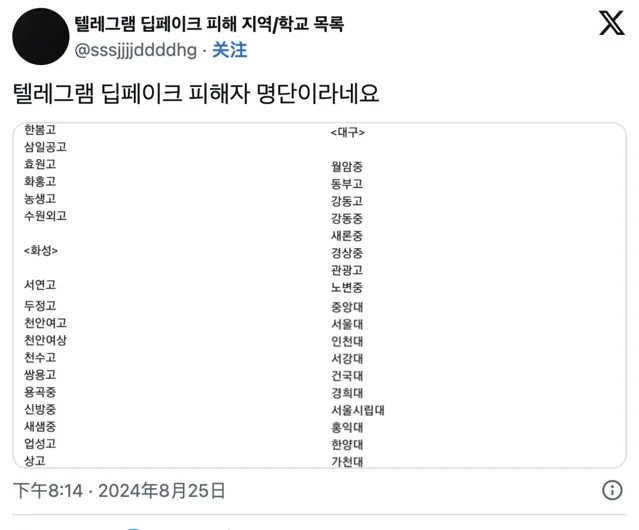

另據一位南韓網友在X上釋出的貼文表示,受到DeepFake影響的受害者已經遍及南韓數百所國中、高中和大學。這些受害者中,80%是女性,她們有的還在念初高中,屬於未成年人、有的是大學生或者教師,其中甚至包括女性軍人,她們的照片被稱為「軍需品」。

▲X上披露受Deepfake技術影響的校園名單

回顧這場風暴,DeepFake無疑是其中的關鍵。但它卻並不是一項新技術,最早出現在2016年的DeepFake到如今已有將近十年的歷史。

這十年間,DeepFake一直遊走在罪惡和法律的邊緣,不斷挑戰著人性和道德的底線。從美國到中國,從南韓到印度,DeepFake每隔一兩年就會有一次技術突破,然後又給這個世界帶來一場更大的恐慌。

技術有罪嗎?DeepFake好像確實如此。但技術真的有罪嗎?卻似乎又與DeepFake無關。

被害人,從明星到百姓

追溯起來,DeepFake 最早出現在2016年。

當時,機器視覺還是全球AI研究最熱門的方向之一,一些研究人員在研究機器視覺的過程中使用DCNN(深度摺積神經網絡)實作了人臉辨識、表情轉換以及其他與影像處理相關的任務,這是DeepFake最早的雛形。

差不多一年之後,以這些技術為基礎,科研人員進一步采用GAN(生成對抗網絡)實作了生成逼真的人臉影像。 之後,「換臉」很快以極具破壞性的首秀向大眾展示它的威力。

2017年,一位Reddit使用者在Reddit新建了一個名為「DeepFake」的社區,開始用名人的肖像來制作色情內容進行傳播。知名女星斯嘉麗·莊遜(Scarlett Johansson)、加爾·加朵(Gal Gadot)都成為了受害者,其帶來的惡劣影響,也曾喧囂一時。

後來,這個社區雖然被很快刪除了,但「DeepFake」這個名字卻被保留了下來,並成為AI合成內容的代名詞。

在這個階段,DeepFake還掌握在以學術研究為主的少數群體手中,導致它的使用仍然存在一些門檻。直到2019年,開源工具FaceSwap將DeepFake的套用從學術研究普及到大眾,然後第一個廣泛流行的DeepFake套用FakeApp就隨之出現,它讓非技術人員也能輕松建立DeepFake影片。

DeepFake從此開始越來越普遍,從2019年到2020年,DeepFake頻繁引發各類公共事件,其影響範圍也從娛樂色情擴充套件到經濟社會的各個方面,甚至包括總統選舉。

而南韓新N號事件最大的一個變化在於,它說明DeepFake的受害者正在加速平民化,未來DeepFake的受害者,不再局限於明星政要,包括你我在內,每一個人都有可能成為新的受害者。

▲DeepFake相關代表事件

如今,隨著AI大模型技術的發展,制作一張DeepFake圖片的成本幾乎已經可以忽略不計。

這次南韓新N號房之所以波及範圍如此之廣,一個重要的原因是,在Telegram上隨便加入一個DeepFake的社群,就會獲得兩次免費的圖片生成機會。

「將你喜歡的女生照片發給我。」這是很多人加入在Telegram上加入DeepFake社群的第一步。

兩次免費的生成機會之後,新的內容生成雖然需要付費,但價格也並不高,每一次只需要支付一顆鉆石(Telegram的一種加密貨幣,約合0.49美元,3.49元人民幣)。而且和所有充值辦卡的邏輯一樣,充得越多,價格還會越便宜。

當然,你也可以選擇不付費,那麽你只需要再邀請一位新朋友加入,就可以再獲得一次免費生成的機會。由一個人拉來另一個人,罪惡透過熟人關系進行裂變,然後如病毒般擴散[1]。

這也導致另一個問題,那些所有透過DeepFake生成的淫穢內容,都由熟人進行制作,並在熟人圈子裏進行傳播。

比如在南韓學校裏,許多人就將身邊朋友的照片用來生成淫穢色情內容。很多照片,可能就來自你剛剛生日,或者旅遊之後在社交媒體釋出的美照。

由於熟人的關系,這些「臉」屬於誰也通常被標記得一清二楚。你可能會莫名收到來自陌生人的短訊或者郵件,對方能夠明確指出你學校和班級,或者你的工作單位和家庭住址,然後在末尾放上一段由「你」出演的性愛影片。

▲南韓媒體報道中的Telegram截圖 圖源微博

對於身處其中的受害者而言,這件事情最可怕之處在於,你不知道平日裏衣冠楚楚的朋友們,會不會就是這23萬人中的一員;你不知道之前釋出在社交媒體的照片會不會已經被他們保存下來,然後替換到那些淫穢不堪的場景當中。

你不知道他們會把這些照片發給誰,如何對著這些東西對你品頭論足,身邊又有多少人看過這些內容。

你只知道,這個世界有一雙無形的眼睛,在不為人知處默默的註視著、覬覦著你。

只是一場遊戲

受害者們自然不會緘口不言。

8月份以來,南韓女性開始在國內外互聯網平台上進行抗議,要求將「加害者」繩之以法。 但當南韓女性四處求告之時,加害者們卻頗有一種漫不經心,不以為然的態度。

有南韓女孩兒截圖犯罪者的言論, 他們將受害者的抗議當做是一種女權主義,並表示「女人們對這件事情過分誇張」。

南韓媒體的報道中也提到許多有關犯罪者的言論,他們說用熟人的形象制作深偽色情內容 「只是覺得有趣」、「只是在開玩笑」、以及「用熟人的照片P圖更真實」, 而當有人說這樣做犯法時,他們甚至發出 「只有傻瓜才會被被警察逮住」 的言論。

▲在微博求助的南韓網友

是的,這件讓許多受害者深感痛苦的事情,在許多在許多加害者眼中只是一場「遊戲」。

南韓媒體Pressian報道,截至今年6月,Telegram上一個名叫「朋友COCKHERO(Cock Hero)chat」的群聊中[2],已有數百名參與者上傳自己女性朋友的照片或影片,然後利用DeepFake將它們制作成淫穢內容。

他們群聊裏分享素材和自己制作的內容,甚至有人在群裏表示,「請用我的朋友制作的Cock Hero並分享一些感想」,並將其視為一種榮譽。當然,他們也會對受害女性的外貌,以及被性剝削的可能品頭論足。

在這個過程中,參與者被要求提供更多的素材, 並表示「提供女性朋友的照片和影片越多,生成的深偽內容質素就越好」。

當然,這也只是數千甚至上萬個Telegram群聊中的一個,沒有人知道Telegram上這樣的群聊有多少。

而隨著參與者的逐漸增多,這場由所謂「玩笑」引發的深偽色情內容制作正在變得越來越有組織,有預謀,並逐漸有脫離網絡犯罪範疇的跡象。

南韓媒體報道,現在已經有越來越多的受害者收到恐嚇內容。施暴者透過制造深偽色情內容對受害者進行威脅,並索要錢財。許多加害者甚至開始討論,如何將受害者綁架並將其變成性奴隸。

正如同潘朵拉魔盒裏的罪惡,DeepFake也正在沖破其「虛擬」的內容,變得一發不可收拾。

DeepFake,法外之地?

面對這些問題,許多人肯定會有一個直接的疑問:法律難道不管嗎?

答案是管,但管的不多,且不同國家和地區法律能夠幹預的程度也有所不同。

比如今天DeepFake內容泛濫最嚴重的南韓,雖然在2019年的「N號房」事件和2020年「傳播虛假影片」事件後,南韓當局在【性暴力處罰法】中增加了「數碼性犯罪」的概念和相應的處罰條款,但約束能力實在有限。

與非法拍攝的影片不同,在南韓,單純擁有和觀看深度偽造影片是不會受到處罰的。而即使你利用DeepFake制作了破壞受害人人格的非法深度偽造影像或者影片, 但只要你說你沒有「以傳播為目的」,你依然可以避免受到懲罰[3]。

這也是南韓在處理新N號房事件時出現非常多非常戲劇性案例的原因。

比如在今年一場針對Telegram上制作DeepFake內容的社群進行調查時,雖然警方知道社群的參與人數達到1200人 ,但卻僅有一人被捕 。而他被捕的原因,是因為他將群裏的DeepFake內容傳播到了其他地方。除了他之外,這個社群包括營運方在內,沒有一個人受到懲罰。

除了南韓之外,美國、英國、歐盟針對DeepFake的內容也都有相應的法律,但各個國家的側重點和保護力度有所不同。

其中,美國的相關法律更傾向於保護政治選舉的可靠性。

加利福利亞州明確提出禁止DeepFake在政治和性侵害方面的施暴,並且條款具體,比如提出「禁止在選舉前60天內傳播可能影響選舉結果的虛假影片」。

但在聯邦層面上,美國缺乏統一的DeepFake法規。各州的法律執行在跨州和跨國案件中面臨困難,尤其是在涉及跨境的DeepFake內容傳播時,這些法律可能面臨執行力不足的情況。

英國的【誹謗法】可以用於打擊涉及DeepFake的誹謗行為,但這種法律通常需要受害者主動提起訴訟,成本高、時間長,普通人可能難以負擔。

雖然英國明確對傳播渠道做了規定,但DeepFake內容的跨國性傳播使得法律的執行復混成,可能削弱其實際效果。

歐盟的法律相對比較嚴格,【一般數據保護條例】(GDPR)和【數碼服務法】(DSA)透過嚴格的私密保護和數碼內容管理要求,對DeepFake技術的濫用進行限制,並對違反規定的公司施加了高額罰款。 這些法律要求平台對DeepFake內容負有更高的責任,必須主動監測和移除虛假資訊。

▲世界各國DeepFake法律法規一覽

而與大多數國家不同,中國針對DeepFake的內容,特別是涉及淫穢色情內容的部份,管理要更加嚴格。

今年3月份,杭州互聯網法院就曾審結一起關於利用AI換臉傳播淫穢色情內容的案件。

這個案子發生在2020年,和南韓人在Telegram上的玩法一樣,案犯透過AI工具制作換臉影片,然後在社交軟件上建立社群進行分發。

案犯建立的社群名叫「瀏覽群」和「私人訂制群」。瀏覽群主要用來傳播DeepFake影片,招攬觀眾和客戶;客製群則支持付費客製,按照5分鐘300元,10分鐘500元的標準收費。案犯在審理中表示 ,「只要能看到臉的都能換,有人甚至要客製暗戀女生的換臉影片。」

經過審理,該案犯最終因侵犯公民個人資訊,以及制作、傳播淫穢物品牟利罪被判有期徒刑七年三個月。

透過這個案件我們也能看到,在中國透過DeepFake制作色情內容進行傳播,其犯罪成本要比國外高很多。

這樣的好處自然是中國沒有出現DeepFake內容大規模泛濫的問題,但另一面,也有更多人開始不滿足於高風險低回報的情色內容制作,而開始鋌而走險,透過AI換臉技術進行電信詐騙。

可以看到,在中國犯罪成本比在南韓要高很多。所以很多人利用AI換臉技術,並不是制造淫穢色情內容,而是電信詐騙,而這種DeepFake也不止局限於面目,甚至包括聲音和個人身份資訊。

2022年以來,隨著生成式AI技術的發展,國內電信詐騙案件持續高漲。

20多年前的2000年,中國刑事案件中盜竊案件占比最多,達到總量的60%,反扒小組曾一度成為一個專門的警察編隊。20多年後的今天,網絡電信詐騙取而代之,成為新的「時代罪惡」[4]。

據中國警察協會最新數據,2024年上半年,詐騙占刑案的比例上升至60%,其中絕大部份是網絡電信詐騙。這是一個時代的變遷。

技術的發展,似乎在給這個社會帶來更多的疼痛。

結語

在歷史的傳統敘事中,人們喜歡將DeepFake這樣的事物歸結為原罪,比如魔丸轉世的哪咤,或者希臘神話中的阿多尼斯。但現代社會,我們並不這麽思考問題。

2014年,因P2P(peer to peer)分享傳輸技術而成為「宅男神器」的快播轟然倒塌,創始人王欣被逮捕。兩年之後,王欣在案件庭審中為自己和快播做出了一番經典的辯護—— 技術無罪。

在王欣的理論中,自己和快播只是創造了一項技術,至於使用者拿他做什麽,與他無關。

但這件事情並沒有回答,為什麽技術帶來的罪惡仍然頻頻出現。直到兩年後,在距離王欣受審的法院不到20公裏的地方,騰訊研究院舉辦了一場活動,它的主題是 「科技向善」 。

食,色,性也。

技術發展的難點,除了技術本身之外,更本質的難點在於,如何限制撬動人性「惡」的杠桿。而在騰訊的理念中,使用技術的人本身應該承擔起這樣的責任,人類應該善用科技,避免濫用,杜絕惡用。

如今,科技向善已經被越來越多企業接受,成為中國技術發展的一項底層理念,但科技向善,卻是一個更長久的課題。