智東西

作者 | ZeR0

編輯 | 漠影

在NVIDIA創始人兼CEO黃仁勛描繪的未來藍圖中,實作互聯的虛擬世界一直是重要願景之一。

黃仁勛將電腦圖形學、物理學、人工智能(AI)稱作NVIDIA的三個「靈魂」。用於構建和執行元宇宙套用的核心內容引擎NVIDIA Omniverse,便位於這三者的交匯處,它猶如未來數碼孿生的作業系統,為工業和科學案例模擬大規模物理精準的虛擬世界提供了基石。

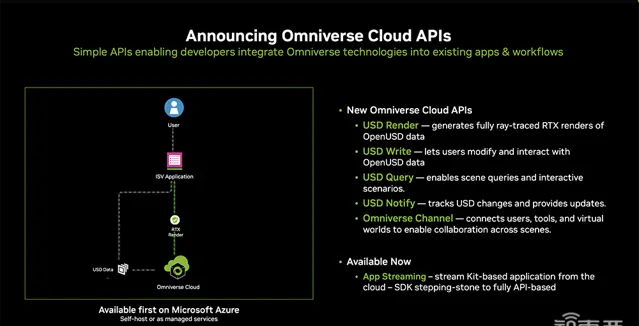

今年Omniverse的一大更新是提供Omniverse Cloud API。在3月舉行的NVIDIA GTC大會上,NVIDIA公布5個全新的Omniverse Cloud API,宣布將Omniverse企業級數碼孿生帶入蘋果Vision Pro,並分享了與西門子、微軟、羅克韋爾自動化等行業領先企業合作的落地套用進展。

面向未來數碼孿生,如何將大模型與Omniverse的協同?NVIDIA將在增強空間計算和高保真仿真體驗方面扮演怎樣的角色?近日,NVIDIA中國區高級技術市場經理施澄秋、NVIDIA中國Omniverse業務負責人何展對Omniverse最新進展進行了進一步分享與解讀。

NVIDIA Omniverse的數碼孿生已經涵蓋汽車、制造、媒體、建築、能源、科學運算仿真等行業。據介紹,Omniverse在全球的三個最新套用方向是數碼孿生工廠、產品設計、基於產品設計的配置系統。其支持團隊包括NVIDIA內部資源(售前技術團隊、售後技術團隊,還有技術演算法團隊等),傾註很多資源的個人及初創企業開發者,以及ISV合作夥伴。

一、5款全新API幫企業提效,降低引入Omniverse功能的門檻

很多行業使用者正在建立數碼孿生,來設計、模擬、構建、營運、最佳化整個資產及工作流程,提升營運效率,節省成本。

數碼化將使各行各業能夠構建1:1符合真實物理規律的數碼資產,透過精準的3D仿真和構建物理產品的環境,來幫助客戶、企業整個供應鏈、生產鏈、行業鏈裏各環節的人員實作降本增效。

NVIDIA Omniverse是一個構建和部署工業數碼化套用的技術平台,基於OpenUSD的方式,將已有的工具和數碼資產與全球最大的大規模設計和模擬行業生態系相連線。

Omniverse驅動的應用程式和相關軟硬件環境從根本上改變了復雜的3D工作流,使得個人、團隊乃至分布在各個不同地點的跨國企業,都能夠構建一個統一的工具和數據的工作流。

為了讓Omniverse更易存取,NVIDIA打造了Omniverse Cloud API。

(1)USD Render,利用RTX的強大功能,比如全光線追蹤渲染影像,而且這些影像數據是用符合業界標準USD的方式來描述的,也就是說已有的ISV程式下適用現在已經習慣使用的數據資產,用USD方式描述,就可以用USD Render來呼叫API,進行高階RTX GPU的渲染。

(2)USD Write,允許使用者修改OpenUSD場景中的數據,並能夠即時與之互動。

(3)USD Query,是實作整個場景的查詢和互動式操作。

(4)USD Notify,可以即時跟蹤USD更新的狀態,並且能夠即時通知使用者,比如我是A使用者,B使用者或者我的乙方做了一些小改動,可以即時通知我這個數碼資產有改動,改動了哪些地方。

(5)Omniverse Channel,可以用來連線使用者和工具在同一個場景中進行即時的協作。

以前要打造一個把Omniverse融入進去連線到雲端系統,企業需要專業知識和大量的人力、物力、時間去叠代已有版本,可能涉及到大範圍程式碼重寫。

NVIDIA中國區高級技術市場經理施澄秋解釋說,這相當於把一座房子裏面所有裝修都拆掉,從毛坯開始重新裝修,最後可能裝修得很漂亮;Omniverse Cloud API則相當於一個小規模翻新,不需要大拆大改,Omniverse Cloud裏的資源是隨時ready的,企業只需利用API裏的相應指令去呼叫想用的Omniverse功能,不需要重寫程式碼,能夠顯著降低開發門檻,提高效率。

這些API將會在今年晚些時候在微軟Azure雲上提供,支持開發人員自行托管或作為托管服務。

二、邁向AI時代的數碼孿生,AI大模型與Omniverse如何協同?

就像大語言模型在訓練過程中需要人類的反饋一樣,數碼孿生新時代也需要物理的真實反饋,來確保在虛擬環境中學習的AI能在物理世界中真實的1:1的執行。當3D虛擬世界連線到真實的物理世界時,企業就可以透過AI支持的監控持續執行,並最佳化他們的數碼孿生和物理孿生。

AI已經進入物理世界。NVIDIA Omniverse中國區業務負責人何展談道,NVIDIA AI Enterprise和Omniverse兩大平台正在開啟AI時代的數碼孿生。每一棟建築、倉庫、工廠都將實作AI並進行最佳化,新一代數碼孿生需要虛擬世界來訓練和測試AI,值得信賴的高效能AI需在一個遵守物理定律的數碼孿生世界中進行模擬、測試和驗證。

NVIDIA為自己的業務建立了Omniverse,打造了涉及自動駕駛、具身智能機器人、生成式AI、3D生成算、數碼人技術、氣象學研究、合成數據等一系列套用案例。同時,Omniverse也可以幫助更多的企業,涉及領域從研究、產品設計、運維、創意到市場和行銷。

AI大模型能夠把Omniverse和USD數碼資產連線起來。施澄秋提到Omniverse的元件ChatUSD可使用對話式AI進行USD存取。

例如在Omniverse裏想呼叫一個數碼資產,在場景裏放一盞燈,使用ChatUSD,說「給我放一個大概1.8米高度、60W左右,能夠適應30平方米臥室的落地燈」,它馬上就可以調出來。

談到AI數碼孿生的訓練部署對套用的具體要求,施澄秋主要提到三方面:效率,高保真,渲染。

對於應用程式而言,首先是訓練和部署的效率,效率決定一切;第二,高保真,意義在於渲染精度、模型精度、訓練精度,不同客戶對精度有不同要求,NVIDIA會區分不同場景做不同取舍的計算、渲染;第三,渲染到終端使用者的顯示器材上,最後渲染出的結果要漂亮、符合物理定律、有光線追蹤,渲染出的4K結果畫質要好,最終落到GPU算力上。

隨著自動駕駛汽車和機器人需求的增加,AI開發人員可能需要更多的傳感器數據來訓練、測試、驗證AI感知系統。這些感知系統可透過傳感器模擬方式去實作一個合成數據1:1數碼孿生世界,在Omniverse構建的虛擬世界裏進行訓練、測試、仿真、驗證等等。

這些合成數據需要物理上非常精確的符合物理定律的渲染。許多仿真生態系正使用Omniverse Cloud API來進行擴充套件、仿真、傳感器的工作流程,從而加快產品上市時間,能夠節省收集真實世界傳感器數據的巨額成本。

隨著Omniverse擴充套件到全球最大的工業軟件生態系,全球工業企業都可以加速軟件定義產品,並加速自主移動車輛、自動駕駛車輛乃至人形機器人、智能倉儲、大規模智慧城市等工作流程。

三、將Omniverse引入蘋果Vision Pro,做高保真體驗的「神助攻」

NVIDIA與蘋果合作,將Omniverse帶到Vision Pro上,使開發人員透過互聯網連線就能具備完整的RTX即時物理渲染特性的應用程式和數據集。

NVIDIA GDN是一個由圖形就緒數據中心組成的全球網絡,利用NVIDIA全球雲到邊緣流式傳輸基礎設施來提供流暢、高保真的互動體驗,可將先進的3D體驗流式傳輸到蘋果Vision Pro。透過將繁重的計算任務轉移到GDN,使用者可以處理苛刻的渲染用例,而無需考慮數據集的大小或復雜程度。

施澄秋分享說,由於流動通訊器材算力有限,本地運算很難得到一個非常理想的高保真最終渲染結果,因此結合遠端和邊緣的算力,以及用串流媒體的方式去呈現,可能是現階段比較現實和折中的一個理想解決方案。

Omniverse裏的GPU是ready的,是頂尖的RTX GPU。RTX GPU裏有三個核心點:1、傳統著色部份,可用來做像素渲染,確保畫面是美輪美奐的;2、光線追蹤加速,用包裹體便利的方式做即時光線追蹤,延遲更低,幀率很高,對使用者的互動性也更強;3、張量,RTX GPU裏都有針對張量運算的核心,能進行AI加速,比如像大模型、生成式AI、NeRF等。

雲端用Omniverse的API來打造和連線各式各樣的應用程式,再用基於USD或OpenUSD方式去打通數碼資產之間的連線和呼叫,最後透過RTX GPU的算力和高保真符合物理定律的即時光線追蹤的方式,去完成畫面渲染。即從原材料到粗加工、精加工,最後端上一盤可口的飯菜,能讓實實在在的3D空間場景呈現在蘋果Vision Pro使用者的眼前。

施澄秋說,人眼看到的分辨率受制於顯示器材。RTX GPU有很多復雜特性,能夠以較低精度去渲染沒看到的畫面,以高精度去渲染使用者當前看到的畫面,也就是說有相當多的視野以外的低精度預渲染方式在背景執行。它可能建立在一個運動預測和模型感知基礎上。

另外一個實作的方式就是AI,利用生成式AI可以動態即時支持破損畫面的修復,支持缺失像素的填補。因為有很多畫面是用低渲染度方式渲染的,也就是說4K分辨率可能只用1080p的分辨率去渲染,只渲染了1/4的像素,這時用生成式AI去渲染另外的3/4沒有被渲染出來的畫面,可以快速用一個1080p低渲染精度生成一個4K渲染。

遊戲開發商或基於Omniverse、基於虛幻引擎或Unity很多客戶做3D場景或數碼孿生構建時,也可以利用這個技術,即DLSS技術。這個不僅對於遊戲開發商有用,對於數碼孿生、數碼資產管理、VR/XR的方式同樣適用。

因為單眼4K分辨率太高了,要做光線追蹤、物理模擬很困難,必須要把算力推動到最集中的視野中間去。實作方式包括DLSS、neural graphic、NeRF等。

用AR/VR器材檢視內容時,如果頭轉動的時間跟畫面同步不匹配,就像人坐車一樣,大腦、小腦、眼睛看到的和運動感知的交感神經系統不匹配的話,就暈了,所以如果VR算得不夠快、延遲不夠低,可能會暈,甚至嚴重時會惡心想吐。

全保真也好、高保真也好,不僅看到的畫面要細膩、要逼真,分辨率要高,同時物理模擬,比如像雲、光影、火焰、粒子、空氣、動力,都要符合自然界真實的規律,同時還要能夠在頭顯器材上實作低延遲螢幕畫面的呈現。

結語:雲端3D內容落地空間計算,B端套用預計早於C端套用

展望雲端3D內容在XR空間計算上的套用趨勢,施澄秋認為,B端套用一定早於C端套用,當B端的套用做到比較成熟時才會推到C端去使用,因為C端使用者的體量更龐大。

在算力和整個基礎設施比較受限的現階段場景下,首先去滿足專業級使用者對於最嚴苛套用環境和場景情況的需求,因為這類使用者對成本的敏感性不高,對於基礎建設和使用的終端器材上投入預算的限制也沒有C端使用者那麽高。

當整個使用、擁有、營運成本降低後,AI或雲端的算力大幅提升,供給側短缺不像現在這麽受限,那時C端可能會真正蓬勃發展,遊戲、娛樂等行業就能透過VR/AR/XR的方式去實作。