接上文:

如何用AI再見到我的父親?(二)

如何用AI再見到我的父親?(一)

兩個小家夥天天活力無限,抱歉拖更有點嚴重,祝大家新年新活力,歲歲福滿堂。

一、和大家匯報下親音AI這款產品的進展

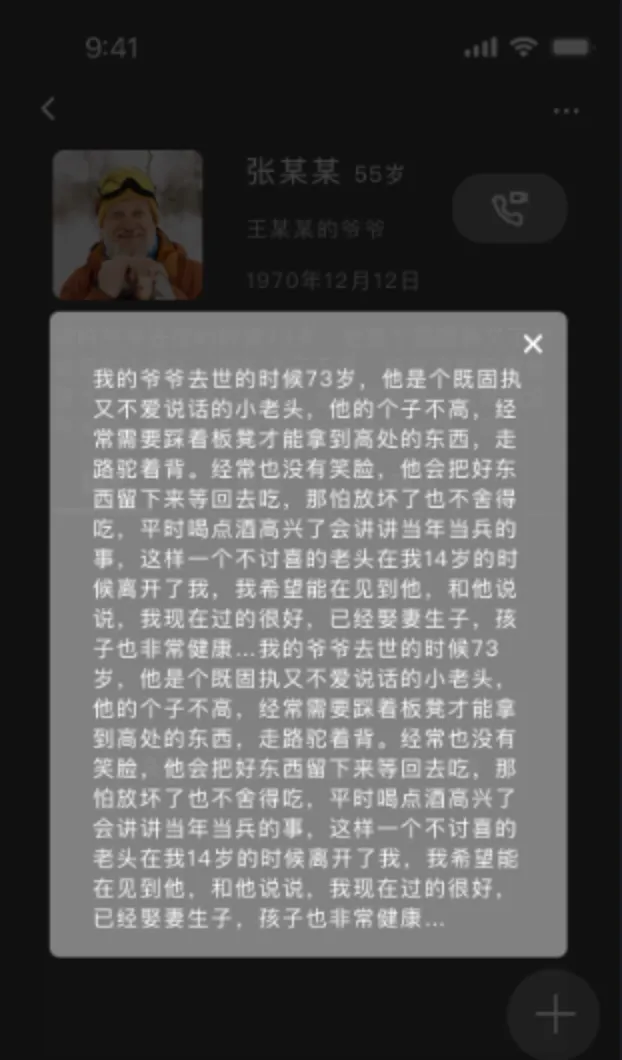

做這個產品的初衷,透過AI科技的途徑,見到已逝的心心念念之人,彌補心裏的遺憾,也讓AI變成有溫度的科技,而不是冷冰冰商業變現或是人力的替代,目前初版產品已經研發完成了,將即時的Taking Head轉換成文字方式,1.5版本會將即時影片放出來(WIFI環境下即時延遲5秒以內)。

發展方面,也有幾個投資人想要對這個產品進行投資,我還是想保持下初心,讓我的兩個孩子看看他們沒有見過的爺爺,投資的事項我可能要放後面一點,在另外一個時時Agent + RPA的專案上商業化,這個產品還是單純的自私一點。

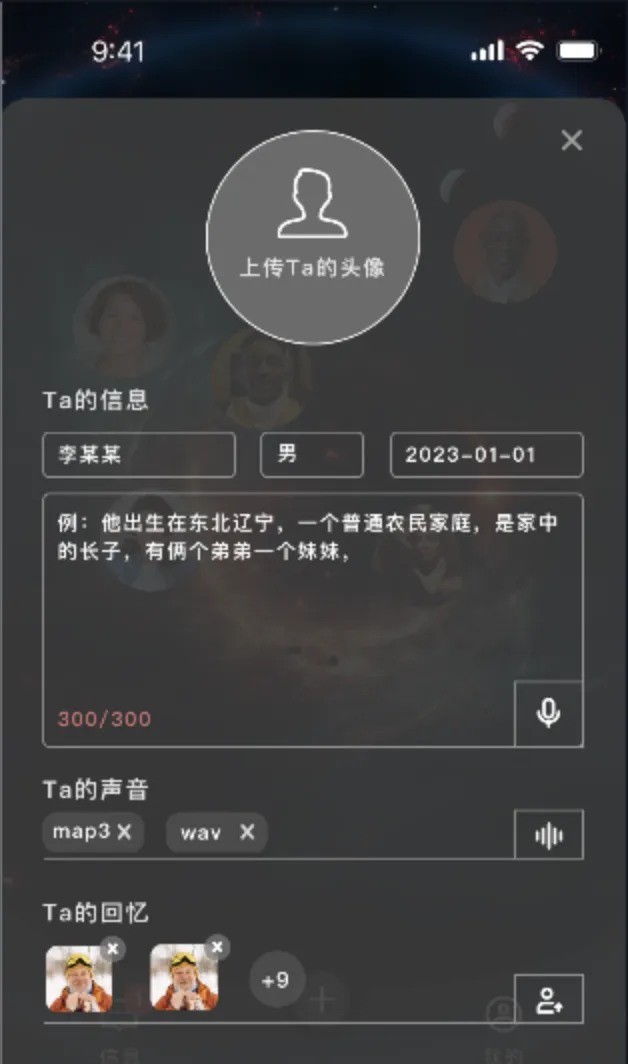

二、1.4版本的產品設計相關

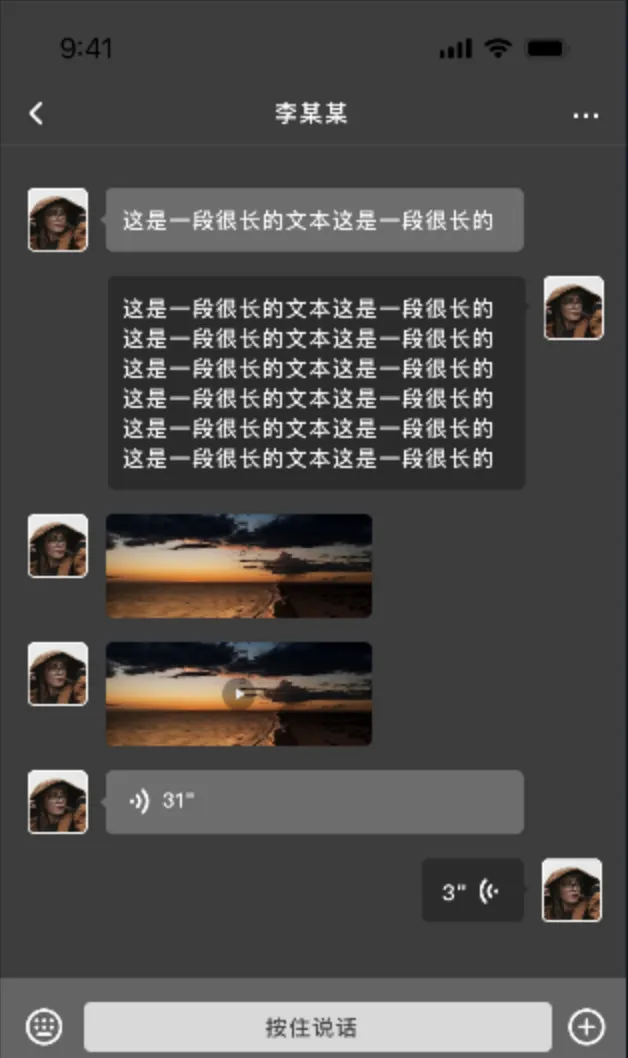

想來想去,還是V信是最習慣的溝通互動,所以你懂的像素級Copy,(這被設計師朋友作為了一生的恥辱,已經和我斷交了,設計了九個版本從0.5到1.4,最後改回了最初的互動,他說以後連眼神都不會和我進行交流...)

三、幾個版本的設計理念

1.4的版本設計中,智能體Agent可以主動的和人進行交流,圖片,語音,文字,影片都會主動的進行發送,當然這些還是基於規則層面的,還沒有達到一個智能體Agent該有的高度(能感知環境,感知交流人的情緒,安撫並善於溝通,獨立推理思考這些),近期也會釋出到套用市場,如果有需要內測的想夥伴,需要V(libonan_com)我下使用蒲公英進行安裝。

1.5版本中,會加入基於RAD-NERF的即時影片相關的能力,這個改動會相對大一些,1.5版本才是我最最想要的東西,所有的思考都是源於視覺化的即時交流。

1.6版本中,會將采用AI Agent框架重寫下,當前智能體的交流方式,從被動Prompt,到主動使用網絡攝影機感知交流者的情緒、當前環境,為智能體創造一個可以生存的虛擬靈域,這個並不是天方夜譚,一個微模型的環境中,有人類所需要各種設施,智能體可以生活在這個小鎮中,彼此可以交流並保持長期記憶,每一次的溝通智能體都會更像自己的心心念念之人。

四、即時Agent的一些思考和技術實作

目前采用的是基於RAD-NERF的低緯特征進行音訊面部驅動的,說實話論文的中的理論部份沒看懂,好多公式還得先Google下才能稍稍理解,通俗來講就是根據一段影片,先分離音訊,將影片分為一幀一幀的影像,然後透過3DMM等模型分割人像,加入背景圖片進行頭部、唇部、身體部份訓練得到訓練好的人物模型,最後透過文字轉語音驅動當前的任務進行Talking head,即時將每一幀推播給需要的播放端,所以對產品的挑戰就是,需要有人物的聲音,影片,作為訓練素材,背景不能有雜音,影片動作需要有規範。

一些改進的思考,首先speech to text耗時有一些,目前一些模型也支持,語音生成語音openai 或是達摩院的一些產品,可以省去音訊轉換部份的IO消耗及網絡相關的耗時,推流部份應該前後有銜接動作或是語音的暫停1-2秒,更好的銜接,還有就是虛機配顯卡的環境適合測試,真正使用還是需要物理機,推理效能提高10%以上,還是有很大幫助的,這部份我會單獨釋出下包括後面的源碼,感興趣的朋友留言關註,加V(libonan_com)交流。

最後,還是保持初心,科技是生活的一部份,不是全部,身邊的人是最需要關註的。

未完待續。