9月4日,2024外灘大會在上海開幕的前一天,一條人工智能相關的新聞沖上網絡熱搜:外灘大會全球Deepfake(深度偽造技術)挑戰賽的參賽選手之一,中國科學院的「95後」女性演算法工程師張欣怡宣布,已將近期參加挑戰賽的AI模型向全球開源,希望以此降低Deefake對抗的使用門檻,援助Deepfake受害者,守護真實世界。

結合近期南韓互聯網爆出的Deepfake女性受害事件,張欣怡的做法在網絡刷屏。人工智能的套用與擔憂再次成為飽受集體關註的公共性事件。

探尋2024外灘大會,AI等未來技術不再是空想,大量的落地套用已經成為展會主流。向外界展示如何用好AI、管好AI是本屆外灘大會和過去最大的不同。無論想與不想,安全與風險,人工智能都在迅速地改變現實世界。

AI套用勢如破竹

多年前,金庸先生在接受采訪時透露過他的文學創作門道:先構思好人物性格,然後再按設定好的人物性格去編情節。這可能代表了許多人類作家的文學創作思路。

金庸先生肯定不會想到,如今機器也是循著同樣的路徑創作作品的(雖然我們還不能確定機器的創作是不是真的稱得上作品)。在本屆外灘大會的現場,有關輔助創作的大模型產品層出不窮,有的定位於幫寫作者梳理寫作線索和思路,生成思維導圖;有的定位於幫寫作者完成擴寫,豐富文章內容;甚至還有工具可以幫助創作者將剛剛寫好的故事生成影片,頃刻之間,想法已經轉化成多種形態的作品。

不僅是模仿人、替代人完成一部份工作,人工智能甚至可以超越人類,完成一些過去很難實作的任務。2020年,麻省理工學院的研究人員宣布發現了一種新型抗生素,能夠消滅此前對所有已知抗生素都有耐藥性的細菌菌株。傳統上,一種新藥的研發需要研究人員從上千種潛在分子著手,透過不斷試錯,篩選出少量候選分子。麻省理工學院則另辟蹊徑,讓人工智能參與篩選分子數據庫,最終在6.1萬個分子中找到一個符合標準的,研究人員把它命名為海利黴素(Halicin)。

近兩三年,人工智能快速發展,人們大膽預測:它正在「接管藥物研發」「改變好萊塢講故事的方式」,並可能「改變科學本身」。它的一些能力甚至已經超越了人類的理解。

雖說預期有無限可能,但人工智能究竟能做什麽、不能做什麽,我們依然沒有完全確定。只是業界發現,越大的模型、越多的數據,就有可能讓人工智能更加智能。業界把它稱作「規模法則」(scaling laws),也有人更具象化地說成是「暴力美學」。

我們也還沒有完全確定,現有的千行百業如何嫁接人工智能的魔力。到目前為止,人工智能只在一些特定領域顯示了超凡的能力,比如人臉辨識、文字轉譯、內容生成……但是人工智能模型不擅長邏輯和推理,因而也不清楚自己的輸出是否符合人類需求,它依賴人類來界定它所解決的問題。就像發現海利黴素,人工智能需要人類為目標分子設立標準:能夠殺死致病菌、與現有抗生素不同、無毒。

也許更多模型參數、更大數據量能改善人工智能的邏輯和推理,使它湧現出更高智能。但「規模法則」是否有邊界?起碼現在看來,人工智能只是精心制作的程式碼,沒有生命或自主能力。人工智能的革命效能力仍然依賴於人類的判斷。

2024外灘大會上展示的一些AI輔助辦公工具。

數據問題仍需解決

人類是如何學習的?這個問題很難有一個簡單的回答。我們耳濡目染,我們歸納推理,我們做科學實驗,我們甚至去天馬行空地冥想。人類學習不依賴於某種單一途徑。

人工智能的學習方法和人類迥異。當前人工智能普遍運用一種叫作「深度學習」的方法。在這種學習方法中,人工智能依據數學和統計學方法處理大量數據,從中獲得某種規律。數據是人工智能的食糧,數量越多、質素越高,就意味著人工智能可能有越優良的表現。谷歌和Meta的人工智能模型已經接受了超過1萬億個單詞的訓練。要知道,維基百科的總單詞量只有約40億個。

在外灘大會的提前探訪中,不少AI企業都提到了數據的問題:高質素數據的生成速度遠低於人工智能大模型的需求,數據短缺問題已初現端倪。研究機構Epoch AI預計,可用於訓練的高質素文本可能在2028年前耗盡。在中文世界,數據問題更加棘手。阿裏研究院5月釋出的【大模型訓練數據白皮書】顯示,互聯網上中文語料和英文語料占比存在顯著差異:在全球網站中,英文占比高達59.8%,而中文僅占1.3%。在業界,數據短缺問題也被稱為「數據墻」。 如何處理這堵墻迫在眉睫。

一種方法是註重數據質素而非數量。人工智能企業對數據進行過濾和排序,以最大限度地提高模型的學習效率。關於世界的真實資訊顯然很重要,邏輯推理也很重要。因此,學術教科書(而不是未經篩選的互聯網數據)就顯得尤為珍貴。

另一種方法是使用合成數據,這些數據由機器建立,因此是無限的。谷歌子公司DeepMind制作的圍棋模型AlphaGo Zero就是一個很好的例子。AlphaGo Zero沒有使用任何已有棋譜數據,而是透過自我對弈490萬次來學習圍棋,並記錄下獲勝的策略。這種「強化學習」透過模擬大量可能的應對方法,並選擇勝算最大的,教會模型如何應對對手的棋步。

就像深藏地底的石油驅動了工業進步,散布在互聯網和人類文本中的數據驅動了人工智能不斷升級。但在不久的未來,石油、數據終將枯竭,我們需要尋找新的、可再生的替代品。

數據在未來會變成像石油一樣的寶貴資源。

安全擔憂從未停止

一個擺在人們面前的問題是,隨著AI落地套用的普及,越來越多由AI引發的倫理安全風險也隨之暴露。

8月底,一場對Deepfake濫用的聲討席卷南韓互聯網。事件的起因是有部份南韓網民在社交媒體上傳播用Deepfake技術制造的「換頭」色情圖片、影像,被涉及物件有女明星、女學生,甚至有未成年女孩。

Deepfake「換頭」,通俗來說就是使用人工智能生成技術,將不同個人的聲音、面部特征和身體動作拼接起來,合成虛構的影像或影片。

這些用AI技術合成的影像、影片幾乎以假亂真,被用於制作和傳播不僅嚴重侵犯了個人私密權和名譽權,更對涉及女性心理造成了深刻的負面影響。

人們不得不承認,客觀上,AI技術的快速發展加劇了犯罪手段的更新。今年年初,國外「文生影片」套用軟件Sora曾刷屏互聯網。當時即有人提出,人工智能生成技術發展太快,內容很容易不受控制,被套用於黃色、犯罪產業。

考慮到內容生產上的風險和成本控制,截至目前,Sora模型尚未正式向公眾免費開放。OpenAI選擇向一組精選的「紅隊成員」開放Sora,這些成員是專門評估AI模型風險和辨識潛在問題的專家,他們將從各個角度「對抗性」地測試這個模型。

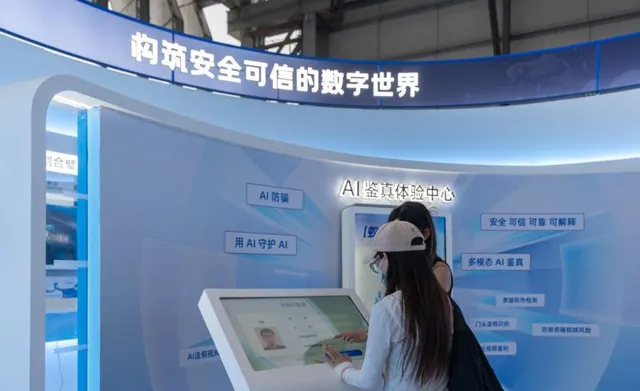

為了解決這些AI內容生成安全問題,業界已經開始了探索。在本次外灘大會的前沿科技展區,專門設立了一所未來安全實驗室,囊括了多個國內互聯網安全、AI安全和檢測的前沿產品,其中就包括了螞蟻集團蟻天鑒推出的「AI鑒真」解決方案。參觀者可以現場對AI生產的圖片、影片、音訊進行鑒定。

螞蟻大安全的一位工作人員告訴記者,目前大部份利用AI生成技術進行的違法活動都是批次化生產,單個目標的偽造成本不會很高,透過對抗模型的構建,一般都可以甄別其真偽。尤其在影像辨識領域,準確率甚至可達99.99%。

此外,本次外灘大會首次舉辦的AI創新賽還專門設立了全球Deepfake挑戰賽,邀請來自海外高校的技術團隊,聚焦國際最熱的安全、欺詐風險問題,探索更多Deepfake對抗技術。

外灘大會設立的「AI鑒真」展台

AI已經無處不在

盡管人們對AI還不能完全掌控,但市場對AI套用的熱情並不會就此停下。

可能在不知不覺中,普通人的生活就已被AI產品包圍。除了前文提到的兒童手表,AI大模型可以嵌入一切智能器材,例如智能電話、智能音箱、智能家電等。再大一點,內建了AI大模型的智能汽車也已經問市多時。

就拿AI上車來說,目前已有蔚來、理想、小米、智己等多家車企宣布將AI大模型嵌入汽車的智能座艙,以實作使用者和車機的智能語音互動。更重要的是,AI技術突破正在幫助全球智能駕駛研發提速,無人車正離人類越來越近。

近期武漢的「無人出租車」爆火後,其「無人駕駛」技術曾受到多方質疑。很多人猜測,「無人出租車」之所以能夠無人駕駛,是有駕駛員線上上遠端控制,全靠真人遠端代駕。實際上,「蘿蔔快跑」出租車雖然配備了遠端操控員,但操控員並不會直接幹預汽車的駕駛,只會在極端情況發生時對車輛進行接管,而且一人負責監測多台汽車。商業出租車能夠實作無人駕駛,正是因為AI技術的賦能,讓車機能夠即時處理來自傳感器的數據,辨識道路狀況,做出駕駛決策,如加速、減速、轉向等。

這就是一則AI影響人類生活影響的直觀案例。技術的突飛猛進正在改變車主的生活,甚至司機的生活。不少人可能會因此失業,但新的就業機會也在AI產業浪潮中不斷湧現。

在上海臨港,一批過去從事網約車行當的司機已經上崗無人車安全員。賽可智能測試車隊的一名安全測試員告訴記者,在測試車隊上班,一天8到10個小時,薪金和過去開網約車差不多,都能過萬元,但是工作量確實小了不少。這種新的生活方式正在逐漸被大眾所接受。

本文作者:宰飛 吳丹璐