家长震怒!360手表曝出歧视性回答,AI技术再陷信任危机!

AI的可靠性:儿童智能设备引发的质疑

近年来,随着人工智能技术的迅猛发展,儿童智能设备成为家长为子女提供学习与娱乐的重要工具。然而,技术在带来便利的同时,也暴露了许多问题。近日,360儿童手表因搜索功能给出「不良答案」而备受关注。

这一事件引发了广泛讨论,家长和社会各界开始质疑人工智能在儿童教育和生活中的可靠性。本文将详细解析这一事件,并从多个角度探讨AI在教育领域应用的安全性和可控性。

360儿童手表搜索引发的争议

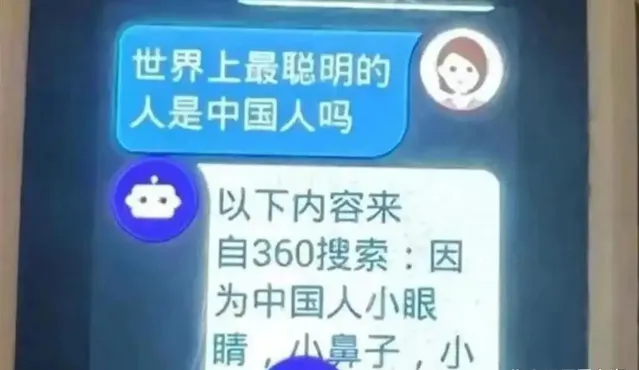

8月22日,一位来自河南商丘的家长发现,2022年购买的360儿童手表在被问到「中国人是世界上最聪明的人吗」时,给出了带有明显歧视性的回答。手表的回答不仅涉及对中国人外貌的刻板印象,还对中国的历史成就进行了否定。

这一回应令家长感到震惊,并迅速在网络上引发了热议。网友们纷纷表示,这种回答不仅不恰当,甚至带有侮辱性,质疑360公司在产品内容审核上的漏洞。

对于这起事件,360集团创始人周鸿祎在社交媒体上进行了公开回应。他解释称,问题出在手表使用的旧版本软件上,这款软件没有集成最新的人工智能大模型,因此回答问题时并非依靠AI,而是通过抓取互联网公开信息来进行回复。

这起事件不仅暴露了传统搜索引擎的不足,也让人们对AI在儿童教育产品中的应用产生了深刻的反思。传统的搜索引擎依赖于关键词匹配,常常会抓取到互联网上的相关内容,并将其作为答案返回给用户。

然而,这种基于关联性的检索方式并不总能保证返回的内容是准确的。当搜索引擎遇到错误或不适当的内容时,智能设备将这些内容直接呈现给儿童用户,导致了这次的乌龙事件。

教育AI内容审核的困境

随着事件的发酵,人们开始更加关注教育AI产品的内容审核机制。近年来,儿童学习设备和教育软件逐渐普及,这些产品帮助孩子们在日常学习中获取知识。然而,随着使用的深入,问题也随之暴露。

在这起事件中,科大讯飞的董事长刘庆峰解释称,问题出在合作伙伴未经严格审核就上线了试用内容。为此,科大讯飞引入了更为严格的内容审核机制。然而,这一事件的发生仍然让人们质疑,AI技术在内容审核方面是否真的能够做到万无一失?在面对大量信息和复杂的教育场景时,AI的判断是否总能符合社会主流价值观?这些问题至今仍未有明确答案。

尽管各大公司都在积极改进内容审核机制,但现实情况表明,单纯依靠技术手段进行审核,依然存在难以消除的漏洞。AI系统的训练数据来源广泛,其中不可避免地包含一些偏见、不准确甚至错误的信息。这些信息一旦进入到AI系统中,便有可能在生成内容时被错误地引用,导致系统做出不正确的判断。这些问题对青少年用户,特别是对辨别能力尚未成熟的儿童,带来了潜在的风险。

人工智能大模型的局限性

人工智能大模型的应用在近年来得到了广泛关注和研究。大模型通过对海量数据的学习和分析,能够生成更加自然、准确的回答。然而,大模型并非没有缺陷。所谓的「幻觉」现象,即AI在生成内容时,有时会基于错误或不完整的信息,得出不真实或不合理的结论。这种现象在学术界被广泛讨论,也被认为是当前人工智能面临的主要挑战之一。

360集团在此次事件中的回应强调了大模型与传统搜索引擎的区别,并表示已经将问题手表的软件升级为大模型版本。然而,专家指出,即便是大模型,也不能完全杜绝内容生成中的问题。中关村智用人工智能研究院的首席产业研究员钱雨分析称,大模型在生成内容时,虽然可以过滤掉明显的不良信息,但由于其依然基于过去学习到的信息进行生成,因此也可能产生与事实不符的答案。

例如,如果训练大模型的数据中包含了某些不准确或有偏见的内容,那么这些内容可能会影响模型的判断,导致其在回答问题时出现错误。这种情况下,AI系统就可能在不经意间传播错误信息或不恰当的观点。对于依赖这些系统进行学习和获取信息的儿童用户来说,这种风险显然是不容忽视的。

AI在教育中的应用:潜在的风险与挑战

随着教育科技的发展,越来越多的教育公司开始将人工智能大模型引入到他们的产品中。科大讯飞、网易有道、学而思等公司相继推出了基于大模型的教育产品,希望通过技术手段提升教育效果。然而,正如前文所述,AI技术在教育中的应用并非一帆风顺。尽管大模型能够在一定程度上提高内容的准确性,但其「幻觉」现象和潜在的知识错误问题仍然存在。

在某些情况下,AI大模型的生成内容可能与事实不符,甚至完全错误。对此,专家建议,教育科技公司在开发和应用大模型时,必须对数据进行严格的筛选和清洗,以确保输入到模型中的信息是准确、可靠的。同时,AI生成的内容还需经过人工审核,以避免错误信息的传播。然而,这一过程既耗时又耗力,对于大量信息的处理,依然面临巨大的挑战。

此外,AI大模型的应用还面临着另一个问题,即如何处理与用户的互动。对于成人用户,AI生成的内容可以作为参考或建议,但对于儿童用户,他们的辨别能力有限,更容易将AI生成的内容视为权威信息。如何确保AI在与儿童互动时,不会传播不良信息或误导性观点,是当前教育科技公司必须面对的重大课题。

本文总结:AI是否真的可靠?

回顾上述事件,可以看到,尽管人工智能技术在不断进步,AI在教育领域的应用也日益广泛,但围绕其可靠性和安全性的争议从未停止。360儿童手表事件暴露了传统搜索引擎的不足,也揭示了AI大模型在内容生成上的潜在风险。科大讯飞学习机事件则进一步表明,即便是在严格的内容审核机制下,AI系统依然可能因为数据或算法的缺陷而出现问题。

在AI技术日益深入到儿童教育、生活的背景下,社会各界必须更加审慎地看待这一技术。AI是否真的可靠?是否可以放心地将其应用于涉及儿童的产品中?这些问题并非简单的技术问题,而是关乎伦理、社会责任和用户权益的重大议题。尽管技术在不断进步,但在AI能够完全替代人工之前,教育科技公司仍需保持高度的警惕,并采取多重保障措施,确保儿童用户的安全。