作者 | 程茜

編輯 | Panken

芯東西3月26日報道,上周,在AMD AI PC創新峰會上,AMD董事會主席及CEO蘇姿豐盛贊AI PC,並秀出了AMD 大舉布局AI PC的肌肉。

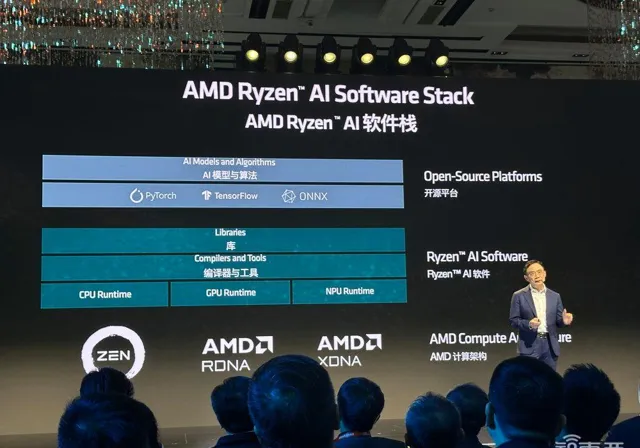

在技術布局上,AMD利用了三種計算引擎:基於「Zen」架構的CPU,基於AMD RDNA 的整合或獨立GPU,以及基於AMD XDNA的AI引擎NPU,來滿足對於延遲、計算、功耗等有不同需求的AI套用。

具體來說,AMD高級副總裁、GPU技術與工程研發王啟尚在峰會現場重點介紹了4種不同架構,也就是為了滿足廣泛的AI需求,AMD從雲、邊緣到終端開發的4種不同架構,其中,Zen主要用於通用處理和AI推理,CDNA用於HPC、AI訓練與密集推理,RDNA用於遊戲和基於AI的內容開發,XDNA聚焦於低功耗、一直線上的AI推理需求。

隨著豐富的大模型套用出現,使用者對其的感知更高且需求更為明確時,會有很多工作負載可以在與使用者距離更近的邊緣端、終端執行。因此,王啟尚認為,未來的發展方向會更偏向數據中心執行的基礎模型、本地執行的模型相結合的「hybrid AI」(混合人工智慧)方式。

在這背後,AMD的優勢在於已經全棧布局了面向數據中心、邊緣端、終端的技術基礎,能覆蓋AI從雲端到邊緣端,甚至終端的生態鏈,實作端到端最佳化。

AMD AI PC創新峰會後,芯東西等媒體與AMD高級副總裁、GPU技術與工程研發王啟尚進行了深入交流,深入剖析面對AI PC這一新物種,AMD在其中扮演了什麽樣的角色,以及背後的技術秘籍。

▲AMD高級副總裁、GPU技術與工程研發王啟尚

一、3大原因加速推動,AI PC換機潮將湧現

去年,AI PC概念首次出現,並被定義為AI PC元年,IDC的數據預測顯示,2024年中國AI PC新機出貨占比將超過50%。可以看出,AI PC的市場滲透率正在加速增長。

相比於目前可以在AI PC上使用的生成式AI套用而言,AI PC將會帶來一波換機潮。在王啟尚看來,這背後涉及三大原因。

首先,AI PC支持在地化使用AI軟體和工具,並且能夠離線使用。

第二點是具有很好的私密保護功能 ,如果使用者透過AI來處理一些私人檔和照片時不希望上傳到雲端去做處理,透過AI PC就可以實作在地化處理,使得使用者的AI使用需求得以滿足的同時,也確保了個人私密的保護。

與此同時,相比於透過雲端AI處理方案,AI PC則是在在地化進行任務處理,有效解決了延遲問題,提升了效率,因為它不需要像雲端作業那樣,等待上傳和反饋。另外,雲端的AI套用也並非免費服務,使用者使用AI PC就可以享受到原生在地化AI服務,只需要花費購買電腦的費用,而不需要再為AI套用軟體額外付費。

第三點是在內容創作方面,因為 AI PC已經具備了基礎AI能力 。所以,當使用者使用辦公軟體或召開視訊會議的時候,不需要再另行載入AI工具進行輔助操作和效果最佳化,例如制作投影片時需要透過AI軟體提供靈感支持;召開視訊會議時需要美顏效果和背景模糊處理等,AI PC已經內建了這些原生態功能,可以直接幫助使用者實作這些基礎的AI套用需求。

這背後將AI套用部署到AI PC中時,王啟尚解釋說,AMD的 XDNA架構 將AI部署到AI PC上的使用者體驗中,主要依賴於其特殊的設計和架構。它可以將架構區分成不同的區域,每個區域同時處理任務而互不幹擾,這一點是傳統的GPU架構所不具備的能力。另外,XDNA的每瓦效能非常高,因此可以在低功耗的條件下執行AI工作任務,並且實作多工並列處理,帶給使用者新一代的作用系統和更優質的使用者體驗。

二、絕對算力+每瓦算力效能提升,應對多元化算力需求

今年年初,OpenAI的文生視訊模型亮相,其驚艷的視訊生成效果震驚大模型產業。當越來越多能力強大的大模型走向雲端或本地時,算力無疑會面臨嚴峻的挑戰。

王啟尚認為:「我相信未來對算力的要求會越來越高,無論是在雲端還是本地。就我個人而言,認為未來的發展方向會更偏向 「hybrid AI」(混合人工智慧)方式 。也就是透過數據中心來進行基礎的大模型訓練與推理,日常功能性的需求則透過AI PC在在地化進行處理,不再需要將需求上傳至雲端。這樣不但可以實作節能並降低延遲,還可以省去很多花費,又保護了私密安全。」

此外,他補充道,並不是所有問題都需要透過大型數據中心解決,「混合式AI」是一個不錯的解決方案,讓雲端數據中心和在地化AI PC各自執行相應的任務,這樣並不但能解決高功耗問題,還能夠提升效率。因此,這也是一個有效解決「電力荒」問題的方案。

談到Ryzen Al軟體平台時,王啟尚稱, Ryzen AI軟體 已經具備了定向編譯能力,即可以將編譯任務指定派發給CPU、GPU或NPU來執行。三者的運算單元各有其自身的優勢。AMD希望可以實作智慧化編譯,透過對任務進行需求分析,根據硬體架構,智慧化地分配給CPU、GPU或NPU,使得不同型別的編譯需求分配給最適合的角色進行處理,使得CPU、GPU、NPU實作智慧聯動,充分發揮各自的優勢能力。

除了絕對的算力提升外,AMD還在關註每瓦算力效能的平衡。

王啟尚提到了數據流架構DataFlow,傳統的GPU架構的工作模式是把任務逐層傳遞,並且在顯卡和記憶體之間反復執行「讀」與「寫」的動作,使得PC的功耗增大。

而數據流架構則可以並列執行「數據存取」和「數據計算」不需要逐級執行任務,這種架構可以消除指令操作導致的額外時間開銷,避免了運算單元和外界視訊記憶體之間的多次往返互動,從而使得每瓦效能得以提升。

結語:AI PC加速PC產業新周期到來

隨著大模型落地部署加速,諸多端側、邊緣側裝置中湧現了承載大模型套用的能力,尤其是作為人們日常的生活、娛樂、工作工具的PC,與大模型有著天然適配性。

作為PC芯片玩家,AMD基於自己豐富的技術布局,對無論基礎模型還是在端側部署的小模型都進行了最佳化,在此之上,會推動更多具有創新套用的AI PC產品面世。