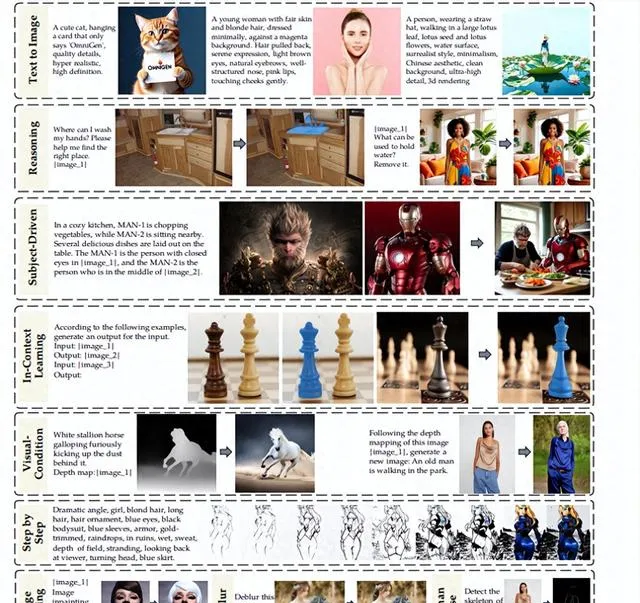

OmniGen 展示了在單一框架內執行各種影像生成任務的能力

當前,多模態生成模型如文本到影像(Text-to-Image)和影像編輯等任務通常需要不同的專用模型,這給開發和部署帶來極大不便。 OmniGen 提出了一種全新的通用生成框架,不僅能夠應對不同輸入模態的組合,還能處理各種復雜的視覺任務。OmniGen的設計整合了多模態註意力機制,使其可以適應各種任務需求,並極大簡化了多模態生成模型的訓練和套用。

1. OmniGen 的技術核心與創新理念

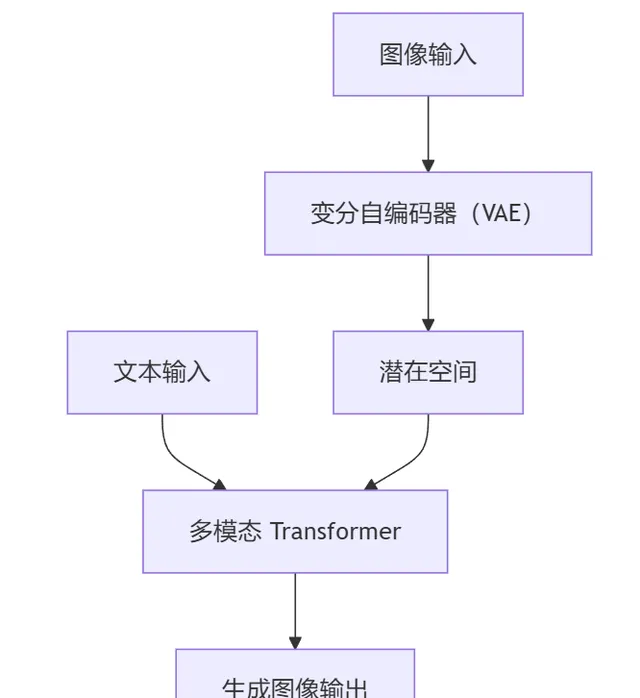

OmniGen 的設計思路基於「簡約而強大」的理念,采用單一架構來適配多種模態任務。它結合了 變分自編碼器(VAE)和Transformer 的設計,極大提高了在生成任務上的靈活性與可延伸性。

1.1 通用性與適應力

OmniGen 的最大優勢在於其通用性:透過對多種模態的支持,它能夠在不同任務中輕松切換。這種適應力主要體現在兩個方面:

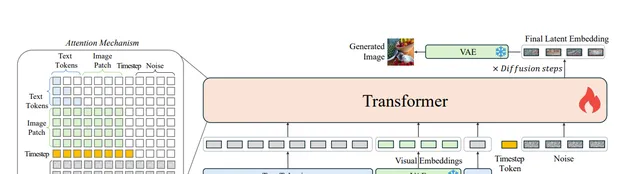

2. OmniGen 的架構設計

OmniGen 的核心元件包括 變分自編碼器(VAE) 和 Transformer 生成模型 。VAE 負責將輸入影像編碼成潛在空間,而 Transformer 則根據輸入條件生成影像。

2.1 變分自編碼器(VAE)

OmniGen 使用 VAE 將輸入影像壓縮為潛在向量。這些向量不僅包含影像的基本特征,還能透過進一步最佳化捕捉影像的細節資訊。VAE 的輸出向量是後續 Transformer 用於生成的基礎。

VAE 設計的重點在於保持生成的潛在空間具有豐富的資訊量,同時壓縮冗余數據,以便在後續任務中高效處理。

2.2 多模態 Transformer

OmniGen 采用了大型 Transformer 架構來處理多模態資訊輸入。該 Transformer 不同於一般的語言模型,它具備 多模態註意力機制 。具體而言,OmniGen 的 Transformer 透過針對不同模態的註意力機制,選擇性地關註輸入的關鍵特征。

OmniGen 的 VAE-Transformer 設計結構

VAE-Transformer流程

透過這種設計,OmniGen 能夠有效地將文本、影像和其他模態組合在一起,生成具有高度一致性和準確性的視覺輸出。

3. 關鍵技術細節與創新點

3.1 多模態註意力機制

OmniGen 的多模態註意力機制使其能夠在不同模態之間自由切換。例如,在同時接收影像和文本輸入時,Transformer 可以動態調整關註的模態資訊,確保生成的影像不僅符合視覺特征,還能忠實於文本描述。

這種註意力機制實作的關鍵在於透過額外的權重調整,將不同模態的資訊融合在一起,使得模型在生成過程中始終保持資訊的一致性和全面性。

3.2 條件生成的適應修正

在條件生成任務中,OmniGen 的適應修正功能能夠在多次叠代中不斷最佳化生成結果。透過引入一個校正流程,OmniGen 可以根據之前生成的結果調整後續生成過程,以確保生成影像與輸入條件的高度吻合。

這種自適應的生成機制有效提高了生成品質,使得 OmniGen 在各種任務中均能保持高標準的輸出。

4. OmniGen 的訓練方法

OmniGen 的訓練策略在於利用 多階段的分辨率提升訓練 和 最佳化流機制 。這種分層次的訓練方式確保了模型可以在不同分辨率下最佳化生成品質。

4.1 多階段分辨率訓練

OmniGen 在不同分辨率階段逐步進行訓練,使得模型能夠從低分辨率的粗略特征逐步學習到高分辨率的細節資訊。這種方式不僅保證了模型的訓練效率,還使得模型能夠生成高品質的細節豐富的影像。

4.2 最佳化流機制

最佳化流機制幫助 OmniGen 在生成過程中逐步調整生成路徑。這種機制透過監控生成結果的變化情況,自動調整模型參數,以確保在生成過程中減少失真。

5. 使用 OmniGen 的方法

5.1 安裝與依賴配置

首先,使用者可以透過以下命令複制 OmniGen 的程式碼庫並安裝所需的依賴。

#! /bin/bashgit clone https://github.com/staoxiao/OmniGen.gitcd OmniGenpip install -e .

5.2 執行gradio演示

對於原生的 gradio 演示,你需要安裝 pip install gradio spaces ,然後你可以執行:

#! /bin/bashpip install gradio spacespython app.py

結語

OmniGen 憑借其靈活的多模態註意力機制和統一生成框架,徹底改變了傳統多模態模型的局限。透過單一架構實作多模態任務的能力,使 OmniGen 成為 AI 影像生成領域的標桿。未來,我們可以期待 OmniGen 在各個領域的更多套用,為 AI 的通用生成帶來更多創新突破。

相關連結 :

您好,我是「碼農創業園」,長期致力於AI前沿技術的發現與研究,如您也有相同的興趣與愛好,不妨關註我,大家共同學習,共同進步。