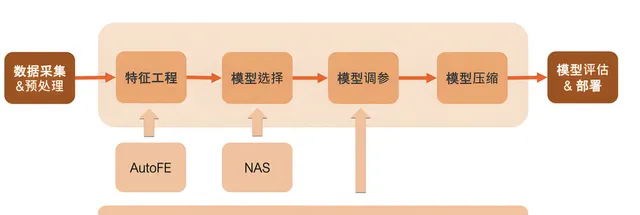

什么是「调参」?

调参 就是调整模型的 超参数 ,以使模型在处理特定任务时表现得更好。超参数是那些在模型训练之前需要手动设置的参数,而不是通过训练数据自动学习到的参数。

模型参数(Model Parameters) vs. 超参数(Hyperparameters)

- 模型参数(Model Parameters):

定义 :模型参数是在训练过程中通过数据自动学习到的参数。这些参数决定了模型的具体形式和性能。

例子 :在训练一个线性回归模型 y=mx+b y = mx + b 中,m m 和 b b 就是模型参数。它们是通过训练数据自动调整的,以最小化预测误差。

- 超参数(Hyperparameters):

定义 :超参数是在训练模型之前由用户手动设置的参数。这些参数控制了模型的学习过程和结构。

例子 :在训练一个神经网络时,学习率(learning rate)、迭代次数(number of epochs)、隐藏层的层数和每层的节点数等都是超参数。这些参数在训练前需要手动设置。

想象一下,你在玩一个游戏,游戏里有一个角色,我们来比较一下模型参数和超参数。

模型参数(Model Parameters) :

超参数(Hyperparameters) :

简单来说:

举个例子

假设你正在烤面包,烤面包的过程就像训练一个机器学习模型。在这个过程中,有一些关键的参数会影响最终面包的质量,比如:

- 烤箱温度 :相当于模型的 学习率 (learning rate)。温度太高,面包会烤焦;温度太低,面包可能烤不熟。

- 烤制时间 :相当于模型的 迭代次数 (number of epochs)。时间太短,面包没烤好;时间太长,面包会变干硬。

- 面团的配方 :相当于模型的 结构 (比如神经网络的层数、每层的节点数等)。不同的配方会导致不同的面包口感。

如何调参?

- 试错法 :最简单的方法是尝试不同的参数组合,看看哪个效果最好。比如,你可以先用180度烤10分钟,尝尝味道,如果不好再调整温度和时间。

- 网格搜索 (Grid Search):这是一种系统的方法,你定义一个参数范围和步长,然后尝试所有可能的组合。比如,你可以设定温度为160度、180度、200度,时间分别为10分钟、15分钟、20分钟,然后分别烤面包,比较哪个组合最好。

- 随机搜索 (Random Search):与网格搜索类似,但不是尝试所有组合,而是随机选择一些参数组合进行测试。这样可以在相同的计算资源下探索更多的参数空间。

- 贝叶斯优化 (Bayesian Optimization):这是一种更高级的方法,通过建立一个概率模型来预测哪些参数组合可能效果最好,然后逐步优化这些参数。

为什么调参很重要?

- 提高模型性能 :合适的参数可以使模型在测试数据上表现更好,提高准确率或减少误差。

- 防止过拟合和欠拟合 :通过调整超参数,可以找到一个平衡点,使模型既不过于复杂也不过于简单。

- 节省时间和资源 :一个好的参数组合可以让模型更快地收敛,减少训练时间和计算资源的消耗。

— END —

如需人工智能专题学习资料,请后台留言。

【统计学习方法】

【机器学习基础】

【深度学习导论】

【人工智能导论】

【TensorFlow2深度学习】

【Pytorch】

......