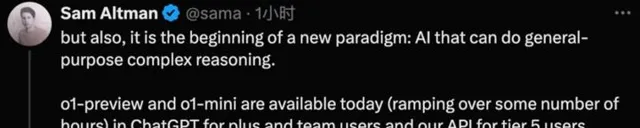

OpenAI最近发布了其最新语言模型o1,被内部昵称为「 🍓 」模型。虽然这只是一个预览版,不是最终版的强力模型,但它的新颖之处在于其独特的推理模式。它首先构建一个「思维链」(Chain of Thought,CoT),经过一系列的「思考」后,再生成最终的回答。这种前置思维链的方式大幅提升了模型在编程和数学等问题上的表现能力。

推理规模扩展定律

这种新的思维方式其实是一种推理规模的扩展表达。传统的规模扩展定律(Scaling Law)主要侧重于训练过程——即训练数据越多、计算力越强、模型参数越大,则模型的性能也就越出色。

而o1模型的推理规模扩展则打开了新的视角:在完成训练后,模型通过大量的计算和时间投入在推理过程中获得性能提升。

o1模型在生成答案前会花费大量的算力在构建思维链上,这显著提高了其解决复杂问题的能力,如奥数题等。这种「让我们一步一步思考」的方式看似简单,但在自动化这一过程面临重大挑战,因为模型需要自主探索每个问题的最优思维路径。

训练方法的变革

虽然OpenAI未具体透露使用何种训练方法,但可以推测o1模型的成功应用了强化学习,在模型的后期训练阶段,通过大量的数学题和代码库训练模型去生成解题的思维链。

通过这些优化步骤,根据结果和过程来奖励或处罚模型,进一步提升了生成思维链的能力。

思维的进化与内部见解

OpenAI 最近推出的o1模型在数学和编程领域的表现非常突出,同时在文字解密领域也展现了不俗的实力。尽管其他领域的推理能力尚在成长阶段,但 OpenAI 内部人士对此模型的未来发展充满信心。

Greg Brockman 的观点:Greg Brockman指出,根据今年国际信息学奥林匹克竞赛(IOI)的数据,o1模型在模拟常规参赛者条件下的表现位于中等水平,但当提交次数大幅增加时,它的得分远超过金牌线,显示出模型潜在的巨大能力。

Jason Wei 的评述:AIME 和 GPQA 的结果确实很好,但这不一定能转化为用户可以感受到的东西。AI 使用人类语言来建模思维链在很多方面都很棒。该模型可以做很多类似人类的事情,比如将复杂的步骤分解为更简单的步骤、识别和纠正错误以及尝试不同的方法。游戏已被彻底重新定义。

Shengjia Zhao 的期待:它不会完美,也不会适合所有事情,但它的潜力再次让人感到无限。再次感受到 AGI。

William Fedus 的比喻:ChatGPT 现在可以先仔细思考,而不是立即脱口而出答案。最好的类比是,ChatGPT 正在从仅使用系统 1 思维(快速、自动、直觉、容易出错)进化到系统 2 思维(缓慢、深思熟虑、有意识、可靠)。这让它能够解决以前无法解决的问题。从今天 ChatGPT 的用户体验来看,这是向前迈出的一小步。在简单的提示下,用户可能不会注意到太大的差异(但如果您遇到一些棘手的数学或编码问题,您会注意到的 🙂 )。但这是未来发展的重要标志。

o1模型的开发标志着AI在推理能力上的重大进步。虽然目前在某些领域的表现还不够成熟,但随着技术的不断完善,预期o1将在科学研究、工程设计、复杂数据分析等更多专业领域表现出更强的应用潜力。

怎么和 o1 聊天更合适

OpenAI 给了以下四条建议:

提示词简单直接:模型擅长理解和响应简短、清晰的指令,不需要大量的指导。

避免思维链提示词:模型会在内部执行推理,所以没有必要提示「一步一步思考」或「解释你的推理」。

使用分隔符让提示词更加清晰:用‘‘‘ ’’’、<>、§等分隔符,清晰地区分prompts的不同部分,以帮助模型分批处理问题。

限制检索增强生成中的额外上下文:仅包含最相关的信息,防止模型的响应过于复杂。

总而言之,不要写太复杂的提示词,在o1里最好的prompts是直接而简洁的,o1 已经实现了思维链的自动化,承担了提示词工程师的一部分职责,因此无需再花费过多的精力在提示词上。

随着时间的推移,o1有望在人工智能的道路上,开辟出一片新的天地。在这个由数据驱动的新世界里,o1就像一束新的光芒,照亮了人工智能的未来。

o1的出现,或许预示着这样一个"能力稀疏化"的趋势。未来的人工智能,会从单一的大模型,逐渐演化为知识、推理、创意、情感等不同能力模块的灵活组合,并与人类形成更加紧密和高效的协作。o1只是一个开始,期待百花齐放的未来。

来源:AI免费写作