北京时间2月16日,OpenAI发布文生视频模型Sora,表示其正在教授AI理解和模拟运动中的物理世界,目标是训练模型帮助人们解决需要现实世界交互的问题。

核心观点

事件:OpenAI发布文生视频模型Sora,AI视频进入大规模应用前夜

据OpenAI官网,北京时间2月16日,OpenAI发布文生视频模型Sora,表示其正在教授AI理解和模拟运动中的物理世界,目标是训练模型帮助人们解决需要现实世界交互的问题。Sora目前支持通过文字或者图片生成长达60秒的视频,此外还支持在时间上向前或向后扩展视频,以及视频编辑。我们认为:1)Sora模型在视频生成时长、语义理解程度、以及视频效果和稳定性等方面超出此前竞品,随着Sora、Pika等应用的陆续出圈,后续AI视频应用竞争或更为激烈;2)虽Sora暂未公开使用权限,但其后续潜在的商业化有望对短视频、电影、游戏等下游领域产生深远影响;3)AI视频应用在算力消耗上远超文本、音频及图像,建议关注推理端算力需求提升,以及后续其商业化程度是否能形成收入和投资的正反馈。

Sora核心功能:长达60s的文或图生视频、视频扩展、以及视频编辑

Sora目前可以通过文本或图片生成长达60s的视频,远超此前Runway(18秒)、Pika(起步3秒+增加4秒)、Stable Video Diffusion(4秒)等AI视频应用生成时长,在视频效果及稳定性等指标上表现也更加优异。Sora同时支持视频向前向后扩展、以及视频编辑。目前OpenAI官网上已经更新了48个由Sora生成的视频案例,整体色彩丰富,效果逼真。但与此同时,OpenAI表示Sora目前在视频模拟方面仍表现出许多局限性,Sora可能难以准确模拟复杂场景的物理特性,并且可能无法理解因果关系。

商业化:尚未公开使用权限,未来有望深刻影响短视频、电影、游戏等领域

商业化方面,OpenAI尚未公开Sora的使用权限,但已经在和安全测试机构、视觉艺术家、设计师和电影制作人合作,以改进产品。Sora目前所具备的文生视频时长已达到短视频主流时长标准,能够生成包含多个角色、特定类型动作以及主题和背景准确细节的复杂场景,我们认为Sora等AI文生视频产品有望在电影、短视频、游戏等领域较大改变创作者的工作方式,降低创作成本,提升生产效率。

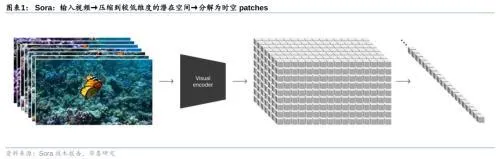

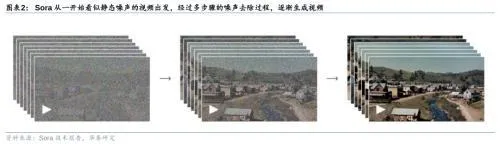

技术亮点:基于Diffusion Transformer,时空patches统一表现视觉数据

据OpenAI官网公布的Sora技术报告,Sora具有以下技术亮点:1)基于Diffusion Transformer,从一开始看似静态噪声的视频出发,经过多步骤的噪声去除过程,逐渐生成视频,Transformer架构带来优越的扩展性能;2)将不同类型的视觉数据转化为统一的表现形式(时空patches),以便于在更广泛的视觉数据上训练并出现智能涌现,这同时带来了跨越不同的持续时间、分辨率和纵横比的能力,即未来能够针对各种设备制作适配的内容,而此前的视频生成技术往往调整为例如4秒钟、分辨率256x256的标准尺寸;3)应用此前DALL·E和GPT模型的成果,采用了DALL·E 3中的 re-captioning技术以及GPT的延长提示词技术,以生成更准确的视频。

风险提示:AI 及技术落地不及预期;本研报中涉及到未上市公司或未覆盖个股内容,均系对其客观公开信息的整理,并不代表本研究团队对该公司、该股票的推荐或覆盖。

相关研报

研报:【电子: Sora:生成式AI又一重要进展】2024年2月17日

本文源自:券商研报精选