「前段時間,有人發私信說看到了我的照片,還問我‘接不接私人’。我仔細找了找,發現這個所謂的照片是AI合成的。」提起自己被「造黃謠」的經歷,博主小K(化名)仍然心有余悸。

近年來,AI技術逐漸走入更多人的生活,但也被一些動了歪心思的人看到商機。新京報貝殼財經記者調查發現,目前,黑灰產平台上存在不少售賣網紅、女星的「AI脫衣」照片群組。黑灰產從業者口中,5元可以「去衣」,20元實作「影片換臉」。這條產業鏈上,還有從業者透過吸睛照片引流,再以「會員群」服務牟利。此外,B站、小紅書等平台還有影片作者以「AI脫衣教程」等標題吸睛。

對此,北京市中聞律師事務所合夥人趙虎表示,售賣AI脫衣或者AI換臉的圖片會違反【治安管理處罰法】的規定,行為人將面臨拘留或者罰款的行政處罰,還有可能被追究刑事責任。若不售賣圖片而只是傳播,情節嚴重的,仍然將構成傳播淫穢物品罪,會被依法追究相應的刑事責任。教授技術,則涉嫌幫助犯或者教唆犯。此外,行為人實施的AI去除衣物和AI換臉的行為還涉及侵犯公民個人資訊。

「使用AI進行深度偽造與傳統的技術偽造並沒有本質區別,但效率要比傳統偽造方式高得多,技術門檻又低得多,使得普通人也能輕松實作,深度偽造的‘作品’會進一步充斥互聯網。」奇安信集團行業安全研究中心主任裴智勇對新京報貝殼財經記者表示,應當積極探索和推廣照片與影片的防偽技術。

多平台網紅遭遇「脫衣」引流:5元客製照片

經過一番簡單調查,小K最終找到了自己照片流出的源頭:有人用自己的「AI脫衣」照片在國外社交平台、色情網站引流,並兜售AI編輯圖片服務。

小K的遭遇並非個例。早在去年3月,一位小紅書博主在地鐵拍攝的照片被人為「AI脫衣」,並在微信群傳播。這位博主的評論區中,不少女性吐槽類似經歷,感同身受之外難掩心中陰影。

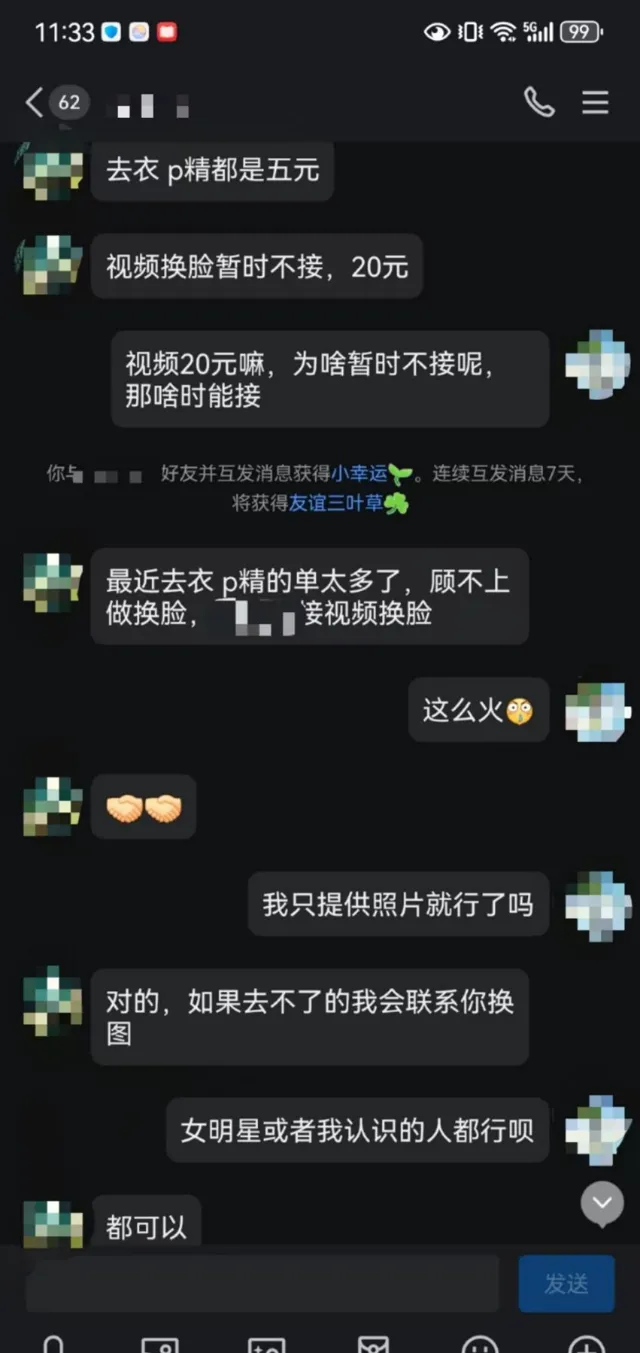

貝殼財經記者按線索搜尋發現了一個從事「AI脫衣」的賣家。對方表示,提供任意照片,再花5元就可以提供「去衣」服務,照片不能實作效果再聯系換圖。另外,20元還可以接「影片換臉」。

這位賣家稱,「最近‘去衣’的單子太多,顧不上做換臉」。

新京報貝殼財經記者與「AI脫衣」賣家的聊天記錄截圖。

「AI脫衣」技術被濫用在色情方面,最早可追溯到2020年海外釋出的一款軟件,由於存在爭議,很快被開發商下架。盡管如此,這一技術依然被某些不法分子用來斂財。

今年6月,北京警方偵破一起案件,曾在互聯網公司任職的某技術員宣稱 「電腦AI去衣,白菜價」「身邊人、網紅、明星皆可」,並以此賺起了外快,每張照片僅售1.5元。其透過網絡向351人販賣過相關圖片,數量將近7000張。最終,其被北京市海澱區檢察院以傳播淫穢物品牟利罪提起公訴。

貝殼財經記者調查發現,當前,「AI脫衣」已經形成了一條產業鏈,包括售賣經過AI深度偽造的圖片,有償對正常照片進行AI「P圖」,以及教授「技術」實作脫衣。

此外,黑灰產已經盯上女網紅、女明星等知名人物,「AI脫衣」便成了流量密碼。

貝殼財經記者在一黑灰產平台上名為「網紅XX們的去衣交流群組」看到,該群成員達到近1.5萬,其中,抖音、B站、微博、小紅書上一些知名女性網紅大多都有已被脫衣的圖片。

貝殼財經記者註意到,這一群組起初僅對一些網紅美女圖片進行「AI脫衣」,後來逐漸擴大到演藝圈和體育圈。此類「交流群」的牟利方式也比較簡單,黑灰產從業者先是在群組中投擲部份照片,以吸引成員購買「會員群」服務,會員費約為70元。

B站和小紅書仍有「AI脫衣教程」 律師:

教授技術

或

構成幫助犯

記者發現,AI生圖大模型技術成熟後,相應的「一鍵脫衣」能力就被網友從國外某知名開源AI生圖大模型中「開發」了出來,並逐漸泛濫。雖然隨著各國監管規則的完善,該大模型已經修訂了「脫衣」等指令。不過,貝殼財經記者在B站和小紅書搜尋發現,仍然存在一些「AI脫衣教程」影片,雖然有些實為AI「換衣」,但也意味著此類技術仍在被泛濫。

記者以「AI脫衣」等相關關鍵詞在某影片網站搜尋得到的結果。

對此,不少國內網紅頗為無奈。去年5月,一粉絲數量超過50萬的網紅女博主發文吐槽,「好多人都經歷過圖片被盜放到外網上,拿去引流‘賣片’,以及把照片和其他色情圖片放在一起的低階造謠手段,明眼人一看就知道是假的,我平時不在意這些,只是當私信突然變多發現‘節奏’起來時,才不得不辟謠。」

趙虎告訴貝殼財經記者,售賣AI脫衣或換臉的圖片違反【治安管理處罰法】的規定,收費幫忙「客製」AI脫衣圖片,可能構成制作、販賣淫穢物品牟利罪。若不售賣圖片而只是傳播,情節嚴重的,仍然構成傳播淫穢物品罪。而教授技術,可能構成幫助犯或者教唆犯。

「收費幫忙‘客製’AI脫衣圖片可能構成制作、復制、出版、販賣、傳播淫穢物品牟利罪。」趙虎稱,AI去除衣物和AI換臉的行為還涉及侵犯公民個人資訊。這些資訊一旦泄露或被濫用,將對個人私密和安全造成嚴重威脅。

「必須明確的是,使用AI工具進行偽造,效率要比傳統偽造方式高得多,技術門檻卻又低得多。俗話說得好,造謠一張嘴,辟謠跑斷腿。」裴智勇告訴貝殼財經記者,當前,透過專業技術手段或專家鑒定可以辨識AI深偽影片和圖片,但成本也很高,「隨著技術不斷進步,AI生成或合成的影片最終無法被鑒定真偽是必然的。」

在他看來,雖然想要阻止人們使用AI生成偽造影片或圖片不現實,但這並不意味著對偽造影片或圖片毫無辦法。「國內對於網絡色情影片和圖片都有非常成熟的治理方法,即便不能用技術鑒別一張圖片的真偽,但可以從平台一側阻止色情內容的傳播,定位色情內容的傳播源頭並實施打擊。」

裴智勇稱,互聯網平台不能片面追求流量,而是應當在相應法律的指導下,積極參與網絡治理,有效限制相關資訊的傳播範圍,對於未經證實的重大資訊,應當打上「未經證實」的標簽,以適度減少普通群眾被誤導的風險。

裴智勇認為,應當積極探索和推廣照片與影片的防偽技術,「比如使用某品牌、某型號、某序列號的特定手機拍攝照片,照片檔上就會帶有一串肉眼看不見、但機器可辨識的加密驗證碼。有人對這張照片進行修改,不論是AI修改,還是人工手動修改,驗證系統都能辨識出其不是原圖,此方法並非什麽新技術,而是成熟密碼技術。需要的只是推廣和深度普及。」

北京芯盾時代科技有限公司創始人、CTO孫悅在接受貝殼財經記者采訪時表示,深度偽造技術泛濫,聲音、人臉等生物特征失去了原有的高可信認證內容。如果想要透過技術預防其產生的危害,建議各大系統平台加強套用系統的身份認證,需進行強有力的認證措施抵禦身份偽造風險,可透過多因素身份認證、終端風險感知、大數據分析等產品技術,結合使用者行為建模、知識圖譜因果推斷等手段,有效抵禦深度偽造帶來的身份風險。

「未來,對於AI的健康發展來說,為應對深度偽造技術帶來的風險,首先,政府和行業監管單位等應積極完善相關法律法規。其次,加大研發深度偽造檢測、數碼浮水印等技術的研發投入;再者,有關部門以及新聞媒體等也應加大反詐宣傳力度,提高人民群眾的安全意識,多方努力,共同保護人民群眾人身和財產的安全。」孫悅告訴貝殼財經記者。

記者聯系郵箱:[email protected]

新京報貝殼財經記者 羅亦丹 編輯 王進雨 校對 楊利