8 月 28 日,一位 IP 定位顯示在南韓的女性,在咱們國內社交平台的發文引起高度關註。

而她順著網線跑到異國他鄉的原因,是為了 求救 。

根據她在博文中的描述,許多南韓女性正生活在 Deepfake 的陰影中,成為 AI 換臉的受害者,希望中國朋友把這事傳出去。

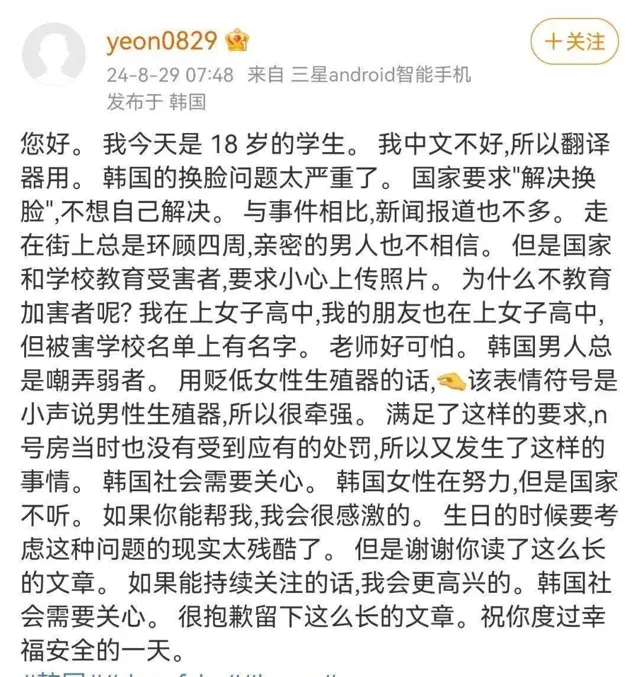

就在一天後,又有一位南韓女性前來發文,直言 「南韓的換臉問題太嚴重了」 。

甚至,她還將此事與之前的「N 號房案件」關聯到一起。

說起「N 號房案件」,想必部份家友會有印象 —— 在 2020 年,幾位南韓案犯透過社交平台建立多個秘密聊天房間,將被威脅的女性(包括未成年人)作為性奴役的物件,並在房間內共享非法拍攝的性影片和照片。

伴隨幾位南韓女性在微博發文,Deepfake 深陷輿論風波,在過去幾天裏,多個與之相關的負面話題登上熱搜。

在熱搜的發酵下,許多網友表示「N 號房」卷土重來,一場 「N 號房 2.0 事件」 浮出水面。

南韓女性究竟遇到了啥、Deepfake 到底有多可怕, 小編接下來就聊聊。

01.

N 號房 2.0

這場「N 號房 2.0」事件的開端,可以追溯到今年 5 月 ——

【韓聯社】在 5 月 21 日報道稱,首爾大學畢業生樸某和姜某,從 2021 年 7 月至 2024 年 4 月, 涉嫌利用 Deepfake 技術換臉合成色情照片和影片 ,並在 Telegram 上私密傳播,受害女性多達 61 人,包括 12 名首爾大學學生。

當時,該事件被稱為「首爾大學版 N 號房」。

也就是從那時起,南韓社會因 Deepfake 出現了恐慌情緒,人們越發開始擔心自己會被 Deepfake 的魔爪抓住。

而這份恐慌,最終在前段時間爆發了,因為有更多讓人觸目驚心的內幕被扒了出來。

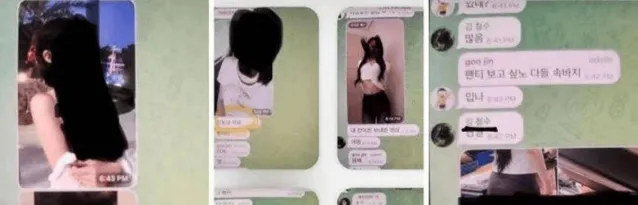

起初是一位南韓網友發帖稱發現了一個聊天室,裏面的內容令其「大開眼界」。

聊天室聚集著上千網友, 分享自己偷拍媽媽、姐姐、妹妹的暴露照片 ,群裏充斥汙言穢語。

經該網友順藤摸瓜,發現相似的聊天室比比皆是,其中一些聊天室明確規定,想要加入的條件,是上傳女性親屬的不雅照片或影片。

隨著該貼文的釋出,頓時在南韓引發軒然大波,眾多女性想起了被「N 號房」支配的恐懼。

為了探尋更多的細節,一些媒體特意安排記者到各個聊天室中臥底,結果發現了更為嚴重的情況。

部份聊天室為了更方便獲得樂子, 利用了 Deepfake 技術 ,只需把女孩的照片發進聊天室,就能得到一張合成的色情圖片。

聊天室中的成員,大多都是年輕男學生,因此慘遭他們毒手的,基本就是女同學、女老師和女生朋友。

更為過分的是,一些人拿到合成圖後,會搜尋找到受害女性真人所在的聊天室,發送合成圖並進行言語羞辱。

經記者調查發現,這樣的聊天室數量數不勝數,規模最大的一個, 擁有近 22 萬名成員。

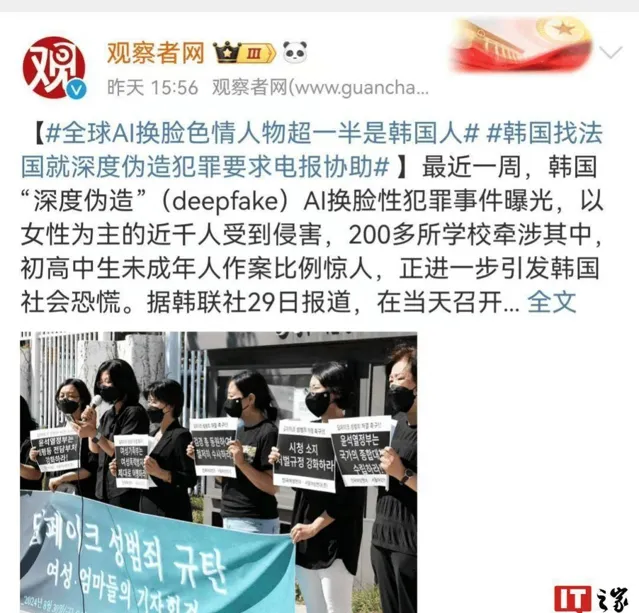

需要註意的是,據觀察者網報道,南韓【中央日報】援引美國安全服務機構「Security Hero」最新公開的【2023 深度偽造技術現狀】報告報道稱, 南韓被評為最容易受到深度偽造技術性剝削的國家 。

據報道,去年 7 月至 8 月,對前 10 名 Deepfake 色情網站和 85 個 Deepfake 頻道進行分析的結果顯示,在 Deepfake 技術性剝削物中出現的人物中,53% 是南韓人,排名第一。

02.

深受其害者不計其數

實際上,南韓女性並非是 Deepfake 唯一受害群體,深受其害者大有人在,最早可以追溯到 2017 年。

當時,有網友在 Reddit 論壇上利用 AI 換臉軟件, 將【神奇女俠】的主角蓋兒加朵的臉移花接木到成人電影主角身上 。

後續,有人將公開的的演算法加以改造推出相關 App,大大降低了使用 AI 換臉的門檻。

由於使用方法非常簡單, 許多網友便將女明星的臉換到色情片中 ,給諸多女星造成了極大困擾。

雖說,後來各個平台為了遏止「換臉色情電影」的歪風,紛紛禁止相關內容出現,但潘朵拉之盒已然開啟,想關上就沒那麽容易。

比如在今年年初,X、Facebook 等社交平台上出現了大量泰勒斯威夫特的 Deepfake「不雅照」,鬧得滿城風雨。

在女明星受害的同時,還出現了黑產業鏈,中新經緯曾報道過,售賣明星換臉的不雅影片等已經成為一門生意。

一些平台的賣家,不僅宣稱手裏有已經制作完畢的明星 AI 換臉影片可以出售,還表示可以提供影片客製換臉產品。

甚至還有賣家宣稱可以 傳授 AI 換臉技術 ,據悉費用不算高。

由於操作簡單, Deepfake 可以做到害人於無形 ,僅需一張自拍照或帶有肖像的照片,就會被合成到不雅圖片或影片中。

而在制造出不雅照後,難免會有人動歪歪心思。

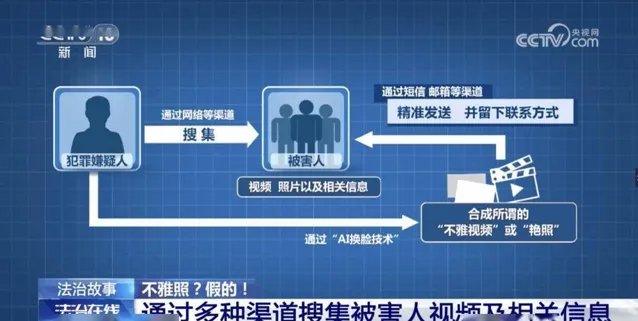

在今年 6 月,【法治線上】曾介紹了兩起「AI 換臉偽造不雅照」案, 相關詐騙團伙主要利用被害者影片照片資訊制作「艷照」進行敲詐。

一起是深圳市民吳先生收到一張包含自己與一名不認識女子的「艷照」彩信,犯罪嫌疑人在彩信中威脅當事人需在指定時間前將錢財轉到指定賬號「破財消災」。

另一起是威海王先生接收到一張包含自己面孔的「裸照」彩信,附帶有「我有你的全部影像資料」等文字內容。

不僅傷害了無辜女性,還妄想敲清白男性一筆...... 可真「刑」啊!

03.

有人騙人,有人暖人

當然了,Deepfake 的危害不僅僅體現了色情方面,運用於詐騙中亦能做到防不勝防。

平安包頭報道過一起詐騙事件,詐騙犯利用 AI 換臉技術,冒充受害者的好友透過微信影片借錢, 僅用 10 分鐘騙走了 430 萬元。

從現實情況來看,Deepfake 可謂是作惡多端,與其相關的新聞,都帶有惡劣色彩。

畢竟 Deepfake 這個詞的意思是 「深度偽造」 ,生成的又都是虛假內容,本身看上去就帶有貶義因素。

只是作為其最常見的方式 AI 換臉,其實是有積極用途的。

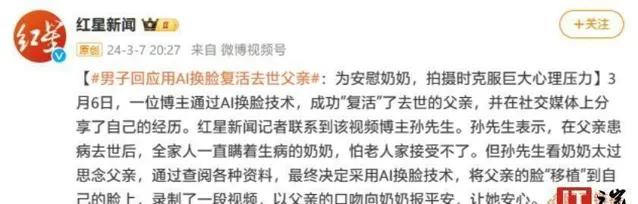

先前,一名男子的父親因罹患闌尾黏液腺癌病去世,全家人一直瞞著生病的奶奶,怕老人家接受不了。

但該男子看奶奶太過思念,便查閱各種資料, 最終決定采用 AI 換臉技術將父親的臉「移植」到自己的臉上 ,錄制了一段影片,以父親的口吻向奶奶報平安,讓她安心。

此情此景,正如家友評價那般: 有的人用 AI 以假亂真去騙人,有的人用 AI 以假亂真溫暖人。

04.

科技是一把雙刃劍

自 AI 的浪潮興起後,由於展現出的功能性過於強大,再加上叠代速度日新月異,圍繞在其身上的爭議就沒斷過。

它在讓許多人獲益的同時,也讓不少人受到傷害, 輕則違背道德,重則違反法律。

作為一種技術,AI 可能本無對錯,之所以會出現錯誤,本質還是出在人身上,畢竟技術本中立,但其方向由人控制。

科技是一把雙刃劍,用於正道,會傳遞正能量;用於邪道,則會惹是生非。

技術沒有上限,同樣,人心也沒有下限, 一旦一項技術能用在不好的地方,那或許就會被用在不好的地方。

對了,別忘了今天還有 【華為余承東回應「享界 S9 飛坡測試」】 等文章,以及:

3天賣了1000多萬份近30億元,【黑神話:悟空】正帶飛國產顯卡 那顆由索尼相機壟斷的「工業皇冠明珠」,被咱摘了下來 手握13億文件,豆丁網100萬元被「賤賣」

N號房卷土重來↓↓↓