白交 衡宇 發自 凹非寺

量子位 | 公眾號 QbitAI

好訊息,好訊息,真·Sora影片上新了!走過路過不要錯過!

(不用苦苦等候,或撐大眼睛費勁吧啦鑒別真假Sora產品了) 。

就在過去短短幾個小時裏,包括Bill Peebles、Tim Brooks兩位負責人在內的工作人員唰唰唰N連發。

(好了好了,知道你們是好朋友)

不僅有前所未的多視角、新功能展現,最重要的是,各個影片的呈現效果依然處於令人驚嘆的段位。

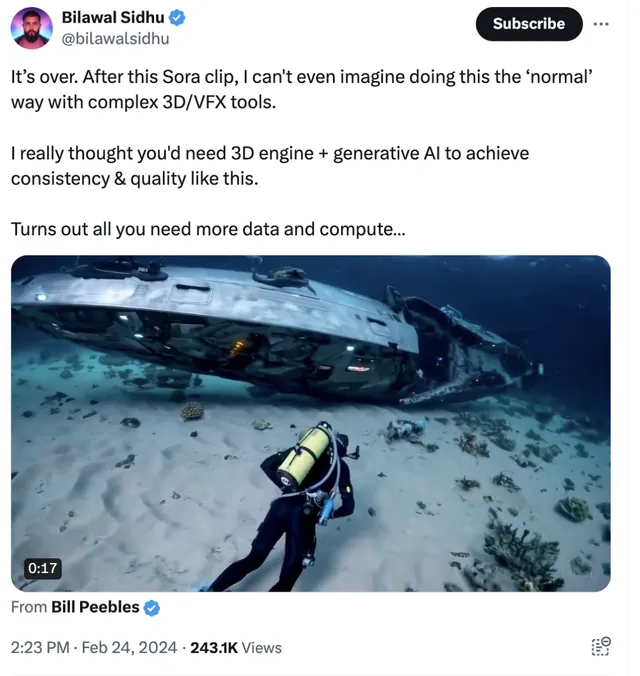

比如Go Pro視角下潛水去探索沈船。

比如下面這段影片,效果跟此前寫實、逼真的畫風有點不一樣,而且Sora產出的是同一片段的不同視角畫面。

它的提示詞是:精心制作的立體模型,描繪了日本江戶時代的寧靜場景。傳統的木結構建築。一個孤獨的武士,穿著復雜的盔甲,緩慢地穿過城鎮。

另外比較驚艷的還有一頭大眼睛、長睫毛、口噴冷氣的小白龍,就是下面這位:

有人嘗試用同樣的prompt在DALLE·3上畫畫,得到的結果是這樣的:

就,還挺神似!

但Sora小白龍的效果讓某種聲音越來越大,那就是:

好家夥,我一眼就看出這玩意兒有虛幻引擎的影子!

不過,這波影片還是惹得網友們wow wow的,不停驚嘆,怎麽Sora每波影片效果都越來越好了?

我的天爺啊,等Sora公測開放等得大家一天只能吃下三頓飯了!

有的網友超級激動,已經在知名新產品挖掘平台ProductHunt上給Sora的API站好了坑。

萬事俱備,只欠東風。

官方新影片再流出

首先來看看Sora這波上新,此次最驚艷的是由玻璃制成的烏龜,日落時分在沙灘上爬行。

不過也有細心的網友發現:「我只看到了三條腿…」「前面兩條腿更像烏龜的腳蹼」

而在Midjourney上使用相同的提示,效果是這樣的。

另外,多個視角展現也成為了此次上新的亮點。

比如在夏威夷玩跳傘。

提示詞:a man BASE jumping over tropical hawaii waters. His pet macaw flies alongside him(一名男子在夏威夷熱帶海域進行低空跳傘,他的寵物金剛鸚鵡與他並肩飛翔)

甚至還有F1賽車手的視角。

此外,Sora還暴露了一些類似剪輯的新功能—— 無縫銜接 。

此前看到,它能透過文本、影像或影片輸入對模型進行提示。

如今發現,它還可以在兩個輸入影片之間逐漸進行插值。兩個毫不相幹的Sora影片,結果無縫過渡成了新影片。

咳咳,不過水下為啥會有蝴蝶??

不過由於悉數都是Sora團隊成員釋出的影片,有網友覺得,除非有個非OpenAI工作人員才測試,不然Sora就是個vaporware(霧件)

這些案例中,也有被認為翻車的……

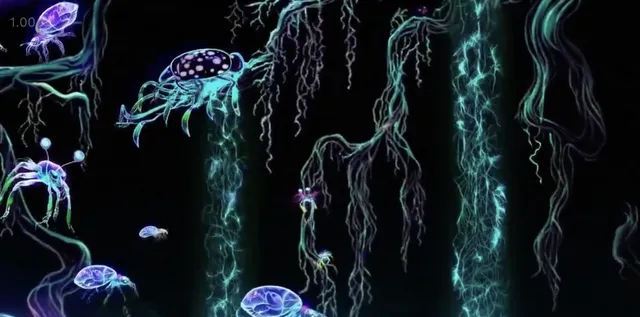

提示詞:a dark neon rainforest aglow with fantastical fauna and animals(黑暗的霓虹雨林,閃爍著奇幻的動物和動物的光芒)

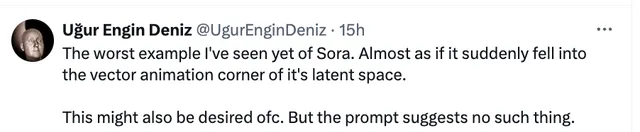

網友表示:為什麽會是向量動畫的風格,提示中根本並沒有這樣的提示。

這是我見過Sora最糟糕的例子

「我不是專家,但這絕對用了UE5」

與此同時,關於Sora所生成影片的討論重心,逐漸從「這不符合物理世界的規律」,轉移到更深層次——

關於其背後 訓練數據來源 的討論。

現在的民間主流說法(doge) 是:

這絕對用了3D引擎/UE5來訓練的!

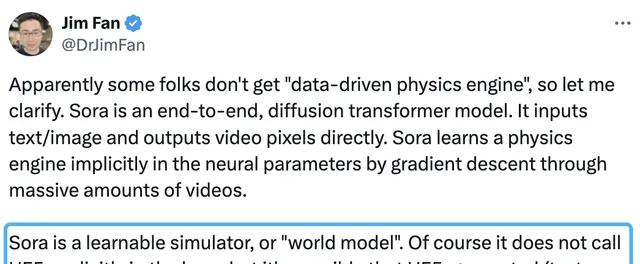

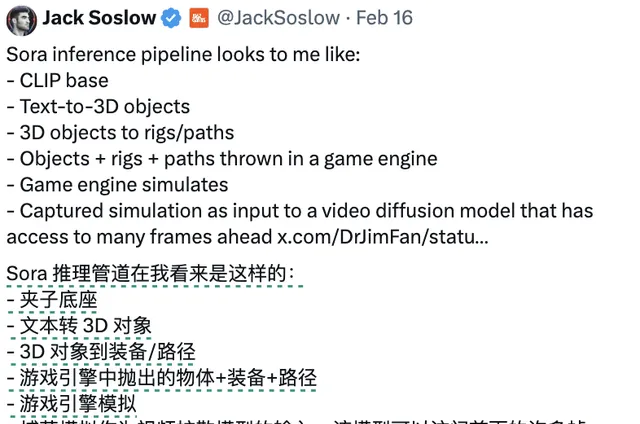

輝達科學家、大家夥熟悉的老盆友Jim Fan老師就在首日猜測過,稱Sora雖然沒有明確表示呼叫了UE5,但極有可能把用UE5生成的文本、影片當作合成數據,添加到自個兒的訓練集中。

也有一位前谷歌工作人員對Sora這次的新影片進行了線上銳評:

Sora這效果,我真的認為需要3D引擎+生成式AI結合,才能實作這樣的一致性和影片質素。

事實證明,就是得要更多的數據和計算……

倒不是Jim Fan等人的一家之言。早在第一波Sora影片亮相時,這種聲音就第一時間起來了,聲量還很不小。

再多舉個例子。

一位從事數據科學和ML的推友羅列出了自己站隊這種觀點的「證據」。

他亮出的牌是漫步櫻花街頭的那段影片。

然後配文道:「影片中移動的人似乎與UE5演示中的人類的移動方式非常相似。現實中的人走路逛街,並不會老用一個恒定的速度。」

也有人質疑這種說法,畢竟Youtube等互聯網上擁有數十億(可能還不止) 小時的影片片段,幹啥要用虛幻引擎來增加工作量呢?

於是就有人把「汽車行駛」的影片片段丟到上面這位推友小哥面前,說這看起來也不像是用了3D引擎搞的呀!

小哥友好地嘚吧嘚嘚吧嘚,開始了自己的分析:

「我不是專家……但感覺UE讓汽車行駛掀起的塵土,只在後輪部份有。但其實作實情況中,前輪部份也會揚起塵沙。」

當然也有不少人贊同他,附和道:

雖然不一定用的是UE5吧……但事實確實是,用數碼孿生模擬可能效果和效率都更好。

而且這樣還能用較少的IRL數據進行更高質素的數據采樣。

以及還有人把自己理解中Sora的pipeline都列到推特上了。

這種討論大規模流傳開後,不少人對Sora可能是「UE5+AIGC」產生的效果嗤之以鼻。

「哼!我話放在這兒,合成數據是視覺機器學習的作弊程式碼!!」

同時有人從這種討論中看到了不久之後的一種可能性。

即未來的生成不是透過模擬真實物理來呈現,而是透過訓練模擬物理模擬(即現實世界) 的模型來呈現。

嗯……咱就是說,誰能一口否定沒有這種可能呢?

One More Thing

Sora上新影片後,有網友急沖沖去問了另一家AI影片生成頭部玩家Runway的行政總裁。

「最近幾個月,有釋出新版本的打算嗎?就是質素接近Sora的那種~」

Runway CEO冷冷回了一個詞兒:

better

參考連結:

[1]https://twitter.com/minchoi/status/1761367515777695965

— 完 —

量子位 QbitAI · 頭條號簽

關註我們,第一時間獲知前沿科技動態約