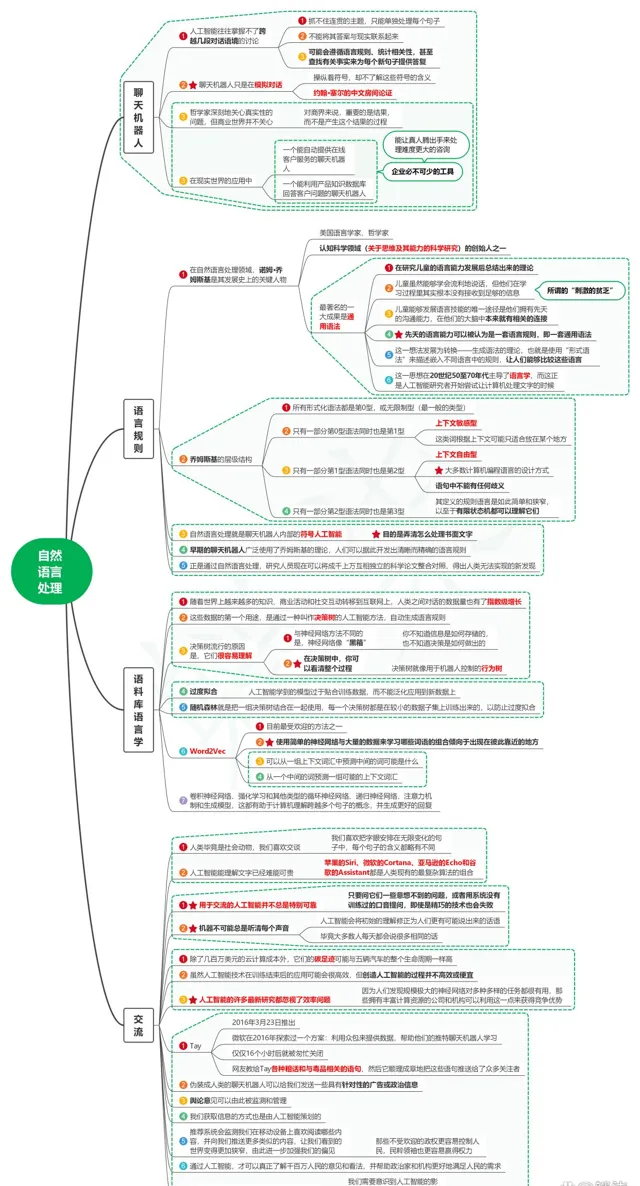

1. 聊天機器人

1.1. 人工智能往往掌握不了跨越幾段對話語境的討論

1.1.1. 抓不住連貫的主題,只能單獨處理每個句子

1.1.2. 不能將其答案與現實聯系起來

1.1.3. 可能會遵循語言規則、統計相關性,甚至尋找有關事實來為每個新句子提供答復

1.2. 聊天機器人只是在模擬對話

1.2.1. 操縱著符號,卻不了解這些符號的含義

1.2.2. 約翰·塞爾的中文房間論證

1.3. 哲學家深刻地關心真實性的問題,但商業世界並不關心

1.3.1. 對商界來說,重要的是結果,而不是產生這個結果的過程

1.4. 在現實世界的套用中

1.4.1. 一個能自動提供線上客戶服務的聊天機器人

1.4.2. 一個能利用產品知識數據庫回答客戶問題的聊天機器人

1.4.3. 企業必不可少的工具

1.4.3.1. 能讓真人騰出手來處理難度更大的咨詢

2. 語言規則

2.1. 在自然語言處理領域,諾姆·喬姆斯基是其發展史上的關鍵人物

2.1.1. 美國語言學家、哲學家

2.1.2. 認知科學領域(關於思維及其能力的科學研究)的創始人之一

2.1.3. 最著名的一大成果是通用語法

2.1.3.1. 在研究兒童的語言能力發展後總結出來的理論

2.1.3.2. 兒童雖然能夠學會流利地說話,但他們在學習過程裏其實根本沒有接收到足夠的資訊

2.1.3.2.1. 所謂的「刺激的貧乏」

2.1.3.3. 兒童能夠發展語言技能的唯一途徑是他們擁有先天的溝通能力,在他們的大腦中本來就有相關的連線

2.1.3.4. 先天的語言能力可以被認為是一套語言規則,即一套通用語法

2.1.3.5. 這一想法發展為轉換——生成語法的理論,也就是使用「形式語法」來描述嵌入不同語言中的規則,讓人們能夠比較這些語言

2.1.3.6. 這一思想在20世紀50至70年代主導了語言學,而這正是人工智能研究者開始嘗試讓電腦處理文字的時候

2.2. 喬姆斯基的層級結構

2.2.1. 所有形式化語法都是第0型,或無限制型(最一般的類別)

2.2.2. 只有一部份第0型語法同時也是第1型

2.2.2.1. 上下文敏感型

2.2.2.2. 這類詞根據上下文可能只適合放在某個地方

2.2.3. 只有一部份第1型語法同時也是第2型

2.2.3.1. 上下文自由型

2.2.3.2. 大多數電腦程式語言的設計方式

2.2.3.3. 語句中不能有任何歧義

2.2.4. 只有一部份第2型語法同時也是第3型

2.2.4.1. 其定義的規則語言是如此簡單和狹窄,以至於有限狀態機都可以理解它們

2.3. 自然語言處理就是聊天機器人內部的符號人工智能

2.3.1. 目的是弄清怎麽處理書面文字

2.4. 早期的聊天機器人廣泛使用了喬姆斯基的理論,人們可以據此開發出清晰而精確的語言規則

2.5. 正是透過自然語言處理,研究人員現在可以將成千上萬互相獨立的科學論文整合對照,得出人類無法實作的新發現

3. 語料庫語言學

3.1. 隨著世界上越來越多的知識、商業活動和社互動動轉移到互聯網上,人類之間對話的數據量也有了指數級增長

3.2. 這些數據的第一個用途,是透過一種叫作決策樹的人工智能方法,自動生成語言規則

3.3. 決策樹流行的原因是,它們很容易理解

3.3.1. 與神經網絡方法不同的是,神經網絡像「黑箱」

3.3.1.1. 你不知道資訊是如何儲存的,也不知道決策是如何做出的

3.3.2. 在決策樹中,你可以看清整個過程

3.3.2.1. 決策樹就像用於機器人控制的行為樹

3.4. 過度擬合

3.4.1. 人工智能學到的模型過於貼合訓練數據,而不能泛化套用到新數據上

3.5. 隨機森林就是把一組決策樹結合在一起使用,每一個決策樹都是在較小的數據子集上訓練出來的,以防止過度擬合

3.6. Word2Vec

3.6.1. 目前最受歡迎的方法之一

3.6.2. 使用簡單的神經網絡與大量的數據來學習哪些詞語的組合傾向於出現在彼此靠近的地方

3.6.3. 可以從一組上下文詞匯中預測中間的詞可能是什麽

3.6.4. 從一個中間的詞預測一組可能的上下文詞匯

3.7. 摺積神經網絡、強化學習和其他類別的迴圈神經網絡、遞迴神經網絡、註意力機制和生成模型,這都有助於電腦理解跨越多個句子的概念,並生成更好的回復

4. 交流

4.1. 人類畢竟是社會動物,我們喜歡交談

4.1.1. 我們喜歡把字眼安排在無限變化的句子中,每個句子的含義都略有不同

4.2. 人工智能能理解文字已經難能可貴

4.2.1. 蘋果的Siri、微軟的Cortana、亞馬遜的Echo和谷歌的Assistant都是人類現有的最復雜演算法的組合

4.3. 用於交流的人工智能並不總是特別可靠

4.3.1. 只要問它們一些意想不到的問題,或者用系統沒有訓練過的口音提問,即使是精巧的技術也會失敗

4.4. 機器不可能總是聽清每個聲音

4.4.1. 人工智能會將初始的理解修正為人們更有可能說出來的話語

4.4.2. 畢竟大多數人每天都會說很多相同的話

4.5. 除了幾百萬美元的雲端運算成本外,它們的碳足跡可能與五輛汽車的整個生命周期一樣高

4.6. 雖然人工智能技術在訓練結束後的套用可能會很高效,但創造人工智能的過程並不高效或便宜

4.7. 人工智能的許多最新研究都忽視了效率問題

4.7.1. 因為人們發現規模極大的神經網絡對多種多樣的任務都很有用,那些擁有豐富計算資源的公司和機構可以利用這一點來獲得有利競爭

4.8. Tay

4.8.1. 2016年3月23日推出

4.8.2. 微軟在2016年探索過一個方案:利用眾包來提供數據,幫助他們的推特聊天機器人學習

4.8.3. 僅僅16個小時後就被匆忙關閉

4.8.4. 網友教給Tay各種粗話和與毒品相關的語句,然後它順理成章地把這些語句推播給了眾多關註者

4.9. 偽裝成人類的聊天機器人可以給我們發送一些具有針對性的廣告或政治資訊

4.10. 輿論意見可以由此被監測和管理

4.11. 我們獲取資訊的方式也是由人工智能策劃的

4.12. 推薦系統會監測我們在流動通訊器材上喜歡閱讀哪些內容,並向我們推播更多類似的內容,讓我們看到的世界變得更加狹窄,由此進一步加強我們的偏見

4.12.1. 那些不受歡迎的政權更容易控制人民,民粹領袖也更容易贏得權力

4.13. 透過人工智能,才可以真正了解千百萬人民的意見和看法,並幫助政治家和機構更好地滿足人民的需求

4.14. 所有的新技術都可能被用於為善或作惡

4.14.1. 我們需要意識到人工智能的影響,並確保它得到恰當的套用