在這個人工智能飛速發展的時代,你是否曾經好奇過,電腦是如何學會轉譯語言、辨識影像,甚至進行合理對話的呢?

2024年的諾貝爾物理學獎,就頒給了兩位為機器學習奠定基礎的科學家:約翰·霍普菲爾德(John J. Hopfield)和謝菲·辛頓(Geoffrey E. Hinton)

。他們運用物理學的工具,構建了能夠儲存和重構資訊、自主發現數據特征的方法,

為今天強大的人工神經網絡鋪平了道路

。

圖源:Johan Jarnestad/瑞典皇家科學院

從大腦到機器:模仿自然的智慧

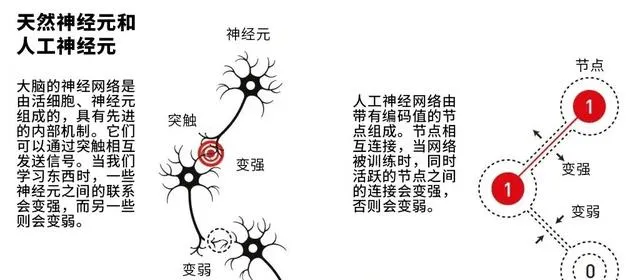

人工神經網絡的靈感來源於我們的大腦。 就像大腦由數十億個神經元透過突觸相連一樣,人工神經網絡由大量的「節點」透過「連線」組成。每個節點就像一個神經元,可以儲存一個值;而連線的強弱則類似於突觸的強度,決定了資訊傳遞的效果。

圖源:Johan Jarnestad/瑞典皇家科學院

霍普菲爾德的聯想記憶:

在「能量景觀」中儲存資訊

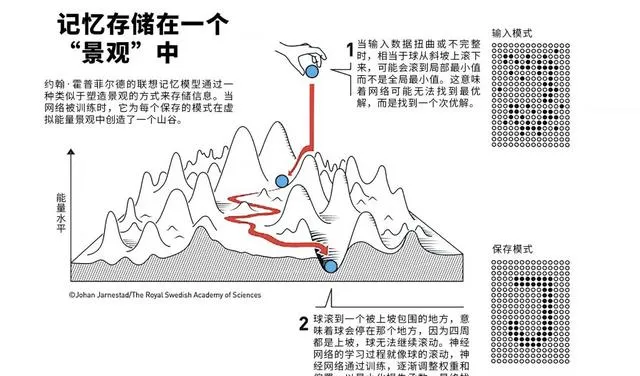

1982年,物理學家約翰·霍普菲爾德提出了一種革命性的網絡結構,被稱為「 霍普菲爾德網絡 」。這個網絡能夠儲存多個模式(比如影像),並且在給定不完整或有雜訊的輸入時,能夠重構出最相似的儲存模式。

霍普菲爾德的靈感來自物理學中描述磁性材料的理論。他將網絡的狀態比作一個「能量景觀」,每個儲存的模式就像景觀中的一個山谷。當網絡接收到新的輸入時,就像在這個景觀中捲動一個球,最終會停在最接近的山谷中,也就是找到了最相似的儲存模式。

這種方法 非常適合處理有雜訊或部份缺失的數據 ,比如恢復受損的影像或辨識手寫字元。

圖源:Johan Jarnestad/瑞典皇家科學院

辛頓的波茲曼機:

自主學習的突破

霍普菲爾德的網絡主要用於儲存和檢索資訊,謝菲·辛頓則更進一步,希望機器能像人類一樣自主學習和分類資訊。1985年,辛頓和同事提出了「 波茲曼機 」,這個名字源於19世紀物理學家路德維希·波茲曼的方程式。

波茲曼機通常由兩層節點組成:可見層用於輸入和輸出資訊,隱藏層則影響整個網絡的功能。這種結構允許網絡 不僅能辨識已知模式,還能生成新的、相似的模式 。比如,它可以在看過多張貓的圖片後,生成一張新的、看起來像貓的影像。

更重要的是, 波茲曼機能夠透過例子學習 ,而不需要明確的指令。給它看足夠多的貓和狗的圖片,它就能學會區分這兩類動物,甚至辨識它從未見過的新圖片。

圖源:Johan Jarnestad/瑞典皇家科學院

從理論到實踐:機器學習的革命

霍普菲爾德和辛頓的工作為機器學習奠定了理論基礎,但真正的革命是在2010年左右開始的。得益於海量數據的可用性和計算能力的巨大提升,今天的人工神經網絡已經發展成為擁有數十億甚至上萬億參數的「 深度神經網絡 」。

這些網絡 被廣泛套用於各個領域 ,從語言轉譯到影像辨識,從推薦系統到科學研究。例如,它們幫助物理學家在海量數據中尋找希格斯粒子,協助天文學家發現系外行星,甚至在預測蛋白質結構和設計新材料方面發揮重要作用。

展望未來:機遇與挑戰並存

機器學習的迅速發展不僅帶來了巨大的機遇,也引發了廣泛的討論,特別是在倫理和安全方面。如何確保AI技術的公平性和透明度?如何防止它被濫用?這些都是我們需要認真思考的問題。

2024年的諾貝爾物理學獎不僅是對霍普菲爾德和辛頓個人成就的肯定,更是對跨學科研究重要性的強調。他們的工作展示了,當物理學的深刻洞見與電腦科學的創新相結合時,能夠產生多麽令人驚嘆的成果。

資訊來源:諾貝爾官網新聞稿

編譯:果殼轉譯班

快來關註,不要錯過!

本文來自果殼,未經授權不得轉載.

如有需要請聯系[email protected]