OpenAI GPT-4o深夜炸场!

当地时间5月13日10点(北京时间5月13日22:00),OpenAI首席技术官Mira Murati举行召开了OpenAI春季发布会,正式推出了新一代旗舰AI模型:GPT-4o。

话不多说,直接看GPT-4o的最新进展: 能实时进行多模态对话。

单看这这个描述,似乎没什么震撼力。如果用更形象的语言来概括,就是你可以在GPT上玩转文字、图片、视频和语音,并且随时唤起、随时打断。

这意味着,GPT-4o的响应速度和表达能力达到了人类水平, 能够像一个「真正的人」和你对话 。

Sam Altman在X平台略带神秘地发了一个:「her」,暗指GPT-4o的拟人能力。

(注:经典电影【Her】中,男主角爱上了一个像人类一样「有血有肉」的AI。)

(注:经典电影【Her】中,男主角爱上了一个像人类一样「有血有肉」的AI。)

Murati表示,相比GPT-4 Turbo, GPT-4o的速度要快2倍,不仅开放API,而且速率限制(即用户可发出的请求数量)提至此前的5倍。

最令人振奋的是: 免费开放。

Murati表示, GPT-4o将面向ChatGPT的所有付费和免费用户发布 ,取消其他所有限制,API价格降价50%。

发布会时长不长,除了主要介绍了GPT-4o之外,Murati还公布了桌面版ChatGPT以及新的用户界面(UI)。

据悉,GPT-4o即日起将开始向API和用户推出,语音和视频理解能力等更多功能将在后续迭代部署。

解方程、做口译、读代码、懂情感……

解方程、做口译、读代码、懂情感……

GPT-4o中的「o」代表「omni」,意为全能 。

Murati称,GPT-4o为每个用户都提供了GPT-4级别的智能,同时还改进了GPT-4在 文本、视觉以及音频方面 的能力。

借助GPT-4o,OpenAI通过跨文本、视觉和音频端到端训练了新模型,使得所有输入和输出都由同一神经网络处理,进一步降低了延迟。

据介绍,GPT-4o的语音延迟大幅改善,可以在232毫秒内回应音频输入,平均为320毫秒,接近人类对话的反应时间。

在基本的功能介绍后,Murati邀请研究主管 Mark Chen、后训练团队负责人Barret Zoph同台进行功能演示。

比起前面的口头介绍,GPT-4o的直播表现可谓充满惊喜。

1)看图指导解方程

演示中,Zoph在白板上写了一个方程式3x+1=4,ChatGPT给他提示,引导他完成每一步解答,识别他的书写结果,帮助他解出了X的值。

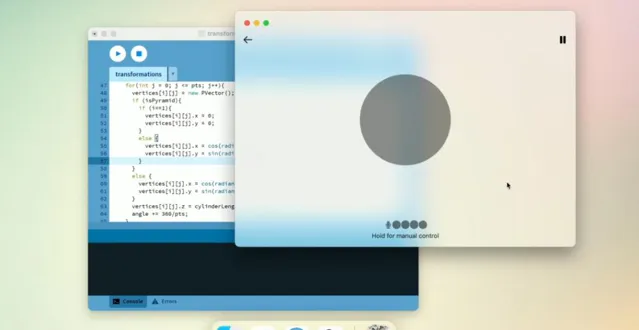

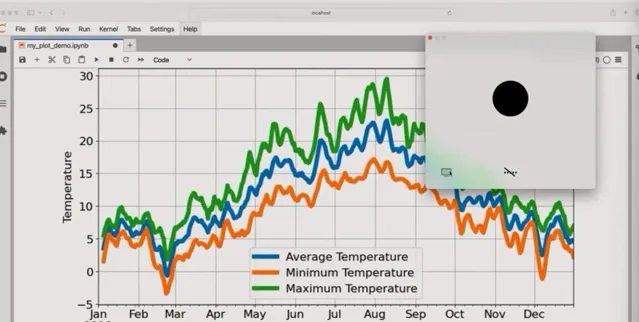

2)解读屏幕信息

Zoph将一段Python代码输入ChatGPT,并让ChatGPT用一句话总结这段代码在做什么。GPT回答无误,并详细说明了数据是如何被处理的。

随后,Zoph又运行了这段代码,GPT能够准确地描述出所生成图表的具体含义,包括图表主题、XY轴信息、峰值水平。

3)实时交替翻译

GPT还在演示中扮演了翻译员的角色。应社交媒体X的用户请求,Murati现场对ChatGPT说起了意大利语,GPT则将她的话翻译成英语,转告Zoph和Chen;听完Murati说的意大利语,GPT再将其翻译为英文并告诉Chen:「Mark,她(Murati)想知道鲸鱼会不会说话,它们会告诉我们什么?」

4)通过视频识别面部情绪

演示中,Zoph将手机举到自己面前正对着脸,要求ChatGPT检测他现在的情绪。最初,GPT参考了他之前分享的一张照片,将他识别为「木质表面」。经过第二次尝试,GPT表示:「你看起来非常的开心,可能还有一点激动,看样子你应该心情很不错。」

Zoph赞扬了GPT的回答并表示自己正在进行一场演示,以展示「你有多不可思议」,此时GPT情绪颇为激动地表示:「快别说了!你让我害羞了。」

在后续的网络实测视频中,官方和用户还探索出了GPT-4o的花样玩法。

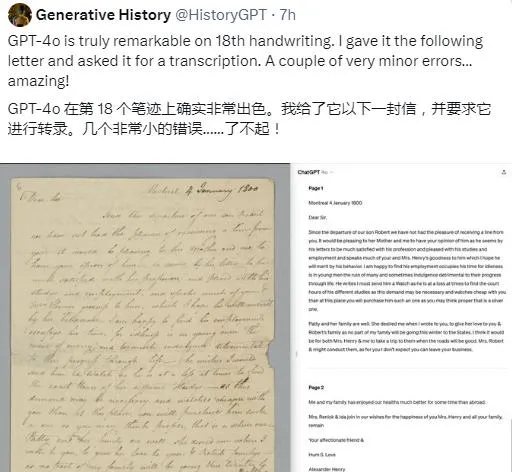

比如,将老照片中的手写字转录为电子文本:

共享iPad屏幕后,让GPT实时指导教学几何题目:

和GPT视频玩 「石头剪刀布」:

正如Murati说,GPT-4o的发布意味着OpenAI在大模型的易用性方面迈出了一大步, Ta正在改变人机交互的协作模式。

AI手机还会远吗?

AI手机还会远吗?

可以说,GPT-4o确实要比GPT-4 Turbo多了很多「小心思」,似乎正在挑战Siri的地位。

不过,性能似乎要比Siri强的多。有网友调侃道:

「Siri现在的心情如下……」

实际上,就在此前, 有媒体报道透露 ,苹果已经与OpenAI达成协议,将在全新操作系统iOS 18中引入ChatGPT技术,以升级Siri的对话体验。

这不由令人猜想,GPT-4o和Siri将如何结合?OpenAI和苹果会缔造出具有跨时代意义的AI手机吗?

英伟达高级研究科学家Jim Fan在X平台表示,iOS集成GPT技术可能会有三个层级:

1)放弃Siri。OpenAI为iOS提炼出更小型、纯设备上的GPT-4o,并可选择付费升级以使用云。

2)将相机或屏幕传输到模型中的基础功能。对神经音频/视频编解码器的芯片级支持。

3)集成iOS系统操作API和智能家居API。Siri快捷方式是时候复活了。

有分析指出,苹果和OpenAI的合作能够解决彼此在发展边缘AI方面的痛点,真正做到各取所需——

OpenAI最需要什么? 端侧应用权限、系统级权限,只有苹果能提供。

苹果最需要什么? 最好的AI技术,最适配的大语言模型,GPT-4o无疑是最佳人选。

Fan也表示,苹果+OpenAI合作推出的AI产品可能会成为 从一开始就拥有10亿用户的AI产品。

目前,有分析师预测,苹果将在6月10日的WWDC大会上官宣和OpenAI的合作伙伴关系,并推出基于苹果LLM的AI聊天机器人。

令人激动的是, 已经有移动端App开始接入GPT-4o了。

用于辅助盲人和弱势群体日常生活的手机App Be My Eyes尝试了接入GPT-4o,发现日常决策的效率被大大提高。

宣传视频显示,一名盲人打开Be My Eyes后,能够通过和GPT-4o对话, 让GPT详细告诉他眼前的景象,从而快速做出决策。

网友纷纷评论: 太不可思议了!

有网友表示,这是GPT-4o的最佳用例,它将为视障人士创造一个全新的世界。

真「成精」了?【Her】来了

真「成精」了?【Her】来了

在所有演示结束后,Murati总结道:「正如大家所见,(如今的ChatGPT)真的很神奇。」

结合GPT-4o的表现及其情感感知/表达的能力,不少网友表示: 这不就是现实版的Her吗!

还有网友据此做了一张梗图「Him」,主角换成了Altman。

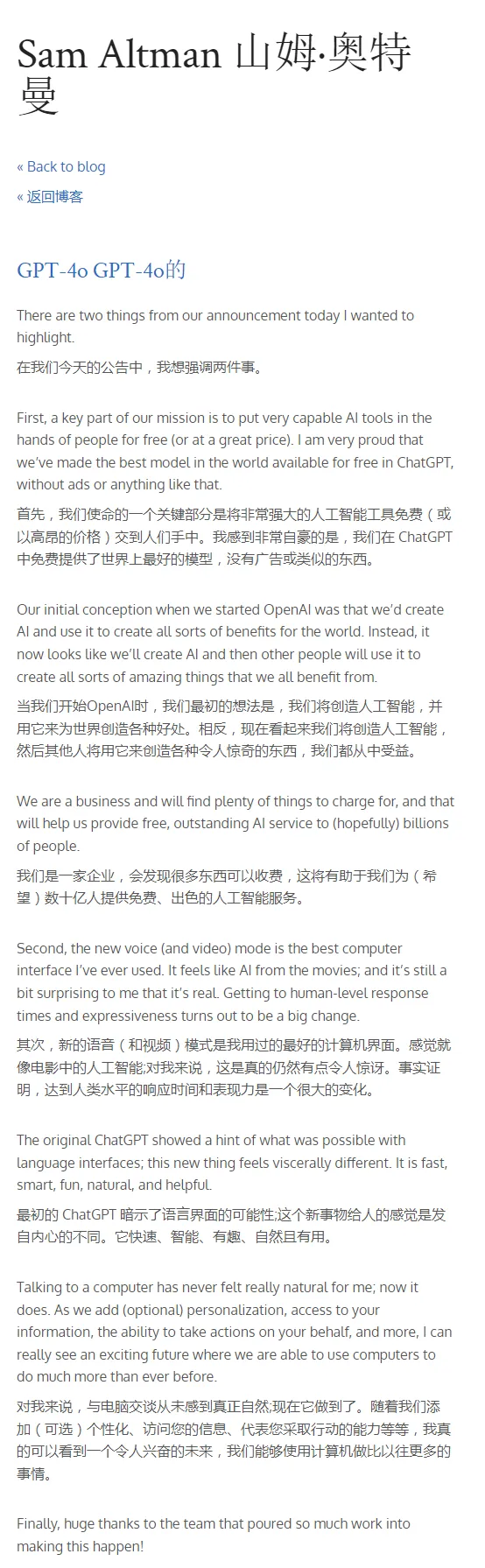

发布会后,Altman在X平台发布长文,称「 看到一个令人兴奋的未来 」。

「我感到非常自豪的是,我们在ChatGPT中免费提供了世界上最好的模型,没有广告。」

「最初的ChatGPT带来了语言界面的可能性。这个新事物(GPT)给人的感觉有本质的不同。 它速度快、智能、有趣、自然,而且对人们更有帮助。 」

「对我来说,与电脑交谈从来都不是很自然的事情。现在它做到了。随着我们添加(可选)个性化、访问您的信息、代表您采取行动的能力等等, 我真的可以看到一个令人兴奋的未来,我们将用电脑做更多事。 」

AI创业顾问Allie K. Miller更是兴奋地表示:

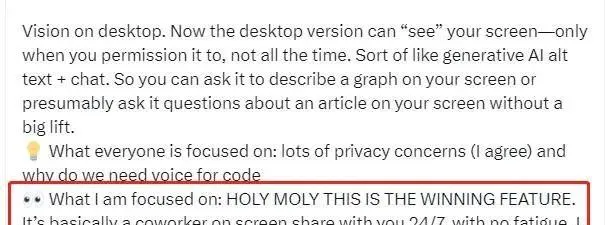

哇塞,这真是太棒了!这基本上就是一个24/7与你进行屏幕共享的同事,它完全不会疲倦。我可以想象人们使用这个工具连续工作数小时。

AI开发者Benjamin De Kraker甚至直接夸赞道: AGI(通用人工智能)基本已经实现。

「对于大多数人来说,这将被当做是魔法。当一个虚拟的「人」几乎可以和普通人一样听、说、看和推理,你还能用什么来形容呢?这不就是AGI吗?」