智东西

作者 | 三北

编辑 | 漠影

「AI+」时代,大模型正如雨后春笋般涌现,以重构千行百业之势向通用人工智能(AGI)全速冲锋。

「每隔一天在中国就有一个AI大模型出现,我们开玩笑说‘实现了大模型的日抛’。」宁畅CEO秦晓宁在3月29日北京举办的宁畅「全局智算」战略发布会上说。

▲宁畅CEO秦晓宁

AI大模型日新月异,客户涌现出对于AI支撑能力体系愈发复杂的需求。不管是万卡时代的算效「彩票」还是深入行业的精度「盲盒」,以及高效调用的服务「瓶颈」,算力产业如何解决这些问题,如何满足大模型客户不同的复杂需求,如何建立起一套全面的AI支撑能力体系,都是当下亟需解决的问题。

基于这样的背景,在大模型遍地开花之春,宁畅于3月39日发布了「全局智算」战略,在业内率先开启大模型时代智能算力系统变革的冲锋。

同时,宁畅还推出包括「AI算力栈」在内的一系列战略性新品与系统解决方案,以助大模型产业解决大模型产业落地的全周期问题。

一、大模型遍地开花,用全局智算栽培「AI+」硕果

我国大模型已经遍地开花。根据国家数据局最新统计,中国10亿参数规模以上的大模型数量已超100个,行业大模型已经在赋能各个领域。

大模型狂欢背后,是大模型行业和企业的需求不断升级,推动整个AI支撑能力的加速迭代。

深扎AI算力领域多年,秦晓宁在过去近一年里有了新发现。她观察到,大模型发展到现在,客户的需求大致呈现了两个阶段的变化:

第一阶段:「百模大战」时期,流行这样一句话:不管大模型发展得如何,卖铲子的供应商肯定不会亏。大模型是科技巨头之间的参数极限的竞赛,算力提供商就像卖铲子一样,只需要提供更快更强的硬件产品,不用太关注大模型客户如何去挖掘「金矿」,

第二阶段:也就是进入2024年以来,随着外部环境变化,大模型从参数竞赛走向了商业化、产业化的落地阶段。供应商不仅要提供算力硬件,更多的是整个支撑能力体系的升级,就像「木桶原理」一样,各类能力都不能有短板。

秦晓宁认为,客户需要在算力、算法、数据三个维度获得更强的支撑,并在AI的硬件层、集群层、中台层、内容层、服务层都获得全方位多维度的能力。

为此,宁畅宣布推出「全局智算」战略,助客户解决复杂、系统性的大模型落地问题。

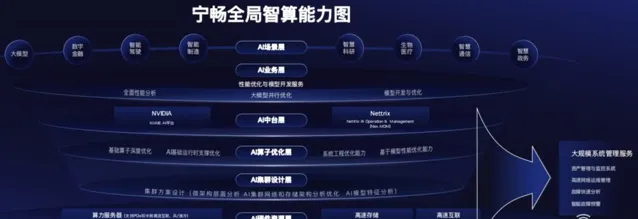

全局智算,顾名思义,就是以系统、全面性来对抗需求的复杂性,以全面AI支撑能力覆盖大模型发展的全生命周期。如下图所示,全局智算主要包括六大层面。

▲宁畅全局智算能力图

最底层是硬件资源层,这是被大家最广泛所熟知的,以传统的通用服务器、GPU、整机柜、存储、网络等多种形态的硬件产品为主。

第二层是集群设计层,这不是将海量硬件进行简单的连接堆叠,而是通过分析整个业务运行的特征和系统的量化需求,提供从微架构、网络、存储到AI模型特征等一系列的方案化设计。

第三层是算子优化层,为了降本增效宁畅提供了整体的AI算子优化能力,减少模型执行的时间,降低资源消耗,提高能效比,使得AI能够在有效的资源上高效运行。

第四层是AI中台层,目前宁畅已全面支持NVAIE的中台系统,及自己的中台NEX AIOM,这个系统可以提供基于AI算力系统深度整合的工作栈。

再往上,则是更具体的业务层和场景层,宁畅也提供相应的解决方案及服务。

总的来看,宁畅提出的「全局智算」战略,试图通过全体系、全液冷、全服务、全场景、全行业、全阶段这「六全」来为大模型提供全周期服务,从而培育出「AI+」产业化的硕果。

▲宁畅全局智算硬件产品「全家福」

二、硬软服一体化,破解智能算力落地难题

过去一年,受益于「百模大战」,我国算力规模加速扩容,为算力落地应用提供了一定基础。

根据工信部发布数据,截至2023年10月我国算力规模超300EFLOPS,智能算力占比高达35%;同时,我们看到千P级智算中心的智算基建布局集中爆发,数亿到10亿元的GPU服务器采购及算力租赁订单比比皆是,众多算力概念股也被带飞。

但与此同时,智能算力的落地应用问题依然严峻。如何让千卡甚至万卡算力从硬件,转化为大模型企业的模型性能,甚至是「AI+」行业落地的成功?算力产业还有一段路要走。

对此,宁畅推出了「AI算力栈」,以底层硬件到顶层应用平台的系统化方案,构建全栈AI环境,满足大模型落地所需的计算、存储、网络、建设、管理、应用及液冷等需求。

宁畅CTO赵雷介绍,在硬件层上,宁畅「AI算力栈」可实现多种交付形态灵活组合。其中,宁畅B8000液冷整机柜服务器作为AI算力栈最具亮点的交付形态,采用电、液、网三路全盲插设计,部署周期相较传统方式提升30倍。

▲宁畅CTO赵雷

在软件层上,基于系统工程及算法模型,宁畅以AI算子全栈优化能力,为AI业务提供并行加速、性能分析、模型开发优化等服务支持,构建出从算力资源定制,到模型适配优化,再到高效部署落地的大模型算力服务闭环,帮助用户极速推进AI应用开发及管理。

英特尔AI首席架构师吴震华强调:「第四代/第五代英特尔® 至强® 可扩展处理器的卓越性能,将为宁畅AI算力栈带来更强助力。」

此外,在智算中心建设大潮下,宁畅「AI算力栈」方案以其全面、灵活、深度的支撑能力,可为行业级/企业级智算中心的构建提供强有力的支持,确保智算中心的建设既符合当前业务所需,又具备前瞻性与适应性。

纵观整个算力产业,我们看到包括「味精大王」在内的不少跨行玩家都涌入了智算产业,但兼具硬、软、服实力的玩家并不多。

透过宁畅「AI算力栈」,应该可以明确的是,企业和行业为了避免重复建设和浪费,应该选择没有能力短板的专业AI算力提供服务商,搭建智能计算的新高地。

三、宁畅打造王牌AI算力栈,加速千行百业数智化

目前,国内首个「AI算力栈」——宁畅NEX AI Lab(Nettrix AI Open Lab)已在桐乡市成功落地并开放预约试用。

▲宁畅NEX AI Lab

这一AI算力栈项目是一个包括128台GPU服务器的千卡级别算力集群。该项目展现了应用场景优化、行业智算定制解决方案,通过免费提供软、硬件服务,带来大模型、数据科学、推荐系统等解决方案工作流的先进体验。

同时,它可以给用户提供免费的算力体验,大家可以把自己的业务拿到上面运行,尝试不同的业务组合、不同的网络方案、不同的软件和框架的调整,以便快速作出购买决策。

赵雷透露,这一AI算力栈最主力服务器采用X640 G50服务器,单台具备956T的算力;同时支持20个节点的X680 G55液冷服务器,有效地验证了液冷服务器在高带宽情况下的使用情况。

在应用方面,这一AI算力栈已正式运行近三周。该算力栈已完成了大量的多元AI场景的实际应用,包括语言模型、OCR、翻译、智能推荐等,都顺利完成了初步测试。

宁畅自2019年创立以来,根据知名行研机构IDC报告,其在2021年就拿下来中国GPU及加速计算服务器市场年度销售额第二的宝座。现在,乘风新一波AI大模型浪潮,宁畅正通过千卡集群级的AI算力栈,布局更大的「全局智算」蓝图,从而助力千行百业的数智化转型。

结语:智能计算升级,为大模型产业发展保驾护航

回顾2023年,在「百模大战」狂潮之中,智能算力成为一门好生意。以宁畅为代表的算力供应商在厚积薄发的同时,也在大模型市场需求的推动下,探索智能算力系统的新迭代。

展望2024年,「AI+」时代的大模型产业化落地正在加速,谁在盛名之下其实难副,谁是真枪实剑披挂上阵?宁畅正用「全局智算」战略及其AI算力栈方案给出一份自信的答卷,为大模型产业发展保驾护航。