8 月 28 日,一位 IP 定位显示在韩国的女性,在咱们国内社交平台的发文引起高度关注。

而她顺着网线跑到异国他乡的原因,是为了 求救 。

根据她在博文中的描述,许多韩国女性正生活在 Deepfake 的阴影中,成为 AI 换脸的受害者,希望中国朋友把这事传出去。

就在一天后,又有一位韩国女性前来发文,直言 「韩国的换脸问题太严重了」 。

甚至,她还将此事与之前的「N 号房案件」关联到一起。

说起「N 号房案件」,想必部分家友会有印象 —— 在 2020 年,几位韩国案犯通过社交平台建立多个秘密聊天房间,将被威胁的女性(包括未成年人)作为性奴役的对象,并在房间内共享非法拍摄的性视频和照片。

伴随几位韩国女性在微博发文,Deepfake 深陷舆论风波,在过去几天里,多个与之相关的负面话题登上热搜。

在热搜的发酵下,许多网友表示「N 号房」卷土重来,一场 「N 号房 2.0 事件」 浮出水面。

韩国女性究竟遇到了啥、Deepfake 到底有多可怕, 小编接下来就聊聊。

01.

N 号房 2.0

这场「N 号房 2.0」事件的开端,可以追溯到今年 5 月 ——

【韩联社】在 5 月 21 日报道称,首尔大学毕业生朴某和姜某,从 2021 年 7 月至 2024 年 4 月, 涉嫌利用 Deepfake 技术换脸合成色情照片和视频 ,并在 Telegram 上私密传播,受害女性多达 61 人,包括 12 名首尔大学学生。

当时,该事件被称为「首尔大学版 N 号房」。

也就是从那时起,韩国社会因 Deepfake 出现了恐慌情绪,人们越发开始担心自己会被 Deepfake 的魔爪抓住。

而这份恐慌,最终在前段时间爆发了,因为有更多让人触目惊心的内幕被扒了出来。

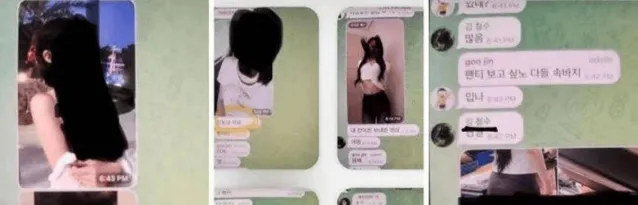

起初是一位韩国网友发帖称发现了一个聊天室,里面的内容令其「大开眼界」。

聊天室聚集着上千网友, 分享自己偷拍妈妈、姐姐、妹妹的暴露照片 ,群里充斥污言秽语。

经该网友顺藤摸瓜,发现相似的聊天室比比皆是,其中一些聊天室明确规定,想要加入的条件,是上传女性亲属的不雅照片或视频。

随着该帖子的发布,顿时在韩国引发轩然大波,众多女性想起了被「N 号房」支配的恐惧。

为了探寻更多的细节,一些媒体特意安排记者到各个聊天室中卧底,结果发现了更为严重的情况。

部分聊天室为了更方便获得乐子, 利用了 Deepfake 技术 ,只需把女孩的照片发进聊天室,就能得到一张合成的色情图片。

聊天室中的成员,大多都是年轻男学生,因此惨遭他们毒手的,基本就是女同学、女老师和女生朋友。

更为过分的是,一些人拿到合成图后,会搜索找到受害女性真人所在的聊天室,发送合成图并进行言语羞辱。

经记者调查发现,这样的聊天室数量数不胜数,规模最大的一个, 拥有近 22 万名成员。

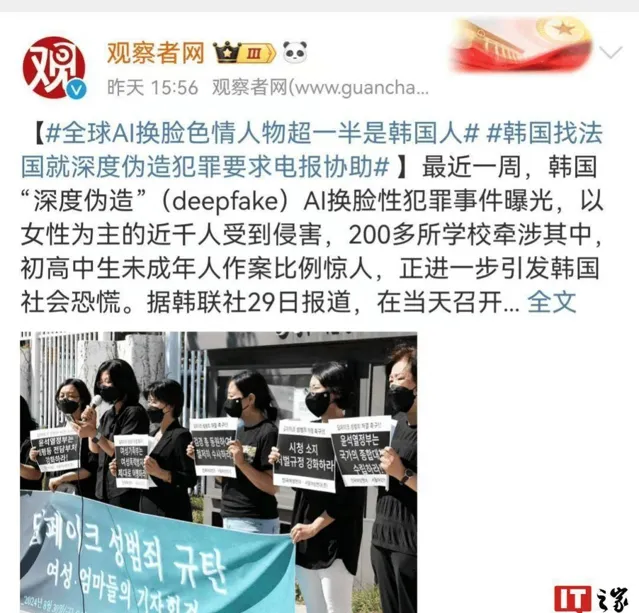

需要注意的是,据观察者网报道,韩国【中央日报】援引美国安全服务机构「Security Hero」最新公开的【2023 深度伪造技术现状】报告报道称, 韩国被评为最容易受到深度伪造技术性剥削的国家 。

据报道,去年 7 月至 8 月,对前 10 名 Deepfake 色情网站和 85 个 Deepfake 频道进行分析的结果显示,在 Deepfake 技术性剥削物中出现的人物中,53% 是韩国人,排名第一。

02.

深受其害者不计其数

实际上,韩国女性并非是 Deepfake 唯一受害群体,深受其害者大有人在,最早可以追溯到 2017 年。

当时,有网友在 Reddit 论坛上利用 AI 换脸软件, 将【神奇女侠】的主角盖儿加朵的脸移花接木到成人电影主角身上 。

后续,有人将公开的的算法加以改造推出相关 App,大大降低了使用 AI 换脸的门槛。

由于使用方法非常简单, 许多网友便将女明星的脸换到色情片中 ,给诸多女星造成了极大困扰。

虽说,后来各个平台为了遏止「换脸色情电影」的歪风,纷纷禁止相关内容出现,但潘多拉之盒已然打开,想关上就没那么容易。

比如在今年年初,X、Facebook 等社交平台上出现了大量泰勒斯威夫特的 Deepfake「不雅照」,闹得满城风雨。

在女明星受害的同时,还出现了黑产业链,中新经纬曾报道过,售卖明星换脸的不雅视频等已经成为一门生意。

一些平台的卖家,不仅宣称手里有已经制作完毕的明星 AI 换脸视频可以出售,还表示可以提供视频定制换脸产品。

甚至还有卖家宣称可以 传授 AI 换脸技术 ,据悉费用不算高。

由于操作简单, Deepfake 可以做到害人于无形 ,仅需一张自拍照或带有肖像的照片,就会被合成到不雅图片或视频中。

而在制造出不雅照后,难免会有人动歪歪心思。

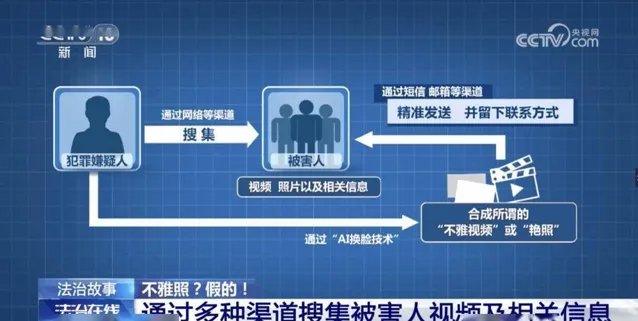

在今年 6 月,【法治在线】曾介绍了两起「AI 换脸伪造不雅照」案, 相关诈骗团伙主要利用被害者视频照片信息制作「艳照」进行敲诈。

一起是深圳市民吴先生收到一张包含自己与一名不认识女子的「艳照」彩信,犯罪嫌疑人在彩信中威胁当事人需在指定时间前将钱财转到指定账号「破财消灾」。

另一起是威海王先生接收到一张包含自己面孔的「裸照」彩信,附带有「我有你的全部影像资料」等文字内容。

不仅伤害了无辜女性,还妄想敲清白男性一笔...... 可真「刑」啊!

03.

有人骗人,有人暖人

当然了,Deepfake 的危害不仅仅体现了色情方面,运用于诈骗中亦能做到防不胜防。

平安包头报道过一起诈骗事件,诈骗犯利用 AI 换脸技术,冒充受害者的好友通过微信视频借钱, 仅用 10 分钟骗走了 430 万元。

从现实情况来看,Deepfake 可谓是作恶多端,与其相关的新闻,都带有恶劣色彩。

毕竟 Deepfake 这个词的意思是 「深度伪造」 ,生成的又都是虚假内容,本身看上去就带有贬义因素。

只是作为其最常见的方式 AI 换脸,其实是有积极用途的。

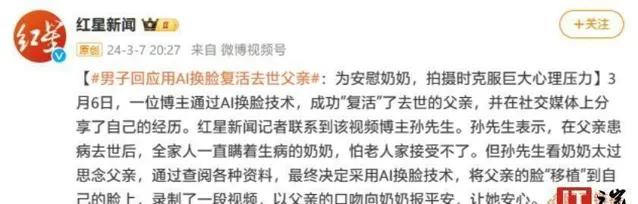

先前,一名男子的父亲因罹患阑尾黏液腺癌病去世,全家人一直瞒着生病的奶奶,怕老人家接受不了。

但该男子看奶奶太过思念,便查阅各种资料, 最终决定采用 AI 换脸技术将父亲的脸「移植」到自己的脸上 ,录制了一段视频,以父亲的口吻向奶奶报平安,让她安心。

此情此景,正如家友评价那般: 有的人用 AI 以假乱真去骗人,有的人用 AI 以假乱真温暖人。

04.

科技是一把双刃剑

自 AI 的浪潮兴起后,由于展现出的功能性过于强大,再加上迭代速度日新月异,围绕在其身上的争议就没断过。

它在让许多人获益的同时,也让不少人受到伤害, 轻则违背道德,重则违反法律。

作为一种技术,AI 可能本无对错,之所以会出现错误,本质还是出在人身上,毕竟技术本中立,但其方向由人控制。

科技是一把双刃剑,用于正道,会传递正能量;用于邪道,则会惹是生非。

技术没有上限,同样,人心也没有下限, 一旦一项技术能用在不好的地方,那或许就会被用在不好的地方。

对了,别忘了今天还有 【华为余承东回应「享界 S9 飞坡测试」】 等文章,以及:

3天卖了1000多万份近30亿元,【黑神话:悟空】正带飞国产显卡 那颗由索尼相机垄断的「工业皇冠明珠」,被咱摘了下来 手握13亿文档,豆丁网100万元被「贱卖」

N号房卷土重来↓↓↓