当前人工智能正加速爆发期,AI芯片作为服务器中的核心高价值组成部分,迎来量价齐升,

AI算力芯片的全产业链包括最上游的EDA(电子设计自动化)软件及IP核的研发;中游芯片制造涵盖GPU、NPU、ASIC、FPGA等多种架构,这些实现AI算力的核心硬件;而下游的AI服务器及智算中心这些设施将AI芯片集成到实际应用中,为AI应用提供算力支持。

关注【乐晴行业观察】,洞悉产业格局!

传统服务器依赖CPU作为主要的计算能力来源,但在实际运行中频繁涉及分支跳转和中断处理,限制了在AI时代的应用效能。

相比之下,AI服务器采用GPU及异构形式来提供强大的计算能力。能够高效地并行处理庞大数据集,满足AI与机器学习算法对复杂数据计算的需求。

根据部署环境的不同,AI芯片分为云端芯片和终端芯片。前者主要应用于数据中心等服务器端;后者广泛应用于手机、汽车、安防摄像头等各类电子终端设备中。

从功能角度来看,AI芯片又细分为训练芯片和推断芯片。

训练端负责构建神经网络模型,涉及处理海量数据并执行大规模计算,对算法的先进性、计算精度以及处理能力有着极高的要求,更适合在云端进行部署。当前,A100、p00等是主流的训练芯片。

推理端则利用已训练好的模型,对新输入的数据进行快速推理得出结论,更注重能效比、低时延和功耗控制。T4、A10等是目前常用的推理芯片。

当前,GPU(通用型)、FPGA(半定制化)和ASIC(全定制化)构成了AI芯片行业的主要技术路径。

AI芯片产业图示:

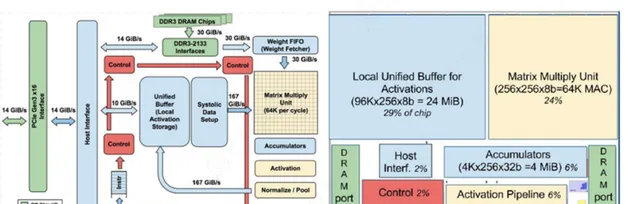

其中,TPU(张量处理单元)是ASIC的一种,是谷歌专为加速深度神经网络运算而开发的定制芯片。

TPUv1通过PCIe(高速串行总线)接口与主机通信,并能直接访问其内置的DDR3存储。

TPU架构:

资料来源:谷歌

谷歌开发的TPU是一款专为AI应用设计的ASIC芯片,其研发初衷是为了满足谷歌自身云服务与终端产品的需求,自2016年推出第一代以来该芯片已迭代至第五代。

中昊芯英是国内唯一掌握TPU架构下训推一体AI芯片核心技术的厂商,国内厂商科德教育通过参股7.7971%的方式,与中昊芯英建立联系。

随着大模型与AI产品研发需求的不断增长,资本支出也不断攀升。2024年第二季度,微软、Meta、谷歌和亚马逊这四家公司的合计资本支出达到了571亿美元,同比增长66%,环比一季度增长22%。全球范围内,主导人工智能芯片布局的企业包括英特、英伟达、高通以及谷歌等。

科技巨头们近年来不断加大算力采购力度,据Omdia Research分析,Meta和微软是p00的最大买家,紧随其后的是谷歌、亚马逊、甲骨文和腾讯。此外,CoreWeave、百度、阿里巴巴、字节跳动、以及特斯拉等公司也是p00的重要客户。

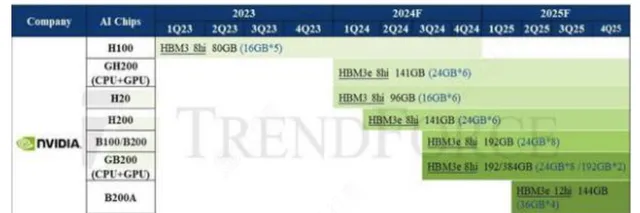

英伟达 AI 芯片生产时间及未来规划:

资料来源:TrendForce

关注【乐晴行业观察】,洞悉产业格局!