作为最早投入人工智能基础设施的公司,商汤(00020.HK)凭借「大装置+大模型」的前瞻性战略布局,在2023年斩获生成式AI业务的爆发式增长。

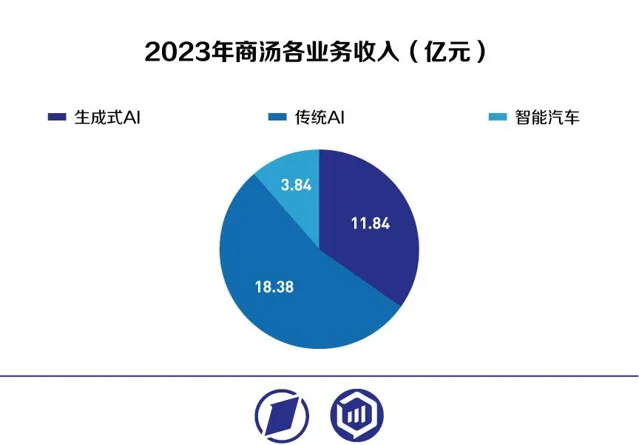

3月26日,商汤公布2023年经审核的全年业绩。2023年,商汤实现营收34.05亿元(人民币,下同),毛利15.01亿元。这一年,商汤明确了新的三大业务板块:生成式AI、传统AI和智能汽车,分别对应提供生成式AI的模型训练、微调及推理服务业务,传统智慧城市、智慧商业与智慧生活的非生成式AI业务,以及原智能汽车业务。

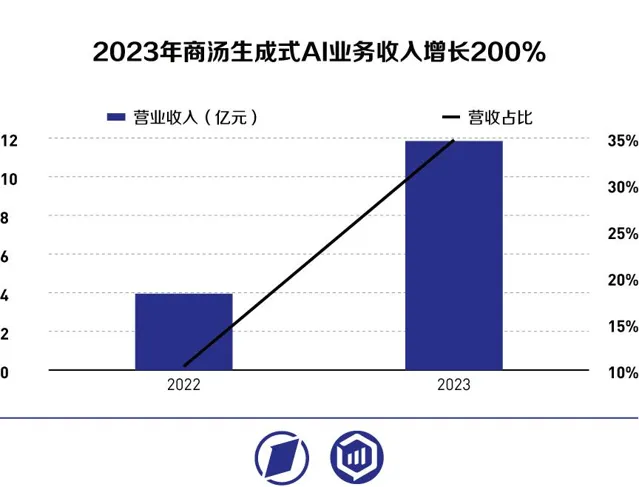

其中,生成式AI业务2023年收入达11.84亿元,实现了同比200%的飞速增长,总收入占比超达35%。这是商汤成立十年以来,以最快速度实现从无到有,并取得、超过10亿元收入体量的新业务。

「生成式AI对商汤来说已不仅仅是技术领域的变革性创新,更成为公司的核心业务。」商汤集团董事会执行主席兼首席执行官徐立表示,「商汤生成式AI业务的增长,得益于各行各业对大模型训练和推理的广泛需求,这预示着中国硬科技投资的新周期正式开启。商汤通过在各业务层面深入融合生成式AI能力,正在赢得新客户,并推动效率和生产力的全面提升。」

前瞻性布局「大装置+大模型」,赢得发展「时间窗口」

2023年初,ChatGPT出圈引爆生成式AI发展热潮,国内AI大模型也如雨后春笋般涌现。随着AI正式进入2.0时代,生成式AI如何落地与变现,成为所有参与者需要共同思考的问题。商汤已成为生成式AI收入最早突破10亿元大关的公司之一,主要是缘于其前瞻性战略「大装置+大模型」协同的成功,为商汤其在这场AI争流赛中争取到了最佳时间窗口。

早在2018年前后,商汤就开始每年投入数十亿到SenseCore大装置,并建设了临港AIDC(人工智能计算中心)。可以说,为了建设耗资巨大的AI基础设施,商汤主动选择了亏损。商汤这一举措在当时争议较大,并没有取得普遍认同。但2023年生成式AI爆发式发展,智能算力需求激增,商汤所持有的大算力成为行业稀缺资源,证明了商汤决策层的高瞻远瞩。

在大模型方面,商汤起步较早,是国内首个发布超过千亿参数级大模型的厂商。

自2018年起,商汤便致力于AI大模型的研发,有着超过5年的技术积淀和实践经验。2019年,商汤就具备了千卡并行的系统能力,使用上千张GPU卡进行单任务训练,推出了10亿参数量规模的视觉模型,实现了当时业界最好的算法效果。2021-2022年,商汤训练了百亿参数规模的超大视觉模型,相当于千亿参数语言模型的训练量。目前,商汤已成功研发了320亿参数量的全球最大的通用视觉模型,实现了高性能的目标检测、图像分割和多物体识别算法,并在自动驾驶、工业质检、医疗影像等多个领域得到广泛应用。

凭借着「大装置」与「+大模型」的先发优势和协同,商汤成为了业内为数不多的能够保持大模型高速迭代的公司。

2023年4月,商汤推出了「日日新大模型1.0」版本,这是国内首个千亿级参数的大语言模型,同时还包括文生图、3D内容生成等多种生成式AI模型,成为当时国内最全面的大模型系列之一。

同年8月,「日日新2.0」版本发布,这是国内首个性能超越GPT-3.5-turbo的大模型。

同年12月,「日日新3.0」版本发布,基模型的能力进一步提升,率先支持不同模态工具的调用。秒画文生图模型也升级至百亿参数量级,其语义理解能力与图像质感显著增强,维持了在国内的领先地位,并实现了十倍的推理加速效果。

2024年2月,商汤推出的「日日新4.0」性能显著提升,在代码编写、数据分析和医疗问答等多个场景中,达到了与GPT-4相匹配的能力水平。同时,商汤预计4月份发布「日日新5.0」版本,性能全面对标GPT4-Turbo。

此外,商汤还开源了InternLM2-7B与20B两种不同参数规格的基模型,性能超越了Meta的Llama2和谷歌的Gemma等同级别的开源模型。

商业模式上,商汤推出全新的「模型即服务」,使客户能够轻松地在大装置微调和调用各类生成式AI能力,而无需管理底层基础设施。

正是「大装置+大模型」前瞻性战略的坚定实施,为商汤赢得了AI 2.0时代发展的先机。商汤在财报中表示,未来将加快生成式AI的商业化进程和市场渗透,为用户提供具有最优性价比的生成式AI解决方案。

聚焦生成式AI核心业务,保持新业务爆发延续性

基于生成式AI逐渐着眼于落地与变现,在人工智能基础设施和「日日新」大模型体系的支持下,商汤也在2023年开始将其生成式AI相关应用产品商业化。

作为老牌AI企业,商汤在AI 1.0时代就积累了大量优质客户。这些客户在AI 2.0时代迅速转换为生成式AI客户,且在快速落地后带来背书效应,以此虹吸更多客户选择商汤大模型服务。财报显示,生成式AI业务中超过70%的客户在过去12个月内是商汤的新客户,剩下的30%的存量客户客单价也收获约50%的增速。截至最新,商汤订单金额超过千万元人民币的客户数已达到数十家。日日新大模型赋能C端的调用量更是呈现出近120倍的增长。

应用场景方面,凭借此前在智慧城市和智慧商业领域积累的客户资源和场景运用,商汤生成式AI技术在这些场景实现快速应用和推广。

在智能终端业务方面,商汤的传感器、AISDK软件、AIISP芯片赋能的手机数量已经超过了20亿台,为商汤端侧生成式AI业务的发展提供了广阔的空间。

在企业Copilot助手领域,商汤大模型处理Excel表格等数据分析能力领先,被金山办公、海通证券、招商局集团等头部客户采用。该模型在SuperClue代码评测中荣获榜首,在上千题的数据分析测试集的精度超过了GPT-4。

根据弗若斯特沙利文【2023年中国AI开发平台市场报告】,商汤在增长指数和创新指数两大评估维度的综合评分中位居国内首位。这一成绩不仅展示了商汤在生成式AI领域的领先地位,更是对其创新能力和市场扩张速度的国际认可。

商汤在财报中表示,计划进一步发挥「大装置+大模型」的深度协同优势,持续投入「日日新」模型体系的迭代,让模型能力保持业界领先。同时将致力于实现大模型推理效率提升的「摩尔定律」,通过云+端结合等创新优化策略,让模型推理成本迅速降低,从而打开更广阔的应用前景。

与此同时,商汤将推动算力规模持续增长,以保障生成式AI业务长期发展。

目前商汤管理的算力实现了全国联网的统一调度,在上海、深圳、广州、福州、济南、重庆等地都拓展了新的计算节点,总运营算力达到12000petaFLOPS,上线GPU数量达到45000张。商汤预计,2024年将会更大面积地拓展全国的算力节点,输出丰厚的「新质生产力」。

同时,出于更全面、长远的考虑,商汤增加了对华为昇腾、寒武纪等主流国产芯片的适配,以全国产的技术栈,支持大模型的训练、微调和推理。而实现这一点的关键,是商汤参与联合开发的DeepLink开放计算体系。

DeepLink是连接国产硬件和主流深度学习算法框架的桥梁和纽带。DeepLink有300多个标准化算子接口;基本上CUDA能够支持的AI大模型计算需求,DeepLink也完全能够支持,覆盖率在99.5%以上。有了DeepLink,各类国产芯片就可以轻松适配主流的大模型训练框架和算法库,比如PyTorch、DeepSpeed等常见的开源训练框架,还有商汤推出的OpenMMLab、OpenDILab、OpenGVLab等开源算法库,充分发挥国产芯片的性能。

环顾AI大模型行业,商汤的优势在于多年来的技术沉淀、人才储备、商业化经验与客户基础,同时拥有业内稀缺的大算力基础设施,这些优势有望最终成为商汤生成式AI收入大幅增长的源动力。正如商汤2024年战略目标之一——推动核心业务盈利,「我们将加快生成式AI的商业化进程和市场渗透,集中资源于生成式AI业务以改善现金流和减少亏损。」