在悄無聲息中,具有裏程碑價值的GPT-3.5問世已滿一年。在這一年的時間裏,我們不僅見證了,還親自參與了科技界的歷史性變革。基於大型語言模型(LLMs)的各種AI對話套用已經遍布我們生活的每一個角落。許多人已經不再依賴於開啟搜尋引擎來解決問題,而是轉向與AI對話尋求答案。

By Midjourney

但也有不少小夥伴在使用過一段時間後,覺得有些無聊。確實,當前的AI雖然可以在對話方塊中跟你侃侃而談,而卻不能幫你解決一些實際問題。比如說幫你訂個飛機票,叫個出租車,或者當你想要在PS中把這個照片的背景P掉的時候,這些對話方塊只會給你具體操作的步驟,卻不能幫你去完成。不少使用者渴望的是一個更能動手實際操作的AI,不僅能夠提供資訊,還能夠執行具體任務。

By Midjourney

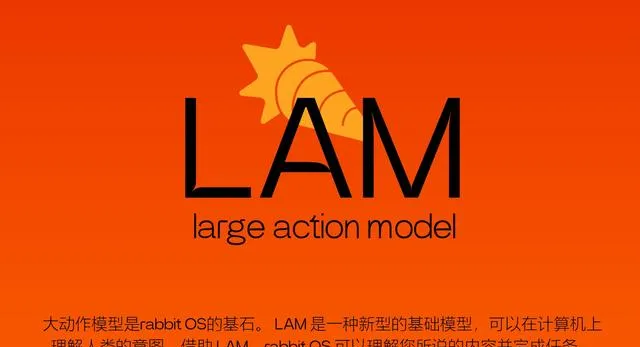

懶,才是人類的第一生產力。正是這種對舒適與便捷的渴望,孕育出了一系列劃時代的產品。如今,為了滿足人們希望AI能夠協助解決實際問題的願望,大型動作模型(LAMs)應運而生,它們的目標是讓AI的能力不僅限於提供資訊和執行虛擬任務,而是擴充套件到現實世界的物理動作中,進一步釋放人類從日常瑣事中的束縛。

By DALL-E 3

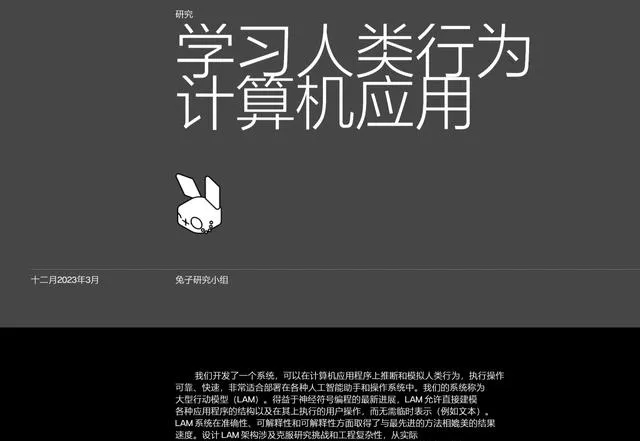

在2023年12月初,一家創新的研究團隊Rabbit搶先釋出了他們的第一個大型動作模型系統——Rabbit OS。

圖片源自互聯網

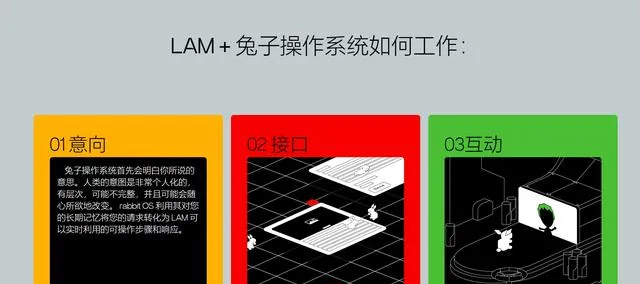

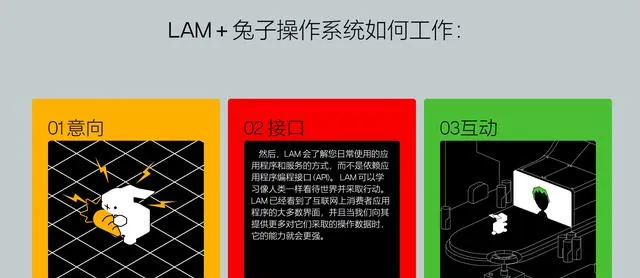

Rabbit團隊闡述,Rabbit OS並不是建立在像ChatGPT這樣的大型語言模型上,而是創新性地構建在「大型操作模型」之上。它在概念上與Google Assistant類。Rabbit OS能夠透過一個統一的界面來實作音樂控制、點個外賣、打個滴滴、買個飛機票、買張電影票,給女友買束花以及購買生活必需品等多種任務。使用者不必切換不同的應用程式或者重復登入——只需告訴Rabbit OS你需要什麽,它就能幫你搞定。

圖片源自互聯網

圖片源自互聯網

這個LAM的概念釋出之後,就引起了老外的強烈關註,畢竟這個邏輯鏈是完全正確的,當LLMs已經成熟的時候,人們只需要與AI對話,AI便可以準確清晰地理解你的意圖,並直接透過LAMs實作你想要的現實操作。

圖片源自互聯網

圖片源自互聯網

圖片源自互聯網

於是Rabbit順水推舟地釋出了,旗下第一款載入了LAMs Rabbit OS的Rabbit R1。

圖片源自互聯網

Rabbit R1看起來有點像是過去90年代的旋鈕電視的縮小版,圓潤外觀是與知名設計公司Teenage Engineering的深度合作成果,正面左側2/3是螢幕,另外一部份是控制區與網路攝影機,看起來非常具有復古感。

圖片源自互聯網

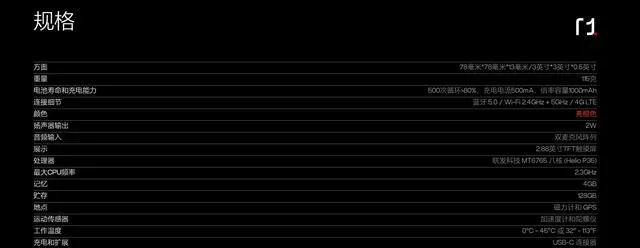

設計緊湊,體積僅為iPhone一半大小的R1,搭載了一塊2.88英寸的觸控式螢幕,並配備一個旋轉網路攝影機,可以輕松拍攝照片和視訊。此外,透過獨特的滾輪/按鈕,使用者可以方便地瀏覽內容或與裝置內建的助手進行互動。

圖片源自互聯網

圖片源自互聯網

效能方面,Rabbit R1內建了一顆2.3GHz的聯發科八核處理器,使用了4GB+128GB的儲存組合,對於這種小型裝置來說,效能足夠用了。

圖片源自互聯網

這款裝置售價為199美元(約折合1450元人民幣),對於一款新公司的初代產品來說,這個價格已經是非常良心了,初代量產的1萬台,也於釋出後的當天下午售罄。

圖片源自互聯網

那麽,Rabbit R1可以幫使用者幹什麽呢?根據已經上手過的老外介紹,Rabbit R1是一個語音互動式智慧裝置,使用者無需開啟應用程式,直接透過物理按鍵與其對話互動,就可以實作手機上音樂軟體開始播放或自動打車等,有點像是對講機的實作邏輯,仿佛對講機對面真的有一個私人秘書在幫你實作這一切。

圖片源自互聯網

Rabbit R1將應用程式與使用者的線上帳戶連線起來,並使用其自研的大型動作模型來解析語音命令,輔以GPT語言模型(主要負責轉換人類的指令為文本並進行解讀)來完成任務。它允許使用者透過語音指令客製個人化操作,無須開發特定的API。該裝置的動作模型透過分析人與應用程式的互動來學習操作方法。

圖片源自互聯網

讓AI從對話方塊走向現實,這可能就是Rabbit開發LAM以及釋出Rabbit R1的意義,實體化的操作邏輯與獨特的動作學習功能,讓Rabbit R1在海外的好評不斷。

圖片源自互聯網

圖片源自互聯網

在這個AI迸發的時代,各大AI科技公司都推出了自己的大型語言模型(LLM)套用,如GPT、Bard以及國內的文言一心、月之暗面、通義千問等,這些產品的多樣性往往讓使用者感到困惑。而Rabbit的策略則完全不同,它透過一個界面連線不同的套用,以解決使用者的實際問題,類似於一個多功能的超級應用程式,使用者可以透過這一平台完成幾乎所有的任務,體驗一站式的便捷AI服務。

圖片源自互聯網

圖片源自互聯網

展望未來,我們期待地看到LAMs(大型動作模型)的整合範圍擴大到更多的智慧家居裝置、智慧汽車和智慧公共設施中。這種融合有望實作真正的人機對話——使用者只需簡單發出口頭指令,裝置便能自動辨識、理解和執行所需的操作。這將是一個巨大的躍進,將極大地提高生活的便利性和效率,而且還將為殘障人士和其他需要輔助技術的群體提供更大的自主性和支持。