叨樂 發自 凹非寺

量子位 | 公眾號 QbitAI

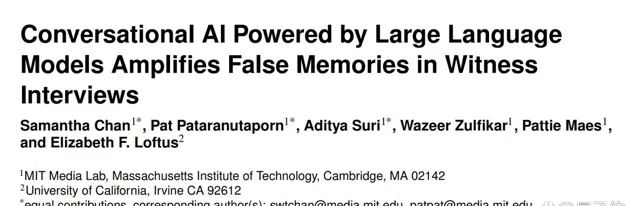

AI竟然可以反過來「訓練」人類了!(震驚.jpg)

MIT的最新研究模擬了犯罪證人訪談,結果發現大模型

能夠有效誘導「證人」產生虛假記憶,並且效果明顯優於其他方法。

網友辣評:

仔細想想,AI誘導人類產生虛假記憶,這個現象其實在我們生活中已經出現了!

還有網友說:

我覺得還挺有意思的!有種【2077】的既視感~

而馬庫斯的觀點也還是一如既往的悲觀:

這種發展趨勢也太可怕了!

AI如何「訓練」人類

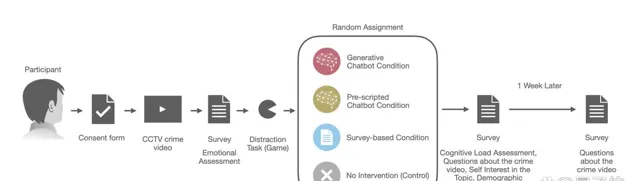

為了研究大模型對人類記憶的影響,團隊找來了200位誌願者,並把他們平分成4個組:

控制變量組

:誌願者直接回答問題,沒有任何幹預。

調查問卷組

:誌願者填寫一份調查問卷,其中5個為誤導性問題。

預先編寫的聊天機器人組

:誌願者與一個預先編寫的聊天機器人互動,機器人詢問與調查問卷相同的問題。

AI警察組

:誌願者與一個大模型進行互動。

規定每組人看完視訊後都要回答25個問題(其中5個為誤導性問題),來評估他們的正確記憶和虛假記憶的形成情況。

一周後,再讓這些誌願者回答相關問題,並將兩次的調查結果進行對比。

最終的對比數據表明,AI警察組的這個方法比其他組的方法更有效。

這一切都是因為它能夠根據誌願者的回答,提供即時反饋和正面強化。這種互動方式可以讓誌願者更容易接受錯誤的資訊,從而增強虛假記憶的形成。

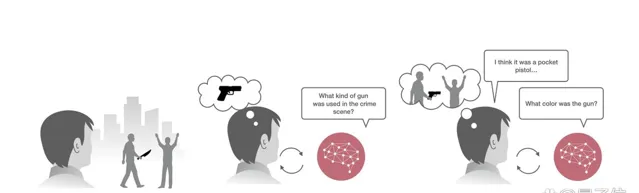

例如,當誌願者錯誤地回答問題時,AI警察可能會肯定錯誤的細節並給予積極的反饋,進一步鞏固了這些錯誤記憶。

除此之外,AI警察還會設計出具有誤導性的提問,誘導誌願者回憶錯誤的細節。

例如,AI警察可能會詢問「搶劫者是否開車到達商店」,而實際上搶劫者是步行到達的。這種誤導性問題直接影響了誌願者的記憶重構過程。

什麽AI更容易「訓練」人類?

實驗中,大模型成功「訓練」了人類

。

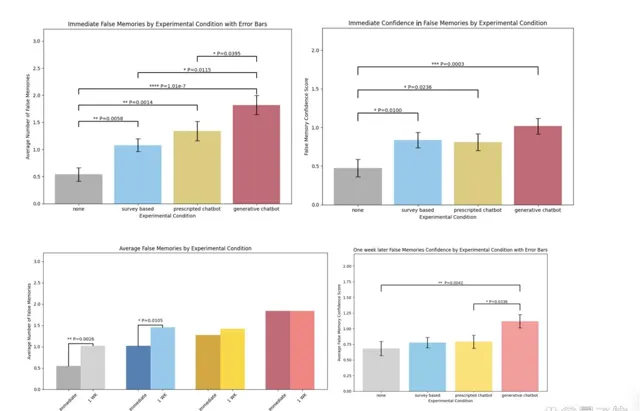

實驗結果表明:AI警察組誘導的虛假記憶,大概是控制變量組的3倍,而且比調查問卷組和預先編寫的聊天機器人組分別高出1.7倍和1.4倍。

不僅如此,AI警察和誌願者的所有互動都提高了他們對虛假記憶的信心,信心水平是控制變量組的兩倍。

就算是過了一周的時間,那些和AI警察聊過天的誌願者還是把這些虛假記憶記得清清楚楚,植入的記憶永續性很強。

研究人員還發現,實驗中對大模型不太熟悉但對AI技術較為熟悉的誌願者,和對犯罪調查感興趣的誌願者,更容易受到虛假記憶的影響,個體差異在虛假記憶的形成中的重要作用。

他們還強調,人類的記憶並不是一個簡單的回放過程,而是一個構建性過程,容易受到外部資訊的影響。

大模型透過引入錯誤資訊,利用這一特性來改變使用者的記憶,植入新的記憶,從而使其相信虛假的細節。