此前,一道低難度的數學題—— 9.11和9.9哪個更大,難倒了一眾海內外AI大模型,也讓外界了解到了大模型在推理方面的局限性。

不過,情況正在迅速發生改變。當地時間8月27日,據The Information報道, OpenAI神秘「草莓」(Strawberry,前身為Q*)計畫,計劃最早於今年秋季推出。同時,用「草莓」合成數據來開發的最新大模型——「獵戶座」(Orion),或於明年年初推出。

據悉,「草莓」是一個推理模型,有著強大的推理能力,可處理復雜的問題;「獵戶座」則是超越GPT-4的下一代大模型,可幫助OpenAI減少其模型產生的錯誤數量,即所謂的幻覺。

據The Information援引知情人士稱, 今年夏天,在秘密會議上,OpenAI向美國國家安全官員展示了「草莓」模型。 報道指出,OpenAI向政府展示一項尚未釋出的技術,可能為人工智慧開發者樹立新標準,也是OpenAI努力向政策制定者提高透明度的一部份。此前,以伊莉莎白·沃倫為首的美國參議員們曾多次抨擊OpenAI計畫透明度和安全性問題。

推理能力出眾,「草莓」能為OpenAI創收嗎?

據The Information報道,參與OpenAI該計畫的兩名人員透露,研究人員計劃在今年秋季推出代號為「草莓」的新型 AI,並有可能將其作為ChatGPT的一部份。

據悉,OpenAI希望透過推出「草莓」為公司籌集更多資金,並尋找減少虧損的方法。此前,據媒體報道OpenAI今年的虧損可能高達50億美元。

【每日經濟新聞】記者註意到,自2019年以來,OpenAI已從微軟籌集了約130億美元資金。作為與這家企業軟體巨頭合作的一部份,該合作協定將持續到2030年。據知情人士透露,合作協定的條款可能會發生變化,包括OpenAI向微軟支付租用雲伺服器開發AI的費用,其中,雲伺服器是OpenAI最大的成本。

據前述外媒援引內部人士說法,「草莓」目前的功能極其強大——它可以解決此前從未見過的數學問題,這是當前的聊天機器人無法可靠完成的任務。它還可以解決涉及編程的問題,且不局限於回答技術性問題。如果給予更多時間「思考」,「草莓」模型還可以回答使用者更「主觀」的問題,例如產品行銷策略。

為了展示「草莓」在語言方面的實力,研究人員向OpenAI內部同事展示了「草莓」如何解決【紐約時報】上刊登的復雜字謎遊戲。

事實上,現有的人工智慧在航空航天和結構工程等數學密集型領域並不擅長,那麽,解決棘手數學問題的AI可能是一個潛在有利可圖的套用。為了提高模型的推理能力,一些初創公司嘗試使用一種別扭的解決辦法——將問題分解為更小的步驟,但這些辦法既慢又貴。

數學推理的改進也有助於AI模型更好地處理對話查詢,例如客戶服務請求。這或許對OpenAI即將推出的AI代理服務起到幫助。

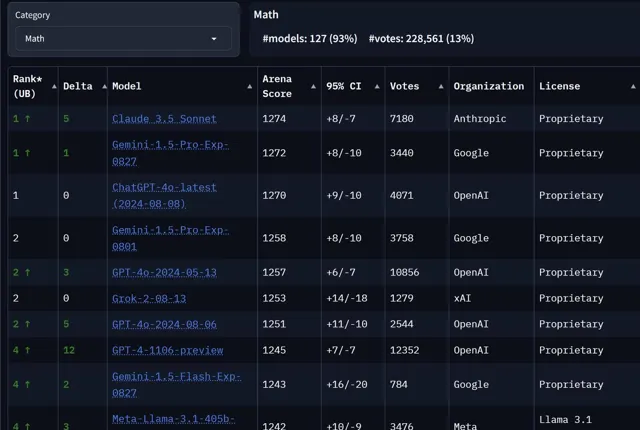

不僅是OpenAI,人工智慧領域的其他主要參與者也在數學推理方面取得了長足進步。例如,谷歌DeepMind 最近開發了AlphaProof和AlphaGeometry 2,這是兩個用於高級數學推理的AI系統。兩個系統協同工作,在2024年國際數學奧林匹克競賽中獲得銀牌,解決了六道題中的四道。

「草莓」正在為下一代旗艦模型獵戶座提供訓練數據

在OpenAI內部,「草莓」不僅是一個即將要向外界推出的營運模式,它還被賦予了更重要的使命。

一位知情人士向The Information表示,OpenAI在使用更大版本的「草莓」來生成訓練下一代旗艦模型「獵戶座」(Orion)的數據。該模型旨在改進其現有的旗艦模型GPT-4並幫助OpenAI領先其他資金雄厚的競爭對手,爭奪對話式AI或大型語言模型的霸主地位。

GPT-4自2023年3月推出後,就成為了一個改變遊戲規則的大型語言模型。然而,在過去18個月中,競爭對手已基本追趕上來。在某些情況下,甚至超越了OpenAI的最新模型。

據知情人士表示,這種由人工智慧生成的數據被稱為「合成數據」。這意味著「草莓」可以幫助OpenAI克服獲取足夠高品質數據的限制,從而利用從互聯網上提取的文本或影像等現實世界數據來訓練新模型。

代理初創公司Minion AI CEO、GitHub Copilot前首席架構師亞歷斯·格雷夫利表示,使用「草莓」生成更高品質的訓練數據可以幫助OpenAI減少其模型產生的錯誤數量,即所謂的幻覺。幻覺是當前生成式AI的一個重大限制,這會導致AI經常生成看似合理但實際上不正確的數據。

「想象一下,一個沒有幻覺的模型,你問它一個邏輯難題,它第一次嘗試就能答對,」格雷夫利說道。該模型之所以能夠做到這一點,是因為「訓練數據中的歧義較少,所以它猜測的次數較少。」

據The Information報道,阿特曼在5月份的一次活動中表示:「我們覺得我們擁有足夠的數據來開發下一個模型。我們已經進行了各種實驗,包括生成合成數據。」據報道,他可能指的就是用「草莓」訓練的Orion(獵戶座)。

安全隱患烏雲未散

不過,就在OpenAI高歌猛進的同時,安全隱患的烏雲從未散去。

「草莓」計畫源於前OpenAI首席科學家Ilya Sutskever的早期研究,OpenAI研究人員Jakub Pachocki和Szymon Sidor在Sutskever的工作基礎上開發了一種新的數學求解模型Q*。

而2023年底,有關OpenAI的Q*計畫的訊息泄露時,一些專家將該技術定性為人工智慧(AGI)的突破,但人們對它知之甚少。這也讓一些專註於人工智慧安全的研究人員感到震驚。

這件事情發生在OpenAI罷免阿特曼之前,據知情人士爆料,此前員工之間就公司是否以足夠安全的方式開發人工智慧展開了爭論。安全也是罷免阿特曼後公司內部損害控制的一個重要主題,當時罷免的發起人正是Sutskever。

此後,安全問題就一直困擾著OpenAI。而在阿特曼重返OpenAI後,負責OpenAI安全團隊的成員也相繼離開了公司。

今年5月離職的OpenAI「超級對齊」團隊領導人Jan Leike在社媒平台X上寫道:「過去幾年,安全文化和流程已經退居次要地位,而閃亮的產品則成為重中之重。」

鑒於今年早些時候幾位安全領導人離職,以及參議員伊莉莎白·沃倫等美國政府高官對於技術安全的批評,OpenAI決定提升對政府官員的透明度。

據The Information援引一位了解相關會議情況的人士透露,今年夏天,在一些並未公開的會議上,阿特曼的團隊向美國國家安全官員展示了「草莓」模型。

報道指出,透過向政府官員展示一項尚未釋出的技術,OpenAI可能為人工智慧開發者樹立了新標準,尤其是在先進人工智慧日益成為潛在安全隱患的今天。此次演示可能是OpenAI努力向政策制定者提高透明度的一部份,但如果政策制定者認為該項技術形成威脅,那麽他們可能給公司帶來麻煩。

不過一些業界人士對此並不買賬,因為OpenAI並未向公眾提升透明度。AI初創公司Abacus.AI CEO Bindu Reddy表示,封閉的OpenAI將他們最好的大模型藏在背後,以此來取得領先優勢。「如果沒有開源AI,我們都會完蛋,我們可能會把文明的控制權交給1到2家公司。」

每日經濟新聞