OpenAI近日宣布推出其最新研發成果——Sora模型,這一開創性的AI技術能夠根據使用者的文本指令生成長達一分鐘的高品質視訊。

Sora模型標誌著人工智慧在理解和模擬物理世界動態場景方面取得了重大突破,它不僅能夠理解復雜的視覺元素和情感表達,還能建立具有多角色、精確運動及主題背景細節的連貫場景。

此外,Sora還具備生成多個連續鏡頭的能力,保持角色的一致性和視覺風格的統一。然而,當前模型在空間細節的理解上尚存挑戰,如左右方向的混淆以及隨時間推移事件的準確描繪,比如遵循特定攝影機軌跡的動作序列。

為了確保Sora的安全性和負責任的使用,OpenAI正采取一系列嚴謹的安全措施。公司內部的紅隊成員正在進行對抗性測試,以評估模型在生成內容中可能出現的錯誤資訊、仇恨內容和偏見問題。

同時,OpenAI正在開發檢測誤導性內容的新工具,包括可以辨識由Sora生成視訊的分類器,並計劃采用C2PA後設資料標準,以便在產品部署時增強透明度。

在安全策略方面,OpenAI借鑒了DALL-E 3產品的既有做法,例如利用文本分類器篩選違反政策的輸入提示,並建立強大的影像分類器審查生成視訊的每一幀,以確保符合使用政策。未來,OpenAI還將繼續與全球範圍內的政策制定者、教育工作者和藝術家合作,探討新技術的積極套用案例和潛在風險。

從技術層面看,Sora采用了擴散模型框架,從類似靜態噪音的初始狀態逐步叠代,創造出清晰連貫的視訊內容。值得一提的是,Sora能夠在一次性生成整個視訊的同時,也能擴充套件視訊長度,即使主體短暫離開視線也能保持一致性。與GPT模型共享相似的變壓器架構,Sora展現出卓越的可延伸效能。

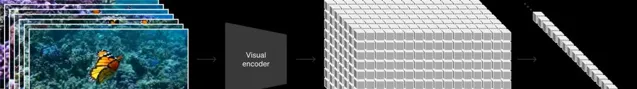

透過將視訊和影像分解為「修補程式」(類似於GPT中的令牌),OpenAI團隊成功地在多樣化的視覺數據集上訓練了擴散變換器,涵蓋了不同的持續時間、分辨率和寬高比。Sora還借鑒了DALL-E 3的重述技術,使得模型能更精準地遵循使用者提供的詳細文本說明來生成視訊內容,甚至可以從靜止影像出發創作出動畫效果,對原始影像的細微之處進行忠實再現。

Sora模型的誕生不僅是對現有技術的顯著提升,更是朝著實作通用人工智慧(AGI)的重要一步。OpenAI堅信,Sora所展示的理解和模擬現實世界的能力將成為構建真正智慧系統的關鍵基石。

隨著Sora模型的釋出,OpenAI再次展示了其在人工智慧領域的領先地位,同時也提醒業界關註此類先進技術所帶來的倫理和社會責任問題。OpenAI將持續從真實世界的使用案例中學習,致力於打造越來越安全可靠的人工智慧產品和服務。